Repository: 1051727403/SHU-CS-Source-Share

Branch: main

Commit: 48793a1642ad

Files: 41

Total size: 180.0 KB

Directory structure:

gitextract_gzz3lvdu/

├── .gitattributes

├── .gitignore

├── README.md

├── 学习资料(非电子书)/

│ ├── C语言/

│ │ └── README.md

│ ├── JAVA程序设计/

│ │ └── README.md

│ ├── Web开发计算A/

│ │ └── README.md

│ ├── 人工智能/

│ │ └── README.md

│ ├── 其他/

│ │ └── README.md

│ ├── 大学物理/

│ │ └── README.md

│ ├── 大数据从理论到实践A/

│ │ └── README.md

│ ├── 实用计算机英语/

│ │ └── README.md

│ ├── 微积分/

│ │ └── README.md

│ ├── 操作系统/

│ │ └── README.md

│ ├── 数字逻辑/

│ │ └── README.md

│ ├── 数据分析与智能计算/

│ │ └── README.md

│ ├── 数据库/

│ │ └── README.md

│ ├── 数据结构/

│ │ └── README.md

│ ├── 概率论/

│ │ └── README.md

│ ├── 汇编语言/

│ │ └── README.md

│ ├── 离散数学/

│ │ └── README.md

│ ├── 算法设计与分析课程/

│ │ └── README.md

│ ├── 线性代数/

│ │ └── README.md

│ ├── 组合数学/

│ │ └── README.md

│ ├── 编译原理/

│ │ └── README.md

│ ├── 脑认知/

│ │ ├── README.md

│ │ └── cxy-脑认知复习/

│ │ └── 脑认知复习.md

│ ├── 计算机体系结构/

│ │ └── README.md

│ ├── 计算机最新进展研讨/

│ │ └── README.md

│ ├── 计算机研究前沿/

│ │ └── README.md

│ ├── 计算机组成原理/

│ │ └── README.md

│ ├── 计算机编程实训/

│ │ └── README.md

│ ├── 计算机网络/

│ │ └── README.md

│ ├── 语义网络与知识图谱/

│ │ └── README.md

│ ├── 软件工程/

│ │ └── README.md

│ └── 面向对象/

│ └── README.MD

├── 就业相关/

│ ├── 八股笔记/

│ │ └── 个人珍藏八股笔记,看缘分更新.md

│ ├── 简历/

│ │ └── 简历攻略.md

│ └── 面经/

│ ├── Nvidia-Internship.md

│ ├── Shanghai-AI-Lab-Internship.md

│ └── 一些面经.md

└── 电子书/

└── README.md

================================================

FILE CONTENTS

================================================

================================================

FILE: .gitattributes

================================================

* text=auto eol=lf

================================================

FILE: .gitignore

================================================

================================================

FILE: README.md

================================================

# 🖥️[SHU-CS-Source-Share](https://github.com/1051727403/SHU-CS-Source-Share)

## [❤️](https://github.com/makeplane/plane#️-community)SHU-上大计算机资料分享汇总

注:本项目旨在通过汇总学习资料的方式帮助上大计算机同学更好地进行学习,无任何不良引导。

资料来源:学长学姐分享以及网络上搜索

所有资料地址均经过鉴定,为免费资源,质量有保障,部分敏感资源没有。

**如果有侵权情况,麻烦您发送必要的信息至ldw@foxmail.com,带来不便还请您谅解**

**🔥关于如何分享提交资料请移动至页面最底部**

**PS:若想要的资料不在项目内,也可以私信我,我会尽量去完善(\*\^▽\^\*)**

# 🔥资料地址汇总

~~电子书可以直接在本项目中找到,资料地址一般是实验、报告、PPT、复习资料等类型的~~

-------------------分割线-------------------

#### 🎉最新更新时间:2024-06-18

#### 👉最新更新内容:NVIDIA和SH-AiLab的面经

🤗PS:感谢同学分享以及提交PR!祝大家考试顺利!

-------------------分割线-------------------

## 🔥本项目内资料快速跳转

#### 同学们可以通过该表格快速跳转查找资料

| 🔥课程名称🔥 | 类别 | 学习资料、报告等 | 电子书 |

| :----------------------- | ---- | :----------------------------------------------------------: | :----------------------------------------------------------: |

| SHU-数据结构 | 必修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E6%95%B0%E6%8D%AE%E7%BB%93%E6%9E%84) | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E7%94%B5%E5%AD%90%E4%B9%A6/%E6%95%B0%E6%8D%AE%E7%BB%93%E6%9E%84) |

| SHU-计算机网络 | 必修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E8%AE%A1%E7%AE%97%E6%9C%BA%E7%BD%91%E7%BB%9C) | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E7%94%B5%E5%AD%90%E4%B9%A6/%E8%AE%A1%E7%AE%97%E6%9C%BA%E7%BD%91%E7%BB%9C) |

| SHU-操作系统 | 必修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E6%93%8D%E4%BD%9C%E7%B3%BB%E7%BB%9F) | 暂无资料 |

| SHU-计算机组成原理 | 必修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E8%AE%A1%E7%AE%97%E6%9C%BA%E7%BB%84%E6%88%90%E5%8E%9F%E7%90%86) | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E7%94%B5%E5%AD%90%E4%B9%A6/%E8%AE%A1%E7%AE%97%E6%9C%BA%E7%BB%84%E6%88%90%E5%8E%9F%E7%90%86) |

| SHU-数据库 | 必修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E6%95%B0%E6%8D%AE%E5%BA%93) | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E7%94%B5%E5%AD%90%E4%B9%A6/%E6%95%B0%E6%8D%AE%E5%BA%93) |

| SHU-编译原理 | 必修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E7%BC%96%E8%AF%91%E5%8E%9F%E7%90%86) | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E7%94%B5%E5%AD%90%E4%B9%A6/%E7%BC%96%E8%AF%91%E5%8E%9F%E7%90%86) |

| SHU-计算机体系结构 | 必修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E8%AE%A1%E7%AE%97%E6%9C%BA%E4%BD%93%E7%B3%BB%E7%BB%93%E6%9E%84) | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E7%94%B5%E5%AD%90%E4%B9%A6/%E8%AE%A1%E7%AE%97%E6%9C%BA%E4%BD%93%E7%B3%BB%E7%BB%93%E6%9E%84) |

| SHU-数字逻辑 | 必修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E6%95%B0%E5%AD%97%E9%80%BB%E8%BE%91) | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E7%94%B5%E5%AD%90%E4%B9%A6/%E6%95%B0%E5%AD%97%E9%80%BB%E8%BE%91) |

| SHU-软件工程 | 必修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E8%BD%AF%E4%BB%B6%E5%B7%A5%E7%A8%8B) | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E7%94%B5%E5%AD%90%E4%B9%A6/%E8%BD%AF%E4%BB%B6%E5%B7%A5%E7%A8%8B) |

| SHU-C语言 | 必修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/C%E8%AF%AD%E8%A8%80) | 暂无资料 |

| SHU-面向对象 | 必修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E9%9D%A2%E5%90%91%E5%AF%B9%E8%B1%A1) | 暂无资料 |

| SHU-计算机研究前沿 | 必修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E8%AE%A1%E7%AE%97%E6%9C%BA%E7%A0%94%E7%A9%B6%E5%89%8D%E6%B2%BF) | 暂无资料 |

| SHU-计算机编程实训 | 必修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E8%AE%A1%E7%AE%97%E6%9C%BA%E7%BC%96%E7%A8%8B%E5%AE%9E%E8%AE%AD) | 暂无资料 |

| SHU-夏季硬件大作业 | 必修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/SummerProject) | 暂无资料 |

| SHU-大学物理 | 必修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E5%A4%A7%E5%AD%A6%E7%89%A9%E7%90%86) | 暂无资料 |

| SHU-微积分 | 必修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E5%BE%AE%E7%A7%AF%E5%88%86) | 暂无资料 |

| SHU-概率论 | 必修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E6%A6%82%E7%8E%87%E8%AE%BA) | 暂无资料 |

| SHU-离散数学 | 必修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E7%A6%BB%E6%95%A3%E6%95%B0%E5%AD%A6) | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E7%94%B5%E5%AD%90%E4%B9%A6/%E7%A6%BB%E6%95%A3%E6%95%B0%E5%AD%A6) |

| SHU-线性代数 | 必修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E7%BA%BF%E6%80%A7%E4%BB%A3%E6%95%B0) | 暂无资料 |

| SHU-计算机最新进展研讨 | 必修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E8%AE%A1%E7%AE%97%E6%9C%BA%E6%9C%80%E6%96%B0%E8%BF%9B%E5%B1%95%E7%A0%94%E8%AE%A8) | 资料内有 |

| SHU-人工智能与脑认知 | 必修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E8%84%91%E8%AE%A4%E7%9F%A5) | 暂无资料 |

| SHU-算法设计与分析课程 | 选修 | [点击跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E7%AE%97%E6%B3%95%E8%AE%BE%E8%AE%A1%E4%B8%8E%E5%88%86%E6%9E%90%E8%AF%BE%E7%A8%8B) | 暂无资料 |

| SHU-数据分析与智能计算 | 选修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E6%95%B0%E6%8D%AE%E5%88%86%E6%9E%90%E4%B8%8E%E6%99%BA%E8%83%BD%E8%AE%A1%E7%AE%97) | 暂无资料 |

| SHU-组合数学 | 选修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E7%BB%84%E5%90%88%E6%95%B0%E5%AD%A6) | 暂无资料 |

| SHU-汇编语言 | 选修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E6%B1%87%E7%BC%96%E8%AF%AD%E8%A8%80) | 暂无资料 |

| SHU-JAVA程序设计 | 选修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/JAVA%E7%A8%8B%E5%BA%8F%E8%AE%BE%E8%AE%A1) | 暂无资料 |

| SHU-语义网络与知识图谱 | 选修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E8%AF%AD%E4%B9%89%E7%BD%91%E7%BB%9C%E4%B8%8E%E7%9F%A5%E8%AF%86%E5%9B%BE%E8%B0%B1) | 暂无资料 |

| SHU-Web开发技术A | 选修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/Web%E5%BC%80%E5%8F%91%E8%AE%A1%E7%AE%97A) | 暂无资料 |

| SHU-大数据从理论到实践A | 选修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E5%A4%A7%E6%95%B0%E6%8D%AE%E4%BB%8E%E7%90%86%E8%AE%BA%E5%88%B0%E5%AE%9E%E8%B7%B5A) | 暂无资料 |

| SHU-实用计算机英语 | 选修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E5%AE%9E%E7%94%A8%E8%AE%A1%E7%AE%97%E6%9C%BA%E8%8B%B1%E8%AF%AD) | 暂无资料 |

| SHU-人工智能(计科选修) | 选修 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E4%BA%BA%E5%B7%A5%E6%99%BA%E8%83%BD) | 暂无资料 |

| SHU-其他 | 其他 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E5%85%B6%E4%BB%96) | 暂无资料 |

| SHU-ACM算法知识&模板 | 其他 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%AD%A6%E4%B9%A0%E8%B5%84%E6%96%99%EF%BC%88%E9%9D%9E%E7%94%B5%E5%AD%90%E4%B9%A6%EF%BC%89/%E5%85%B6%E4%BB%96/ACM%E7%AE%97%E6%B3%95%E7%9F%A5%E8%AF%86%26%E6%A8%A1%E6%9D%BF) | 暂无资料 |

## ❤️就业专题

| ❤️名称❤️ | 类别 | 快速跳转 |

| :----------- | ---- | :----------------------------------------------------------: |

| SHU-简历相关 | 就业 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%B0%B1%E4%B8%9A%E7%9B%B8%E5%85%B3/%E7%AE%80%E5%8E%86) |

| SHU-面经 | 就业 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%B0%B1%E4%B8%9A%E7%9B%B8%E5%85%B3/%E9%9D%A2%E7%BB%8F) |

| SHU-八股笔记 | 就业 | [点此跳转](https://github.com/1051727403/SHU-CS-Source-Share/tree/main/%E5%B0%B1%E4%B8%9A%E7%9B%B8%E5%85%B3/%E5%85%AB%E8%82%A1%E7%AC%94%E8%AE%B0) |

| | | |

## 🔥非本项目内资料

#### 该处存放无实体的资料,例如别人的仓库链接、博客、第三方平台上的笔记等,需要外链跳转

### SHU-计算机网络

1、[❤️](https://github.com/makeplane/plane#%EF%B8%8F-community)[SHU-计网实验分享](https://github.com/1051727403/SHU-NetWork-report)

### SHU-操作系统

1、[❤️](https://github.com/makeplane/plane#%EF%B8%8F-community)[SHU-操作系统(1-2)实验全报告](https://github.com/1051727403/SHU-OS-Report)

### SHU-编译原理

1、[❤️](https://github.com/makeplane/plane#%EF%B8%8F-community)[编译原理考点和概念全集](https://icy-roadway-527.notion.site/96c5082078494e85994fd6c2e05c1893)

2、❤️[编译原理实验全集](https://github.com/Blbrw/SHU--CompilationPrinciples)

### SHU-计算机体系结构

1、[上海大学计算机体系结构实验四 HPL安装和测试(虚拟机centos7.6环境下保姆级教程!)](https://blog.csdn.net/qq_51413628/article/details/130628390?spm=1001.2014.3001.5501)

### SHU-法设计与分析课程

1、[❤️](https://github.com/makeplane/plane#%EF%B8%8F-community)[SHU算法设计与分析课程实验(含代码实现与报告)](https://github.com/RuoShui66/algorithm):罗神出品,品质有保障!

### SHU-汇编语言程序设计

1、[❤️](https://github.com/makeplane/plane#%EF%B8%8F-community)[2023秋季汇编语言程序设计课程实验、作业与复习资料](https://github.com/30Hzzh/SHUOS-Assembly-Language)

### SHU-计算思维实训

1、[❤️](https://github.com/makeplane/plane#%EF%B8%8F-community)[2023计算思维实训-无尺度网络建模及其各项特性的研究、分析、可视化](https://github.com/drewjin/drew_Scale-Free_Network)

### **SHU-ACM模板**

1、[❤️ACM模板](https://github.com/whoamizx/banzi):新手算法模板,持续更新到2025年

# 🕵️友情链接

#### 该板块存放其他学长创建的类似资料合集仓库,若本项目内寻找不到想要的资料,可以跳转到其他资料仓库寻找。

-------------------分割线-------------------

**🔥1、[历年试卷、作业答案、心得体会笔记等](https://github.com/shuosc/libshu)**

**🔥2、[学校课内课程的笔记,电子书,复习资料、包括自己写的一些专业课历年卷的解答等](https://github.com/Amadeus-1048/Course-Review)**

**🔥3、[上海大学网络空间安全专业指南](https://github.com/shu-cake1salie/SHU-Cyberspace-Security-101)**:主要是网安专业的内容,包括信息安全技术等专业课相关内容

[👉该项目配套网站](https://shu-cake1salie.github.io/SHU-Cyberspace-Security-101):上面项目的成品网站,点击查看具体内容,很nice

**🔥4、[hcy的个人仓库(已全部分类完毕,涵盖各科内容),包括课程资料、个人作业、历年卷、笔记、代码等等](https://github.com/caiyuhu-backup/SHU-CS-Assignments-and-Resources/tree/main)**

👉**概述**:这个仓库包含了在上海大学计算机科学与技术专业本科期间的课程资源以及个人作业。希望这些内容能为同学们学习专业课提供参考,帮助大家节省时间,避免将宝贵的时间浪费在课程上。

# 📈贡献者

# 🔔加入我们&分享资料

注:分享内容可以是你的项目地址、博客地址,也可以是一个word文件、PDF、电子书等等

## 🔥如何分享提交资料?

如果你希望贡献此仓库, 请先确保自己下载了 git, 并且能够成功 clone GitHub 中的远程仓库.

如果对 git 有疑问, 请参考 [How to Use Git](https://github.com/1051727403/SHU-CS-Source-Share/wiki/How-to-Use-Git).

具体贡献的方式, 请参考 [How to Contribute](https://github.com/1051727403/SHU-CS-Source-Share/wiki/How-to-Contribute).

-------------------分割线-------------------

**鸣谢:**

感谢所有愿意维护该项目以及分享资源的同学,欢迎大家提交PR或是直接QQ联系我,我会及时更新资料。

若想要参与项目维护可以QQ私信我

QQ:1051727403

================================================

FILE: 学习资料(非电子书)/C语言/README.md

================================================

# C语言

资料链接: [[百度网盘](https://pan.baidu.com/s/1OdaHrgdZVbCh7VBgRB_mlg?pwd=1lsd)]

1. C语言复习题合辑包

- C语言课后习题答案截图

- 第[2-7]章答案

- 校内历年卷

- [2000-2011]

- 编程题评分参考

- ...

- 练习题

- ...

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/JAVA程序设计/README.md

================================================

# JAVA程序设计

资料链接: [[百度网盘](https://pan.baidu.com/s/1t5PjPaSYis2fiBxVt4omZg?pwd=1ewn)]

1. lv课后作业源码

- 1-9周课后作业.zip

- README.md

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/Web开发计算A/README.md

================================================

# Web开发计算A

资料链接: [[百度网盘](https://pan.baidu.com/s/1CmV87La7qNJyA17kq72HAQ?pwd=daca)]

1. 实验

- 实验三.docx

- 实验四.docx

- 实验五.docx

- 实验六.docx

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/人工智能/README.md

================================================

# 人工智能

资料链接: [[百度网盘](https://pan.baidu.com/s/1kS8tlxhvzHbuFZ0_EaYTAg?pwd=e02y)]

1. JIN人工智能复习大纲 [[百度网盘](https://pan.baidu.com/s/1v1XZQJ09833MzEQmeWOkKg?pwd=pbhp)]

- Assets

- AI复习大纲2023冬.pdf

- README.md

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/其他/README.md

================================================

# 其他

资料链接: [[百度网盘](https://pan.baidu.com/s/1ORPhnqPtd88EQwYhpIqHyA?pwd=v4no)]

1. ACM算法知识&模板

- 【算法知识整理】无图版.md

- 【算法知识整理】有图版.pdf

- ACM算法模板-纯模板无图片.pdf

- README.md

2. PPT通用模板

- 学府红.pptx

- 上大蓝.pptx

- 江南绿.pptx

- 银杏黄.pptx

- 玉兰白.pptx

- 锦鲤红.pptx

- 海派蓝.pptx

- 芳菲紫.pptx

- 星空灰.pptx

3. PS教程 [[GitHub](https://github.com/1051727403/PS-Tutorial)]

4. 阿里巴巴JAVA开发规范

- Java开发手册(黄山版).pdf

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/大学物理/README.md

================================================

# 大学物理

资料链接: [[百度网盘](https://pan.baidu.com/s/1IS8pAVRmw20hFBKhiZTyQA?pwd=69ta)]

1. 大学物理实验

- 【大物实验】填空题爆炸秒杀.xls

- 大物实验基础课ppt.pdf

- 物理实验题库.xlsx

- 碰撞实验.xlsx

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/大数据从理论到实践A/README.md

================================================

# 大数据从理论到实践A

资料链接: [[百度网盘](https://pan.baidu.com/s/1dpzsmXZMuKs1P1RfUwCjMA?pwd=c9f0)]

1. 课程论文

- lv课程论文.docx

- 论文模板.docx

2. 参考资料

- README.md

- 如何实现机器学习算法.pdf

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/实用计算机英语/README.md

================================================

# 实用计算机英语

简介:这门课作为一门4分的选修课,是在第十周提前考的,考试方式为闭卷

优点:不需要制作项目,分值高,管得不严,适合划水

缺点:课后作业习题较多(当前目录下仅为其中的一小部分),最后个人感觉很难给高分

总结:如果不对绩点有高需求,又想划水,又想给分多,并且自身有一定英语水平的可以考虑选

---

资料链接: [[百度网盘](https://pan.baidu.com/s/1Hb-sMekvp7vEsEa5fzlI6w?pwd=r7j0)]

1. 历年卷

- 2021 ~ 2022实用计算机英语历年卷.doc

2. 教材

- Computing Essentials 2021 .pdf

3. 课后作业

- 第一周词汇.docx

- 第二章词汇.docx

- 第三章词汇.docx

- 第四章词汇.docx

- 第五章词汇.docx

- 第六章词汇.docx

- 第七章词汇.docx

- 第七章词汇.docx

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/微积分/README.md

================================================

# 微积分

资料链接: [[百度网盘](https://pan.baidu.com/s/1N6JaIQlP_rIbcomwLm6-Cg?pwd=xkf8)]

1. 试卷

- 2023年微积分1练习题(理工).pdf

- 2023年微积分1练习题(理工)参考答案.docx

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/操作系统/README.md

================================================

# 操作系统

资料链接: [[百度网盘](https://pan.baidu.com/s/1WFoMo53BeIQHaQ7zg0DeRg?pwd=vb58)]

1. 操作系统(1)

- 哲学家问题模拟源代码.docx

2. 操作系统(2)

- 试卷

- 操作系统(二)试卷.pdf

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/数字逻辑/README.md

================================================

# 数字逻辑

资料链接: [[百度网盘](https://pan.baidu.com/s/1SQBZLEHqmKIJcYHwtq5bxg?pwd=vh5a)]

本文件夹下存放了数字逻辑实验相关的内容,其中,以不同前缀命名的实验报告:“jk报告”“lv报告”分别代表两个不同的人的报告,感谢大家分享!

---

1. jk报告

- 实验[1-5].doc

2. lv报告

- 实验[1-6].doc

3. 复习资料

- 2019秋数字逻辑复习汇总.pptx

4. 数字逻辑实验PPT_20201109

- 数字逻辑实验[1-7].ppt

5. 数字逻辑实验指导书_20201030

- ...

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/数据分析与智能计算/README.md

================================================

# 数据分析与智能计算

资料链接: [[百度网盘](https://pan.baidu.com/s/1Pfb_NbInGLS-oznu4hdVmQ?pwd=tm0i)]

1. 复习资料

- 复习大纲.md

- 库函数快速索引表.xlsx

- 数据分析复习.pptx

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/数据库/README.md

================================================

# 数据库

资料链接: [[百度网盘](https://pan.baidu.com/s/1iV616CU8FSVyB5nU7FmETw?pwd=a005)]

1. 数据库(1)

- 《数据库原理一》复习、习题分析.ppt

- README.md

- 数据库原理(一)--复习课2024版.ppt

- 课后习题参考答案.pdf

2. 数据库(1)实验

- 2022冬-数据库1-研讨和实验安排(更.docx

- 李晓强1-5周.docx

3. 数据库(2)

- 第...章.ppt

4. 数据库(2)实验-ly

- 实验1 在云服务器上部署mysql.md

- 实验2 Hadoop&Hive部署.md

- 实验3 在Docker中部署Redis.md

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/数据结构/README.md

================================================

# 数据结构

资料链接: [[百度网盘](https://pan.baidu.com/s/1HtkEoSB2ui0bxrQZK-qzlw?pwd=fx7m)]

1. ycshao21-CourseProject [[GitHub](https://github.com/ycshao21/DataStructure-ZNJ-SHU)]

2. 数据结构(2)

- PPT课件

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/概率论/README.md

================================================

# 概率论

资料链接: [[百度网盘](https://pan.baidu.com/s/1UYKbE4YdS5a2E0grD6vnAg?pwd=qsdg)]

1. 历年卷

- 12-13秋概率论与数理统计A试题(A卷).doc

2. 复习

- 复习提纲_概率统计.pdf

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/汇编语言/README.md

================================================

# 汇编语言

资料链接: [[百度网盘](https://pan.baidu.com/s/1lYX3JYTSGQiuCHHSD8Tecw?pwd=6lw6)]

1. HighVorz-assembly

- experiment

- exp[2-7].asm

- report.md

- func

- *.asm

- assembly.md

- HelloWorld.asm

- method.jpg

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/离散数学/README.md

================================================

# 离散数学

资料链接: [[百度网盘](https://pan.baidu.com/s/1qpt52Mw-4pdXpMGucdylng?pwd=9us1)]

1. 历年卷

- 2012~2013学年秋季离散数学.pdf

2. 复习

- 图论:几种特殊的图.jpg

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/算法设计与分析课程/README.md

================================================

# 算法设计与分析

资料链接: [[百度网盘](https://pan.baidu.com/s/1rCpVy_rKS7kPVF2gpVtKkw?pwd=ju84)]

1. jk-实验题目与源码解析

- 实验[1-7]

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/线性代数/README.md

================================================

# 线性代数

资料链接: [[百度网盘](https://pan.baidu.com/s/12H7BrmmLMdV28Dfe0dATGA?pwd=2rn7)]

1. 复习、历年真题

- [2009-2018]

2. 笔记

- 手写复习笔记.pdf

- 线性代数笔记zzr.pdf

3. 课件PPT

- ...

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/组合数学/README.md

================================================

# 组合数学

资料链接: [[百度网盘](https://pan.baidu.com/s/1OhdZ02D7MCh98f_MYdgcOg?pwd=n12o)]

1. 习题

- lv-八种球盒问题.docx

- 经典考题1.png

- 经典考题2.png

2. 课件

- Chapter[1-6].pdf

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/编译原理/README.md

================================================

# 编译原理

资料链接: [[百度网盘](https://pan.baidu.com/s/1BgMNHwcAUQQiwFXEgIHEAA?pwd=15o7)]

1. 实验指导书和模板

- 《编译原理》课程实验报告撰写提纲.docx

- 《编译原理》课程实验指导书.pdf

2. 课程项目: PrettyLazy0 [[Github](git@github.com:jamesnulliu/PrettyLazy0.git)]

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/脑认知/README.md

================================================

# 脑认知

1. cxy-脑认知复习

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/脑认知/cxy-脑认知复习/脑认知复习.md

================================================

# 人工智能与脑认知

> :heavy_exclamation_mark: 考前预测的重点

> ==xx==考到的部分小题和几乎所有简答题,大题

## Chapter 1 人工智能与脑科学

### 人工智能与智能

#### 史观

- 亚里士多德 三段论 前提真 结论真;培根 归纳法 前提真,结论不一定真

- Godel的这两条定理,指出了把人的思维形式化和机械化的某种**极限**,在理论上证明了**有些事情是做不到的**

- 诺伯特·维纳认为所有人类智力的结果都是一种**反馈**的结果;**反馈机制**是有可能用机器模拟的

- 图灵测试使实验研究智能行为成为可能

#### 相关定义:heavy_exclamation_mark:

##### 人工智能

1. **基于能力行为的定义**:智能机器所执行的通常与人类智能有关的智能行为 ,如判断、推理、证明、识别、感知、理解、通信、设计、思考、规划、学习和问题求解等思维活动 。

1. **学科的定义**:计算机科学中涉及研究、设计和应用智能机器的一个分支 。它的近期目标在于研究用机器来模仿和执行人脑的某些功能,并开发相关理论和技术。

##### 知识

==人们通过体验、学习或联想而知晓的对客观世界规律性的认识,包括事实、条件、过程、规则、关系和规律等==

##### 智能

两种定义方式:

人类在认识和改造世界的活动中,由脑力劳动表现出来的能力。包括感知、理解、抽象、分析、推理、判断、学习和对变化环境的适应等等。

一种应用知识对一定环境或问题进行**处理**的能力或者进行**抽象思考**的能力。

##### 智能机器

能够在各类环境中**自主地或交互地**执行各种拟人任务的机器。

##### 生物智能

生物智能是个体有目的的行为、合理的思维, 以及有效的适应环境的综合能力

#### 人类思维的主要形态

==**感知,形象,抽象,灵感**==

1. 感知是思维的**初级形态**,来源**客观的,丰富的**

2. 形象思维主要是典型化的方法进行概括,用形象材料来思维,高等生物共有。

3. **形象思维**处理外部感知,进一步进行抽象思维

#### 人工智能的五个基本问题

1. **知识与概念化**是否是人工智能的核心?

2. **认知能力**能否与**载体**分开来研究?

3. **认知的轨迹**是否可用**类自然语言**来描述?

4. **学习能力**能否与**认知**分开来研究?

5. 所有的认知是否有一种**统一的结构**?

#### 人工智能的研究目标

* 根本目标是要求计算机不仅能模拟而且可以延伸、扩展人的智能, 达到甚至超过人类智能的水平。

* 近期目标是使现有的计算机不仅能做一般的数值计算及非数值信息的数据处理,而且能运用知识处理问题,能模拟人类的部分智能行为。

* 作为工程技术学科,人工智能的目标是提出建造人工智能系统的新技术、新方法和新理论,并在此基础上研制出具有智能行为的计算机系统。

* 作为理论研究学科,人工智能的目标是提出能够描述和解释智能行为的概念与理论,为建立人工智能系统提供理论依据。

#### 人工智能分类 :heavy_exclamation_mark:

> 听王昊的意思必考?草结果没考,至少a卷没考

类人思维方法 理性思维系统

类人行为方法 理性行为系统

### 人脑工程

#### 人类脑计划

人类脑计划的核心:***神经信息学***,指**神经科学**和**信息科学**相互结合的研究领域。

目标:**认识脑,保护脑,创造脑** :heavy_exclamation_mark:

### 选择题

#### 人脑的特点

1. 大脑重量占人体的2%,能耗却达到正常消耗的20%,是人体能量消耗最大的器官之一。

2. 大脑的神经细胞超过1000亿个,具有一定的自我修复、学习和功能强化能力。

3. 大脑具有计算机所不能达到的逻辑思维、情感思维和模糊分析能力。

4. 脑死亡状态下,脑部**仍产生生物电流**,脑神经元若未完全死亡还有脑电。

#### 人脑的智能特点 :heavy_exclamation_mark:

1. 能感知客观世界的信息 **(感知能力)**

2. 能对通过思维获得的知识进行加工处理 **(记忆与思维能力)**

3. 能通过学习积累知识增长才干和适应环境变化 **(归纳与演绎)**

4. 能对外界的刺激作出反应传递信息 **(学习能力以及行为能力)**

#### 人工智能与人的自然智能 :heavy_exclamation_mark:

1. 人工智能是人类智能的延申与扩展

2. 人的自然智能能够结合外部环境进行合理的判断,而人工智能可以根据外界的输入(即外界环境的变化)进行分析输出,两者具有相似性,但是不具备可替代性。

3. 在所有人工智能的定义以及人工智能的基本问题中,人工智能的目的是为了代替人的某些单调的或是复杂的体力和脑力活动,从而让人具有更多的精力来完成更加复杂的工作。

4. 人工智能技术实质上是一种类人行为和思维方法。

#### 人工智能的描述

1. 人工智能的研究注意智能系统的效果而不是单纯的对人的智能行为的模拟。

2. 人工智能研究者主要从智能行为的过程与表现入手。

3. 人工智能的目标是提出建造人工智能系统的新技术、新方法和新理论,并在此基础上研制出具有智能行为的计算机系统。

4. 人工智能的目标是提出能够描述和解释智能行为的概念与理论,为建立人工智能系统提供理论依据。

## Chapter 2-a 认知科学概述

### 认知神经科学

#### 定义

认知神经科学是认知活动的**心理过程**和**脑机制**的科学。

心理学由认知心理学进入到认知神经科学的新时代。认知神经科学并不是认知心理学的分支

#### 研究模式

将**行为、认知过程、脑机制**三者结合起来

#### 常用研究方法

1. **无创性脑功能(认知)成像技术**

- 脑代谢功能成像

- 生理功能成像

2. **清醒动物认知生理心理学研究方法**

- 包括单细胞记录

- 多细胞记录

- 多维(阵列)电极记录法

- 其他生理心理学方法(手术法、冷却法、药物法等)

3. 脑事件相关电位、脑磁图和高分辨率脑成像等生理学电位方法

#### 具体研究方法

- 脑整体活动层次

- 不同脑区活动层次

- 神经细胞和亚细胞层次

- 分子活动层次

#### 认知活动测量工具

脑活动测量工具:

- 脑电波(Electroencephalogram, EEG)

- fNIR近红外光学脑成像系统

- 脑磁共振

其他生理设备:眼动仪、皮电、肌电、血电容积等

#### 神经系统

神经系统分为:**中枢神经系统**和**周围神经系统**

### 认知心理学

#### 核心 :heavy_exclamation_mark:

输入和输出之间发生的内部心理过程

#### 研究对象

1. 人的高级心理过程,主要是认知过程

2. 信息加工心理学

#### 研究内容

1. 人们如何获得外部世界信息

2. 信息在人脑内如何表示并转化为知识

3. 知识怎样存储又如何用来指导人们的注意和行为

4. 从认知神经生理基础、感知觉基本过程、认知行为脑机制到认知心理应 用多个层面探索心智奥秘

5. 从基因-神经-心理-行为层面出发,开展个体-群体-组织-社会等多个水平 的基础研究和应用研究

### 脑结构与功能

#### 神经细胞的组成

细胞体,轴突,树突

#### 脑的结构

**大脑、间脑、小脑、中脑、脑桥及延髓**等六个部分

#### 大脑皮质

- 三个面:上外侧面、内侧面、下面

- 三个沟:中央沟、外侧沟、顶枕沟

- ==**五个叶:额叶、顶叶、枕叶、颞叶、岛叶** :heavy_exclamation_mark:==

大脑皮质中,**额叶**部分负责高级思维相关,**枕叶**部分被认为是视觉初级感受区,**颞叶**主要是听觉初级区域所在的位置。

#### 左右脑

:heavy_exclamation_mark: 左右脑的协同主要依赖**胼胝体**

> 选填?

##### 对比

左半脑主要具有语言、分析、计算、抽象、逻辑、对时间感觉等思维功能;右半脑具有表象、综合、直观、音乐、对空间知觉和理解等思维功能。在思考方式上,左半球是垂直的、连续的、因果式的;右半球是并行的、发散的、整体式的。

##### 联系

大脑左右半球的分工并不是那么泾渭分明,功能的单侧化只具有相对的意义,左右半球既有相对的分工,又有密切的协作,人的许多重要的心理功能都需要左右半球的密切协作才能完成。

#### 脑的联络区

大脑中除了一些具有特定功能的中枢外,还存在着广泛的脑区,它们不局限于某种功能,而是对各种信息进行加工和整合,完成高级的神经精神活动,称为联络区。

#### 大脑认知功能模块:heavy_exclamation_mark:

**加扎尼加**提出脑认知功能模块论

#### 无法说话 :heavy_exclamation_mark:

原因是**运动型语言中枢**出问题

## Chapter 2-b 认知科学详细

### 认知科学

认知科学是研究人类感知和思维信息处理过程的科学,**(研究方向)** 包括从感觉的输入到复杂问题求解, 从人类个体到人类社会的智能活动, 以及人类智能和机器智能的性质。

#### 研究层次(认知科学or认知神经科学)

分子、细胞、脑组织区和全脑

#### 四个焦点问题 *(可能多选)*

1. 知觉和认知

2. 运动和行为

3. 记忆和学习

4. 语言和思考

#### 认知的三个方面

==***适应、结构、过程***==

#### hoston等对认知的看法

1. 认知是信息的处理过程;

2. 认知是心理上的符号运算;

3. 认知是问题求解;

4. 认知是思维;

5. 认知是一组相关的活动,如知觉、记忆、思维、判断、推理、问题求解、学习、想象、概念形成、语言使用等

#### 认知的分类

**经验认知**和**思维认知**

#### 感知和认知的定义及关系 :heavy_exclamation_mark:

> 感觉得背

感知:即通过人体器官和组织进行人与外部世界的信息的交流和传递

认知:人们在进行日常活动时发生于头脑中的事情,它涉及思维、记忆、学习、幻想、决策、看、读、写和交谈等

关系:感知是认知的基础,认知是将感知获取的信息综合应用

### 感知

#### 种类

视,听,嗅,味,触

#### 视觉

##### 一些性质

- 与外界联系最重要的通道 **80%信息来源**

- 视觉感知的两个阶段:接受信息和解释信息

##### 特点

- 一方面,物理特性决定了人类无法看到一些事物

- 另一方面,解释处理信息时可对不完全的信息发挥一定想象力

##### 视敏度

指**人眼对细节的感知能力**,通常用被辨别物体最小间距所对应的视角的倒数表示。

##### 图像识别

> 只考一题?

两种理论:**模板匹配**和**原型匹配(格式塔心理学)**

###### 格式塔

格式塔即任何分离的整体,认为整体比局部更优先被感知

##### 阅读 :heavy_exclamation_mark:

> 很重要;感觉会考?

三个阶段

1. 页面上文字的形状被人眼感知

2. 文字被编码成相关的内部语言表示

3. 语言在人脑中被解释成有语法和语义的单词或句

##### 颜色模型

> 顶多一道选择题?

- RGB(加性原色系统)

- CMYK(减色原色系统)

- HSV(色调、饱和度、亮度)

#### 信息表示方法

> 小概率?

信息的显示方式对于人们能否快速捕捉到所需的信息片断有很大的影响。**分类显示**的信息就比较便于人们查找

### 识别

:heavy_exclamation_mark:人的***识别能力大于回忆能力***

> 重复过,感觉会考

#### 人脸识别 :heavy_exclamation_mark:

在人脸的感知中,全局特征一般是用来**进行粗略的匹配**,局部特征一般是用来提供更为**精细的确认**

脸部的识别为整体优先,物体的识别为局部优先

##### 对于人脸的识别下面说法正确的是

- 人脸的上半区域的识别的重要性要高于下半区域。

- 个性化特征可以用于更加精确的识别。

- 特殊脸比大众脸型更容易被记住和识别。

#### 记忆

三个环节:**识记,保持,再认和回忆**

#### 交互设计

1. 应考虑用户的记忆能力,勿使用过于复杂的任务执行步骤。

2. 由于用户长于“识别”而短于“回忆”,所以在设计界面时,应使用菜单、图标,且它们的位置应保持一致。

3. 为用户提供多种电子信息(如文件、邮件、图像)的编码方式,并且通过颜色、标志、时间戳、图标等,帮助用户记住它们的存放位置

### 场依存性与场独立性:heavy_exclamation_mark::heavy_exclamation_mark::heavy_exclamation_mark:

> wh说必考,猛猛背 考个鸡脖,a卷无

场依存性的人:

1. 独立性差,并且容易受暗示;比较容易受当时环境中的其它事物(包括知觉者本身的状况)的影响,很难离析出知觉单元。

2. 倾向于以外在参照(客观事物)作为信息加工的依据。

场独立性的人

1. 有较大的独立性,并且不易受暗示;比较少受知觉当时的情境影响,比较易于离析出知觉单元。

2. 倾向于更多地利用内在参照(主体感觉)。

### 认知概念框架

四种框架

1. 思维模型

2. 信息处理模型

3. 外部认知模型

4. 分布式认知模型

### 信息处理模型

> wh提了

## Chapter 3 事件相关电位概述

### 脑活动测量方法 :heavy_exclamation_mark:

- **脑电图(EEG)——时间分辨率最高**

- 脑磁图(MEG)

- 功能性磁共振成像(fMRI)

- **功能性近红外成像(fNIR)——空间分辨率最高**

- 正电子发射断层扫描(PET)

- 功能性经颅多普勒超声(fTCD)

### 脑神经活动特点及脑电产生原理

脑电首次发现**贝鲁加**

>wh提到了

#### 脑的工作原理

人的感觉、情感、动作、包括不能意识和控制得体内活动都是由**电化学、生物活动**左右

##### 突触结构

突触的结构包括**突触前膜(突触小泡)、突触间隙、突触后膜(受体)**

#### 脑电(EEG)产生原理

1. 活的人脑一直会不断放电,产生脑电波

2. 是由大脑大量的神经组织的活动产生的

3. 是由皮质中的神经组织突触后点位同步总和而成的

#### 脑电测量的基准 :heavy_exclamation_mark:

CZ

##### 电极名称

Fp=额极(frontal pole);

F=额(frontal);

C=中央(central);

P=顶(parietal);

O=枕(occipital)

T=颞(temporal)

#### 脑电节律

1. alpha波:8-13Hz

2. beta波:13-30Hz

3. Theta波:4-8Hz

4. Delta波:0.5-4Hz

### 事件相关电位(ERP)的概念及特点 :heavy_exclamation_mark:

>大概率会考

#### ERP的定义 :heavy_exclamation_mark::heavy_exclamation_mark:

事件相关电位是由外加的一种**特定刺激**,作用于**感觉系统**或**脑**的某一部位,再**给予**刺激或**撤销**刺激时,在脑区所引起的**电位**变化。被认为是**心理行为**的一种客观表现形式。

#### ERP的特点

1. **潜伏期恒定**

2. **波形恒定**

#### ERP的优点和缺点

优点:

1. 优异的时间分辨率

2. 推断受实验调控影响的认知过程

3. 识别多个认知神经过程

4. 认知过程的内隐性测量

5. 可以作为一些医疗应用的生物标志物

缺点:

1. 仅仅是脑活动的外在反应,无法提供实际的脑活动机制(这在大部分的测量系统里都存在);

2. 代表了许多潜在成分的总和(即为多个成分的叠加),**无法判断这些潜在成分的神经元活动位置;**

3. 有些心理或神经过程可能并不存在对应的ERP。必须满足特殊的生物物理学条件时,ERP才是可记录的;

4. ERP相对噪声水平来说时很小的,需要多次测量才能够得到;噪声产生的来源非常广泛;

5. 时间跨度不能特别长

#### 相较于其他生理测量手段

1. 无创伤性,但是干扰明显。

2. 时间分辨率高(ms级),但是空间分辨率不足(大脑表层);

3. 价格便宜

#### ERP的起源

##### 神经元细胞的主要电活动

- 动作电位

- 突触后电位

**ERP 几乎都是起源于突触后电位**

**仅有小部分的大脑活动能够引发头皮表面的ERPs**

1. 头皮上的ERP通常并不是由动作电位引发的(除刺激后几十毫秒内出现的听觉响应外)。

2. 数以千计的且有类似朝向的神经元引发的电偶极子相互叠加时,才能够在头皮表面观察到。

3. 头皮上记录到的ERPs几乎总是反应了锥体细胞(皮层中主要的输入-输出细胞)的神经传导。

##### ERP为什么总是反应了锥体细胞的神经传导? :heavy_exclamation_mark::heavy_exclamation_mark:

锥体细胞是皮层中主要的输入-输出细胞,它们的朝向与皮层表面垂直,所以他们的偶极子会相互叠加,而不是抵消。

#### 影响ERPs成分的极性的因素

四个因素

- 突触后电位是兴奋性还是抑制性

- 突触后电位是发生于尖端树突,还是发生于基底树突和细胞体;

- 所形成的偶极子相对于活动记录电极的位置朝向;

- 参考电极的位置

#### 获取ERP的生理条件

- 大量神经元必须同时活动;

- 神经元个体之间必修具有大致相同的朝向;

- 大部分神经元中的突触后电位必须来自于神经元中的同一部位(尖端树突或者细胞体和基底树突)

- 大部分神经元必须具有相同的电流方向,以避免相互抵消

#### ERPs数据获取

获取到的ERP数据是给定电极的电压和频率所有的潜在成分的**加权总和**,但是,人们感兴趣的是**单个成分**。

##### ICA:heavy_exclamation_mark::heavy_exclamation_mark::heavy_exclamation_mark:

>wh说必考

独立成分分析(Independent Component Analysis,简称ICA)是一种用于多维信号分离的统计方法,旨在将多个混合信号分解为独立的成分。

==**目的**:==

1. ==从混合信号中提取出各独立的信号分量。==

2. ==滤除伪迹。==

### 脑电特征

#### 脑电基线

每一个波上下偏移时都会依据自己的中心点,将连续脑电波的每一个中心点连接起来,就会成为一个近似的直线,该线被称为基线。

基线平稳:中心轴线为一条直线或近似直线

基线不平稳:若形成一条波幅高于25μV,时间大于1000ms缓慢移动的曲线

基线欠稳:波幅小于25μV。则成为基线欠稳

##### 基线矫正的目的 :heavy_exclamation_mark:

消除由于时间或其他外部因素造成的信号偏移,从而使信号能够准确地反映实际的情况。

==根据时间的不一样,脑电的活动不一样,脑电波形是有偏移的,这是一个外部问题,所以要将它从偏移上拉下来,做一个近似直线。这样才能很好的观察到波形的存在==

> 考的基线移除?反正不会随便写上去了

#### 伪迹

生物伪迹

- 眼伪迹

- 心电伪迹

- 肌电伪迹

- 舌动伪迹

- 皮点伪迹

##### 几种伪迹图 :heavy_exclamation_mark:

> 分辨伪迹

## Chapter 4 ERP成分

### 概述

#### ERP的成分的定义

1. 概念性的定义:一个ERP的成分是当大脑执行某个特定的计算信号时,产生于某个特定的神经解剖学模块,并且可以在头皮上记录到的神经信号。**(ERP的本质)**

2. 实用性的定义:一个成分为一些电位的变化,它们符合单一的神经产生源位置,并且在不同的实验条件、时间段、个体等等之间出现系统性的变化。

**即:一个ERP成分是一个ERP数据集内具有系统性和稳定性的变异源。**

3. 习惯性的定义:如果结构简单、且对应与一个单偶极子(或者一对在左右半球间呈镜像堆成的偶极子)相符,我们可以暂且认为它是个单一成分。

#### ERP成分分类

ERP有多种分类,主要的有根据**刺激成分、感觉通路及潜伏期**三种分类方法

##### 根据潜伏期分类

- 早

- 中

- 晚成

- 慢波

##### 根据刺激成分分类

- 由刺激呈现而强制性诱发的**外源性感官成分**

- 完全反应任务相关神经过程的**内源性成分**

- 伴随运动准备和执行过程的**运动成分**

##### 根据感觉通路分类

- 听觉诱发电位

- 视觉诱发电位

- 体感诱发电位

#### ==ERP成分解释时避免歧义的方法==

>一道多选题

1. **聚焦于单个成分**;一个实验仅仅关注一个或两个ERP成分,尽量使其他所有成分在不同的条件之间保持不变。

2. **聚焦于较大的成分**;当感兴趣的成分远大于其它成分时,它在观测波形中占据主导,此时对该成分的测量,相对来说不太容易受到来自其它成份的干扰。

3. **从其它领域中劫持有用的成分**;利用与实验主题本不明显相关的成分来进行解释。

4. **采用经过充分研究的实验操作**;考察一个已被研究过的ERP成分,且尽可能保持实验条件与先前该成分研究时的条件类似。

5. **利用差异波**;差异波有助于分离特定的ERP成分,但是解释的时候需要小心。这也是目前应用的越来越多的方法。

6. **聚焦容易分离的成分**;利用某个成分研究其之前发生的加工过程,不同条件之间出现的差异在逻辑上意味着某些过程已经发生了。

7. **利用某个成分研究其之前发生的加工过程**;不同条件之间出现的差异在逻辑上意味着某些过程已经发生了。

8. **与成分无关的实验设计**;利用许多已有策略都聚焦于可以分离出特定的ERP成分,完全回避这些特定成分的识别问题,也能够有效的解释需要注意的成分。

### 听觉和视觉诱发电位 :heavy_exclamation_mark::heavy_exclamation_mark:

>wh说视觉,听觉必考一个

#### 视觉诱发电位(VEP):heavy_exclamation_mark::heavy_exclamation_mark:

:heavy_exclamation_mark: **研究枕叶皮层对视觉刺激产生的电活动**

##### C1成分 :heavy_exclamation_mark:

> 比较重要

1. 通常发生在P1之前(不一定会出现);

2. 在头皮后部中线处的电极上;

3. 下视野的刺激诱发的C1为正性,上视野的刺激诱发的是负性。

***C1的产生极性出现不同的原因是什么?***

在实验中,如果诱发的成分产生区域为距状裂上方的区域,由于其负责编码下方的视野,则产生的为正性。如果刺激诱发的是距状裂下方的区域,由于其负责编码上方的视野,则产生的C1为负性。

##### P1 成分 :heavy_exclamation_mark:

> 比较重要

***特性***

1. 第一个主要的视觉成分;

2. 通常起始于刺激后60-90ms,并于100-300ms达到峰值;

3. **潜伏期受刺激对比度**的影响非常大;

4. 对**刺激参数敏感**,受**选择性注意**和受试者**觉醒状态控制**;

5. 振幅对于刺激是否与任务下的**靶刺激类别匹配不敏感**

***位置***

- 最大幅值位于侧向枕叶电极;

- **早期成分产生于背侧纹外皮层,晚期成分产生于梭状回的腹侧部分**

##### N1 成分 :heavy_exclamation_mark:

> 比较重要

**N1对注意力敏感**

1. 紧随在P1后面;

2. 包含多个子成分;

- 这些子成分在功能上不一定关联,被称为子成分的原因是因为它们共同构成了波形中的一个显著偏转。

- 最早的子成分峰值出现在刺激后100-150ms,位于前部头皮电极位置;

- 在后部电极位置,至少有2个N1成分的峰值出现在刺激后150-200ms,一个来自顶叶皮层,另一个来自外侧枕叶皮层;

3. 具有高度的不应性;如果短时间内接连出现两个刺激,那么第二个刺激诱发的响应会减少许多

##### P2 成分 (我赌它不考)

#### ==听觉诱发电位(AEP) :heavy_exclamation_mark::heavy_exclamation_mark:==

> 背吧感觉会考,果然考了,明年感觉还会考

这是一个简单听觉(嘀嗒声)诱发的脑电。

0-10ms: 体现了来自耳蜗的信息经过脑干传递到丘脑的过程;这些听觉脑干响应,通常用罗马数字进行标记。 这些响应是高度自动的,可以用来评估听觉通道的完整性。

10-50ms:中潜伏期响应,至少部分来自内次膝状体和初级听觉皮层。注意力对该部分有调控作用。

50ms-:长潜伏期响应。(通常顺序为P50(P1),N100(N1)和P160(P2))这个潜伏期比高级认知成分低,但从听觉器官的特性来说,100ms相对比较晚了。受到高级认知的影响,如注意力、觉醒度等。

### 主要成分 :heavy_exclamation_mark::heavy_exclamation_mark:

#### 关联性负变(CNV)

**标志着现代ERP研究的正式开始**

> 考了一道填空

> 说不定明年就考到上面这句话了

>

==CNV被认为主要与***心理因素***有关。比如期待、意动、朝向反应、觉醒、注意、动机等,可以认为它基本上是一个**综合**的心理准备状态的反映,处于**紧张或应急状态**的反映。==

#### N2

N2a是一个由听觉刺激匹配条件自动诱发的效应,甚至当刺激与任务无关的时候也会被诱发。这一效应通常被称为**失匹配负波**(mismatch negativity,MMN)

#### 失匹配负波(MMN)

产生于**额叶和颞叶**

由于MMN具有**高度的自动性**,对于无法容易做出行为反应的人群进行研究就会非常有用:如不会说话的婴儿、处于昏迷状态的人

##### 差异波

**目的**:是去除相同的内容,得到较为纯粹的成分

**前提**:两种条件的心理活动或者机制的差异是清楚的,不包含其他成分

#### N2pc

“N”——负波,“2”——200ms左右出现,“pc”——posterior contralateral,即对侧脑后区域。

N2pc 是一种与**空间选择性注意**密切相关的ERP 成分, 反映了对当前任务相关刺激所进行的空间选择加工

##### N2pc相关结论

1. N2pc对研究注意是否已被隐性的转移至特定物体,以及注意转移的时间过程时非常有用;

2. N2pc能够被用来判断注意是否会自动地被明显但无关的物体所捕获;

3. N2pc可以证明被遮掩的阈下物体仍然能够吸引注意。

4. 与奖赏有关的物体可以诱发更快的注意转移;

5. 注意力在某些视觉搜索任务下是以串行方式在物体间转移的;

6. 精神分裂症患者在某些条件下的注意转约速度和正常人一样快。

##### N2pc产生区域

- 视觉皮层V4区

- 外侧枕叶皮层复合体位置

#### P300

##### P300的特点 :heavy_exclamation_mark::heavy_exclamation_mark:

**振幅**:P300波幅与概率成**反比**,靶与非靶皆然

**潜伏期**:P300的潜伏期随任务**难度的增加而增加**

判断同义词的任务较难,潜伏期较长

#### N400

##### 诱发N400

- 阅读中的歧义信息

- 特殊的图片特征

- 面孔识别

## Chapter 5 实验范式

典型范式

- Oddball范式

- Go-Nogo范式

- 特定认知领域实验研究范式

### 靶刺激

- 靶刺激是需要被测做出反应的⽬标刺激;

- 在Oddball实验中,通常将偏差刺激作为靶刺激。

- 根据实验需求,靶刺激可以是偏差刺激,也可以是新异刺激。

### Oddball实验范式

==经典Oddball范式也被称为**基于概率的实验范式**,是在一项实验中随机呈现**同一种感觉通道**的两种刺激,两种刺激的概率相差很大,大概率者即经常出现者称为**标准刺激**,小概率者即偶然出现者称为**偏差刺激**。==

> 典,我赌明年继续考

>

将**偏差刺激作为靶刺激**

***可用来获取P300成分,MMN成分***

### Go-Nogo实验范式

#### 与Oddball范式的区别

- 取消标准刺激与偏差刺激之间的概率差别;

- 需要被试者反应的刺激为Go刺激,不需要反应的为Nogo刺激。

### 知觉和意识研究的实验范式

#### 视觉的局部优先与整体优先 :heavy_exclamation_mark:

> 一道填空题

>

==物体认知:局部优先,物体的识别常常被表征为各部件的外形==

==脸部认知:整体优先,脸部常常被表征为一个整体==

#### 视运动知觉启动范式

##### 理论基础

>草 多选改大题,md没背下来

1. ==视觉感知是可以被诱导的(或者被启动的);==

2. ==视觉运动知觉的启动是一种非意识加工的脑机制;==

##### 相关论述

1. ==某一特定运动方向的视觉刺激,即使是非意识的也能使视觉运动知觉偏向它们的方向。==

2. ==视运动知觉启动可以提供一种非意识加工脑机制的研究方向。==

### 视觉注意研究的实验范式(空间注意提示范式)

> wh和题目都只有空间注意提示范式,前面的早期实验就没管了

:heavy_exclamation_mark:在经典视觉注意实验中,当有效刺激诱发的 **P1** 和 **N1** 成分比无效、中性刺激诱发的明显增大。

#### 概述 :heavy_exclamation_mark:

##### 基本范式

注视点 —— 提示 —— 靶

##### 特点

1. 搜索时的心理活动主要是注意的选择;

2. 搜索到靶后对靶的属性进行分辨,分辨过程的心理活动中含有注意的集中;

3. 可以改变提示信息的有效性、提示与靶的间隔、提示范围大小等来研究各种视觉空间注意的脑机制。

#### 有效提示与无效提示

提示的有效与无效,指的是提示信息对指定的任务所起到的作用真实与否,即**提示信息能否正确反应靶刺激的情况**。

#### 符号性提示又称内源性提示

#### 周围提示

更容易诱发 **P1**和**N1**

#### 提示与靶的间隔

##### 注意的分类

- 随意注意

- 非随意注意

##### 提示与靶的间隔对注意的影响

**原因**:随意注意和非随意注意的***来源、性质、功能以及脑内加工的机制不同***

- 随意注意:又被称为内源性注意,提示与靶的间隔长(大于500ms)、提示有效率高(大于70%)

- 非随意注意:又被称为外源性注意,提示与靶的间隔短(小于300ms)、提示有效率低(小于50%)

#### 上、下视野提示

下视野为优势视野

#### 结论

- 三种刺激诱发的N2pc在潜伏期和头皮分布上相同;

- 运动靶的N2pc虽然稍大,但系运动靶会比颜色靶、方向靶自动吸引更多注意资源所致;

- **颜色、方向与运动的搜索动用的是同一个注意系统。**

### 记忆研究的实验范式

#### 工作记忆实验范式 :heavy_exclamation_mark::heavy_exclamation_mark:

##### 工作记忆分类 :heavy_exclamation_mark:

*三个子系统*

- 中央执行系统

- 语音回路

- 视觉空间存储

##### ==认知加工的三个阶段==

> 听wh说的感觉会考,考了

使用**样本延迟匹配**范式(任务)对其进行研究

- ==样本阶段 —— 信息编码输入==

- ==延迟阶段 —— 信息复述保持==

- ==靶阶段 —— 信息提取匹配==

##### n-back任务

n-back任务是让被试浏览一系列逐个呈现的项目,然后要求被试从第n个项目起判断每一个出现的项目是否与前面刚呈现过的倒数第n个项目匹配。

***特点:能够通过控制n的大小来操纵工作记忆的负荷,从而考察不同记忆负荷下工作记忆的加工机制***

#### 学习——再认实验范式

> wh说没怎么考,考了个多选

**发现的新效应**

- ==相继记忆效应==

- ==重复效应==

- ==新旧效应==

- ==内隐记忆效应==

#### 语言文字研究的实验范式(N400)

其重要意义不仅在于发现了N400的成分,主要是它成功的将**ERP**运用到了**语言心理学**中

##### 研究N400的实验

- 句尾畸义词,N400经典范式;

- 相关词与无关词,词性不同、反义词、无关词产生明显的N400;**近义词不产生**

- 新词与旧词,首次出现的新词与重复出现的旧词,新词可以诱发更正的N400;

- 文字与非文字符号;

- 图片命名,图片内容和名称的匹配

##### 哪些刺激诱发N400

- 阅读中的歧义信息。

- 特殊的图片特征

- 面孔识别

### 情绪与认知相互关系研究的实验范式

#### 需要注意的因素

1. 情绪的快速可变性

2. 影响情绪的因素很多

3. 情绪往往具有延迟性,会影响到我们设计的实验中情绪的测量。

#### 一些结论

- 一个人的情绪能够被外来的图片刺激、声音刺激、气味等所感染,诱发**杏仁核**的活动

- 然情绪能够被**外界**所诱发,但是从心理学、生理学角度来说,情绪是一种**无意识**的诱发。

- 情绪活动常伴随一系列生理活动的变化,通过**自主神经系统**和**内分泌系统活动**的改变引起的

- 研究发现,焦虑情绪会选择性的**干扰空间工作记忆任务**,但**未影响词语工作记忆**,因此,情绪对认知的影响**不是全脑水平的**,其交互作用更为复杂。

#### 无意识诱发

本能的防御反应:发怒,恐惧,逃避

## Chapter 6 脑机接口与fNIRs

### 脑机接口

#### 定义

脑机接口是在人或动物脑(或者脑细胞的培养物)与外部设备间建立的直接连接通路。

#### 信号采集方法

脑机接口用到的信号采集方法有侵入式、半侵入式和脑外(非侵入式)。

#### 研究方向

- 人机互交

- 心理认知学

- 心理疾病评估

- 神经疾病诊断与康复

#### 过程

> 作业题有,wh也提了

>

>

脑机接口技术中,使用**信号分析与特征提取方法**,在预处理过程过,将EEG信号分为**5个有用的频带部分**,作为**模式识别**的特征。

#### ==为什么现在很多BCI(脑机接口)的研究都无法做到直接用大脑控制机器人,必须借助于外界的刺激?==

> 考了,但我没背的很详细,小寄

>

因为大脑的思维或反应在相关的(或不相关的)加工过程中涉及到的多个脑分区,很难通过自发的方式产生高度单一的成分,因此也很难从ERP实验中分离出高度特异的心理或神经过程。目前,借助外界的刺激,可以加强(增强)某一类ERP响应成分,从而达到控制机器人的目的。

### fNIRs

#### 原理

FNIRs成像主要测量大脑活动中,**血氧**的浓度变化

#### ==对比EEG==

> 一道大题

fNIRS

优点:

- 安全、非侵入性

- 造价相对便宜,维护成本低

- 时间、空间分辨率相对较高

- 被尝试友好度高

- 生态效率高

- 兼容性高

缺点:

- 外皮层记录

- 被试间脑区解剖位置差异

- 信噪比较低

EEG

优点:

- 时间分辨率极高:EEG的时间分辨率非常高,能够捕捉到快速的脑电活动变化。

- 成本相对较低:相对于fNIRS,EEG的设备和维护成本更低。

- 广泛的临床应用:EEG在临床诊断(如癫痫)中有着长期而广泛的应用。

- 便于重复测量:EEG设备相对轻便,便于进行长时间或重复的测量。

缺点:

- 空间分辨率低:EEG的空间分辨率较低,难以精确确定脑活动的具体位置。

- 信号可能受到伪影的干扰:头发、肌肉活动、眼动等都可能对EEG信号产生干扰。

- 实验设置和电极放置要求严格:EEG需要精确的电极放置和常常较长的准备时间。

## Chapter 7 眼动

> 压根没考

### 常用指标

- 访问时长

- 首次注视时间

- 访问次数

- 访问百分比

**眼跳潜伏期:** 刺激呈现到第一个眼跳开始的时间。潜伏期越短,表明当前目标的加工越简单。

================================================

FILE: 学习资料(非电子书)/计算机体系结构/README.md

================================================

# 计算机体系结构

资料链接: [[百度网盘](https://pan.baidu.com/s/1cWcpP6JG2uz-bfXeROKlHw?pwd=wxy2)]

1. PPT

- 第[1-6]章

2. 习题答案

- ...

3. 实验: SHU-Computer-Architecture-Experiments [[GitHub](https://github.com/SHUSCT/SHU-Computer-Architecture-Experiments)]

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/计算机最新进展研讨/README.md

================================================

# 计算机最新进展研讨

资料链接: [[百度网盘](https://pan.baidu.com/s/15FWenseWqKsxLoLgFk2UKA?pwd=hj5q)]

1. 2021-2022 lv卷积神经网络综述(PPT+报告)

- ...

2. 相关文献

- 机器学习-5 深度学习的昨天、今天和明天.pdf

- 机器学习-6 7 卷积神经网络研究综述(2人).pdf

- 机器学习-8 迁移学习-回顾与进展.pdf

3. 2021-2022 研讨主题.ppt

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/计算机研究前沿/README.md

================================================

# 计算机研究前沿

资料链接: [[百度网盘](https://pan.baidu.com/s/1vihd36RRKujxbF2gSgRM3g?pwd=yxuk)]

1. lv流行病传播过程仿真实验

- netlogo仿真

- Untitled.nlogo

- 计算机研究前沿-第.pptx

- 计算机研究前沿.docx

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/计算机组成原理/README.md

================================================

# 计算机组成原理

资料链接: [[百度网盘](https://pan.baidu.com/s/1VzCASGZnF4WvSFRHO3QKMw?pwd=cce1)]

1. 原理(1)

- lv实验报告分享

- ...

- 实验指导书、PPT等

- ...

2. 原理(2)

- lv实验报告分享

- ...

- 实验指导书、PPT等

- ...

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/计算机编程实训/README.md

================================================

# 计算机编程实训

资料链接: [[百度网盘](https://pan.baidu.com/s/1jGWtNyteTXXXTVmv-X4Gfw?pwd=i663)]

1. 2020-2021夏季学期《计算机编程实训》

- lv计算机编程实训源代码+小论文

- ...

- 相关资料

- ...

- 2020-2021夏季学期《计算机编程实训》课程方案20210613.docx

- README.md

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/计算机网络/README.md

================================================

# 计算机网络

资料链接: [[百度网盘](https://pan.baidu.com/s/1cwl4r1YdL6AI_FGp4Z67jg?pwd=sy8e)]

1. 实验

- 使用GNS3完成

- GNS3+cisco 动态路由实验.md

- GNS3静态路由实验.md

- 使用GNS3完成实验指南

- GNS3+cisco 动态路由实验.md

- GNS3静态路由实验.md

- 实验辅助资料

- 《网络与通信》实验指导书(V1.0).pdf

- 706network.jpg

- Network_01.doc

- Network_02.doc

- Network_03.doc

- 静态路由及RIP和OSPF实验帮助.pdf

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/语义网络与知识图谱/README.md

================================================

# 语义网络与知识图谱

资料链接: [[百度网盘](https://pan.baidu.com/s/1zh12BQugZXsyzASwds1nig?pwd=d7ky)]

1. 2021实验手册

- 2021语义网与知识图谱实验手册-[1-6].docx

2. 2021课件

- 2020语义网与知识图谱-第[1-8]讲.pdf

3. 实验工具及资料

- logic4cs-script.pdf

- Protégé 使用方法.pdf

4. 扩展研讨PPT

- ...

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/软件工程/README.md

================================================

# 软件工程

资料链接: [[百度网盘](https://pan.baidu.com/s/1h90VNRS5yqJUjcr99AONjA?pwd=lwx5)]

1. lv实验

- README.md

- 实验[1-8].docx

2. 2019冬软工总复习.ppt

3. 上海大学2021-2022软件工程主观题考卷(A).pdf

4. 复习.ppt

5. 软件设计师2017至2019年试题分析与解答.pdf

6. 软工考试类型.doc

---

Last update: Jun 28, 2024

================================================

FILE: 学习资料(非电子书)/面向对象/README.MD

================================================

# 面向对象资料

资料链接: [[百度网盘](https://pan.baidu.com/s/1X_mEVtk_Rz5fIPK29kBFlQ?pwd=ni3b)]

1. 面向对象复习笔记 [[GitHub](https://github.com/Amadeus-1048/Course-Review/blob/main/%E9%9D%A2%E5%90%91%E5%AF%B9%E8%B1%A1%E7%A8%8B%E5%BA%8F%E8%AE%BE%E8%AE%A1/%E9%9D%A2%E5%90%91%E5%AF%B9%E8%B1%A1%E5%A4%8D%E4%B9%A0%E7%AC%94%E8%AE%B0.md)]

2. 历年试题

- 2004-2020

3. 课程小项目

- 单向链表类模板应用---音乐资料库

- ...

- 向量类模板实现

- ...

- 封装C-字符串

- ...

- 抽象向量类模板及其派生类

- ...

---

Last update: Jun 28, 2024

================================================

FILE: 就业相关/八股笔记/个人珍藏八股笔记,看缘分更新.md

================================================

# 笔记

# ==408==

## 一、TCP

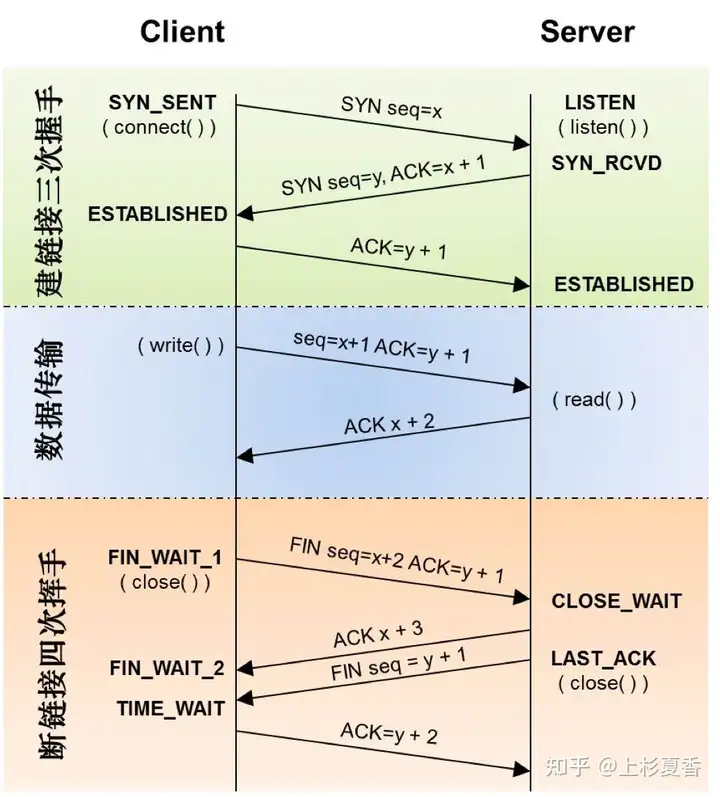

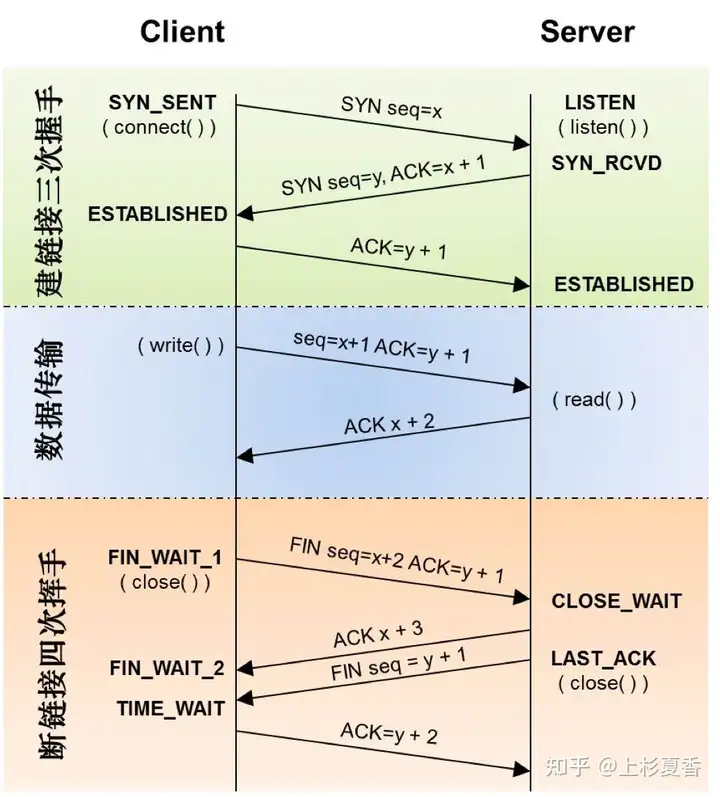

seq代表从对方的何处开始发消息:我把数据从你的seq处开始发(你的上一次的ack所要求的)

ack代表对方从我的何处发消息:你下一次发送消息到我的ack处开始发

因此回复的ack=seq+len

初始连接时SYN占据一个字节,相当于发送len=1的包,所以ack=x+1

结束时FIN同理

TCP 协议保证数据传输可靠性的方式主要有:

- **校验和**:TCP 将保持它首部和数据的检验和。这是一个端到端的检验和,目的是检测数据在传输过程中的任何变化。如果收到段的检验和有差错,TCP 将丢弃这个报文段和不确认收到此报文段。

- **序列号**:TCP 传输时将每个字节的数据都进行了编号,这就是序列号。(为了应对延时抵达和排序混乱)。每个连接都会选择一个初始序列号,初始序列号(视为一个 32 位计数器),会随时间而改变(每 4 微秒加 1)。因此,每一个连接都拥有不同的序列号。序列号的作用不仅仅是应答的作用,有了序列号能够将接收到的数据根据序列号排序,并且去掉重复序列号的数据。这也是 TCP 传输可靠性的保证之一。

- **确认应答**:TCP 传输的过程中,每次接收方收到数据后,都会对传输方进行确认应答。也就是发送 ACK 报文。这个 ACK 报文当中带有对应的确认序列号,告诉发送方,接收到了哪些数据,下一次的数据从哪里发。

- **超时重传**:超时重传机制。简单理解就是发送方在发送完数据后等待一个时间,时间到达没有接收到 ACK 报文,那么对刚才发送的数据进行重新发送。如果是刚才第一个原因,接收方收到二次重发的数据后,便进行 ACK 应答。如果是第二个原因,接收方发现接收的数据已存在(判断存在的根据就是序列号,所以上面说序列号还有去除重复数据的作用),那么直接丢弃,仍旧发送 ACK 应答。那么发送方发送完毕后等待的时间是多少呢?如果这个等待的时间过长,那么会影响 TCP 传输的整体效率,如果等待时间过短,又会导致频繁的发送重复的包。如何权衡?由于 TCP 传输时保证能够在任何环境下都有一个高性能的通信,因此这个最大超时时间(也就是等待的时间)是动态计算的。

- **连接管理**:说白了就是三次握手四次挥手。

- **流量控制**:当接收方来不及处理发送方的数据,能提示发送方降低发送的速率,防止包丢失。

- **拥塞控制**:拥塞控制是 TCP 在传输时尽可能快的将数据传输,并且避免拥塞造成的一系列问题。是可靠性的保证,同时也是维护了传输的高效性。

为什么第四次挥手客户端需要等待 2*MSL(报文段最长寿命)时间后才进入 CLOSED 状态?

第四次挥手时,客户端发送给服务器的 ACK 有可能丢失,如果服务端因为某些原因而没有收到 ACK 的话,服务端就会重发 FIN,如果客户端在 2*MSL 的时间内收到了 FIN,就会重新发送 ACK 并再次等待 2MSL,防止 Server 没有收到 ACK 而不断重发 FIN。

> **MSL(Maximum Segment Lifetime)** : 一个片段在网络中最大的存活时间,2MSL 就是一个发送和一个回复所需的最大时间。如果直到 2MSL,Client 都没有再次收到 FIN,那么 Client 推断 ACK 已经被成功接收,则结束 TCP 连接。

## 二、死锁

**一、死锁的定义**

[死锁](https://so.csdn.net/so/search?q=死锁&spm=1001.2101.3001.7020)是指,有两个或两个以上的线程在执行的过程中,由于竞争的资源或者彼此通信而造成的一种阻塞状态,若无外力作用,他们将都无法进行下去,从而形成一直阻塞的状态叫死锁。

**二、产生死锁的必要条件**

- 互斥条件

一个资源只能被一个线程所拥有的,若一个线程已经拥有了该资源,那么其他想获取该资源的线程就需要阻塞等待。

- 不可剥夺条件

当一个资源被线程获取了之后,如果该线程不主动释放该资源,那么该资源一直被占有,其他想获取该资源的线程就要一直进行等待。

- 请求并持有条件

一个线程已经拥有了一个资源,还要请求新的资源。

- 循环等待条件

产生死锁一定是发生了环路等待,形成线程资源环形链。

以上是产生死锁的四个必要条件,缺一不可,产生死锁的时候这四个条件一定是都满足的,那么就表示,要想避免死锁,破坏其中一个条件即可。

死锁实现

```java

public class DeadLockCSDN {

public static void main(String[] args) {

//资源A和B

Object A = new Object();

Object B = new Object();

//第一个线程

Thread t1 = new Thread(() -> {

//先得到资源A

synchronized (A){

System.out.println("线程1已经获得资源A");

try {

//这里线程休眠两秒是为了保证线程1拿到A

Thread.sleep(2000);

} catch (InterruptedException e) {

e.printStackTrace();

}

//拿到A之后再去获取B资源

synchronized (B){

System.out.println("线程1已经获得资源B");

}

}

});

//第二个线程

Thread t2 = new Thread(() -> {

//先获得资源B

synchronized (B){

System.out.println("线程2已经获得资源B");

try {

//保证线程2 获得资源B

Thread.sleep(2000);

} catch (InterruptedException e) {

e.printStackTrace();

}

//再去请求获得A资源

synchronized (A){

System.out.println("线程2已经获得资源A");

}

}

});

t1.start();

t2.start();

}

}

```

## 三、线程上下文切换

什么是线程上下文切换

多线程的上下文切换:是指 CPU 控制权由一个已经正在运行的线程切换到另外一个就绪并等待获取 CPU 执行权的线程的过程。CPU给每个线程分配CPU时间片(机会),多线程创建并切完到另一个线程的过程,就是上下文切换。

时间片:是指 CPU分配给每个线程的执行时间段。

CPU为了能够执行多个线程,需要不停的切换执行的线程,这样才能使所有线程在一段时间内都有被执行的机会。CPU通过时间片分配算法来循环执行任务,当前任务执行一个时间片后切换到下一个任务。但是,在切换前会保存上一个任务的状态,以便下次切换回这个任务时,可以再加载这个任务的状态。所以任务从保存到再加载的过程就是一次上下文切换。

线程上下文切换的原因

当前执行任务(线程)的时间片用完之后,系统CPU正常调度下一个任务中断处理,在中断处理中,其他程序”打断”了当前正在运行的程序。当CPU接收到中断请求时,会在正在运行的程序和发起中断请求的程序之间进行一次上下文切换。中断分为硬件中断和软件中断,软件中断包括因为IO阻塞、未抢到资源或者用户代码等原因,线程被挂起。

用户态切换,对于一些操作系统,当进行用户态切换时也会进行一次上下文切换,虽然这不是必须的。

多个任务抢占锁资源,在多任务处理中,CPU会在不同程序之间来回切换,每个程序都有相应的处理时间片,CPU在两个时间片的间隔中进行上下文切换。

理解:每个线程根据算法(优先、高响应比、多级队列反馈、时间片轮转)执行完了自己的时间片后,即使该线程还没有执行完毕,为了兼顾到密集型和长期作业,CPU也需要中断,然后将就绪态的下一个线程执行。

Linux系统下可以使用vmst[at命令](https://so.csdn.net/so/search?q=at命令&spm=1001.2101.3001.7020)来查看上下文切换的次数, 其中cs列就是指上下文切换的数目(一般情况下, 空闲系统的上下文切换每秒大概在1500以下)。

线程上下文切换存在的问题

上下文切换会导致额外的开销,常常表现为高并发执行时速度会慢串行,因此减少上下文切换次数便可以提高多线程程序的运行效率。

直接消耗:指的是CPU寄存器需要保存和加载, 系统调度器的代码需要执行, TLB实例需要重新加载, CPU 的pipeline需要刷掉。

间接消耗:指的是多核的cache之间得共享数据, 间接消耗对于程序的影响要看线程工作区操作数据的大小。

线程上下文切换优化

1、无锁并发编程:多线程处理数据时,可以用一些办法来避免使用锁,如将数据的ID按照Hash取模分段,不同的线程处理不同段的数据。

2、CAS算法:Java的Atomic包使用CAS算法来更新数据,而不需要加锁。

3、使用最少线程:避免创建不必要的线程,比如,任务量很小,使用多线程处理,就容易造成线程等待。

4、协程:单线程里实现多任务的调度,并在单线程里维持多个任务间的切换。

**合理设置线程数目既可以最大化利用CPU,又可以减少线程切换的开销。**

- 高并发,低耗时的情况,建议少线程。

- 低并发,高耗时的情况:建议多线程。

- 高并发高耗时,要分析任务类型、增加排队、加大线程数。

## 四、IO多路复用

介绍:IO 多路复用是一种同步 IO 模型,实现一个线程可以监视多个文件句柄。一旦某个文件句柄就绪,就能够通知应用程序进行相应的读写操作;没有文件句柄就绪时会阻塞应用程序,交出 cpu。IO 是指网络 IO,多路指多个TCP连接(即 socket 或者 channel),复用指复用一个或几个线程。

意思说一个或一组线程处理多个 TCP 连接。最大优势是减少系统开销小,不必创建过多的进程/线程,也不必维护这些进程/线程。IO 多路复用的三种实现方式:select、poll、epoll。

1、select机制(NIO)

> 优点:适用性好,全平台可用

>

> 缺点:采用轮询的方式全盘扫描,会随着文件描述符 FD 数量增多而性能下降。

> 每次调用 select(),都需要把 fd 集合从用户态拷贝到内核态,并进行遍历(消息传递都是从内核到用户空间)。

> 单个进程打开的 FD 是有限制(通过FD_SETSIZE设置)的,默认是 1024 个,可修改宏定义,但是效率仍然慢。

2、poll(NIO)

> 和select机制相同,只是底层使用链表实现,没有最大数量限制

3、epoll(AIO)

> epoll有EPOLLLT和EPOLLET两种触发模式,LT是默认的模式,ET是“高速”模式。LT模式下,只要这个fd还有数据可读,每次 epoll_wait都会返回它的事件,提醒用户程序去操作,而在ET(边缘触发)模式中,它只会提示一次,直到下次再有数据流入之前都不会再提示了,无 论fd中是否还有数据可读。所以在ET模式下,read一个fd的时候一定要把它的buffer读光,也就是说一直读到read的返回值小于请求值,或者 遇到EAGAIN错误。还有一个特点是,epoll使用“事件”的就绪通知方式,通过epoll_ctl注册fd,一旦该fd就绪,内核就会采用类似callback的回调机制来激活该fd,epoll_wait便可以收到通知。

==epoll的好处==

epoll为什么要有EPOLLET触发模式?

如果采用EPOLLLT模式的话,系统中一旦有大量你不需要读写的就绪文件描述符,它们每次调用epoll_wait都会返回,这样会大大降低处理程序检索自己关心的就绪文件描述符的效率.。而采用EPOLLET这种边沿触发模式的话,当被监控的文件描述符上有可读写事件发生时,epoll_wait()会通知处理程序去读写。如果这次没有把数据全部读写完(如读写缓冲区太小),那么下次调用epoll_wait()时,它不会通知你,也就是它只会通知你一次,直到该文件描述符上出现第二次可读写事件才会通知你!!!这种模式比水平触发效率高,系统不会充斥大量你不关心的就绪文件描述符

epoll的优点:

1、没有最大并发连接的限制,能打开的FD的上限远大于1024(1G的内存上能监听约10万个端口);

2、效率提升,不是轮询的方式,不会随着FD数目的增加效率下降。只有活跃可用的FD才会调用callback函数;

即Epoll最大的优点就在于它只管你“活跃”的连接,而跟连接总数无关,因此在实际的网络环境中,Epoll的效率就会远远高于select和poll。

3、 内存拷贝,利用mmap()文件映射内存加速与内核空间的消息传递;即epoll使用mmap减少复制开销。

### 总结

1、表面上看epoll的性能最好,但是在连接数少并且连接都十分活跃的情况下,select和poll的性能可能比epoll好,毕竟epoll的通知机制需要很多函数回调。

2、select低效是因为每次它都需要轮询。但低效也是相对的,视情况而定,也可通过良好的设计改善

## 五、进程和线程

1、根本区别

==进程和线程的根本区别是进程是操作系统(OS)资源分配的基本单位,而线程是处理器(CPU)任务调度和执行的基本单位。==

2、资源开销:

每个进程都有独立的代码和数据空间(程序上下文),程序之间的切换会有较大的开销;线程可以看做轻量级的进程,同一类线程共享代码和数据空间,每个线程都有自己独立的运行栈和程序计数器(PC),线程之间切换的开销小。

3、包含关系:

如果一个进程内有多个线程,则执行过程不是一条线的,而是多条线

同完成的;线程是进程的一部分,所行过程不是一条线的,而是多条线(线耗)其被称为轻权进程或者轻量级进程。

4、内存分配:

同一进程的线程共享本进程的内存空间和资源,而进程之间的地址空间和资源是相互独立的。

5、影响关系:

一个进程崩溃后,在保护模式下不会对其他进程产生影响,但是一个线程崩溃整个进程都死掉。所以多进程要比多线程健壮。

6、执行过程:

每个独立的进程有程序运行的入口、顺序执行序列和程序出口。但是线程不能独立执行,必须依存在应用程序中,由应用程序提供多个线程执行控制,两者均可并发执行。

### 5.1 进程、线程、协程的概念

进程:是并发执行的程序在执行过程中分配和管理资源的基本单位,是一个动态概念,竞争计算机系统资源的基本单位。

线程:是进程的一个执行单元,是进程内科调度实体。比进程更小的独立运行的基本单位。线程也被称为轻量级进程。

协程:是一种比线程更加轻量级的存在。一个线程也可以拥有多个协程。其执行过程更类似于子例程,或者说不带返回值的函数调用。

### 5.2 线程间的同步的方式有哪些?

线程同步是两个或多个共享关键资源的线程的并发执行。应该同步线程以避免关键的资源使用冲突。

下面是几种常见的线程同步的方式:

1. **互斥锁(Mutex)**:采用互斥对象机制,只有拥有互斥对象的线程才有访问公共资源的权限。因为互斥对象只有一个,所以可以保证公共资源不会被多个线程同时访问。比如 Java 中的 `synchronized` 关键词和各种 `Lock` 都是这种机制。

2. **读写锁(Read-Write Lock)**:允许多个线程同时读取共享资源,但只有一个线程可以对共享资源进行写操作。

3. **信号量(Semaphore)**:它允许同一时刻多个线程访问同一资源,但是需要控制同一时刻访问此资源的最大线程数量。

4. **屏障(Barrier)**:屏障是一种同步原语,用于等待多个线程到达某个点再一起继续执行。当一个线程到达屏障时,它会停止执行并等待其他线程到达屏障,直到所有线程都到达屏障后,它们才会一起继续执行。比如 Java 中的 `CyclicBarrier` 是这种机制。

5. **事件(Event)** :Wait/Notify:通过通知操作的方式来保持多线程同步,还可以方便的实现多线程优先级的比较操作。

### 5.3 进程间的通信方式有哪些?

**管道/匿名管道(Pipes)**:用于具有亲缘关系的父子进程间或者兄弟进程之间的通信。

**有名管道(Named Pipes)** : 匿名管道由于没有名字,只能用于亲缘关系的进程间通信。为了克服这个缺点,提出了有名管道。有名管道严格遵循 **先进先出(First In First Out)** 。有名管道以磁盘文件的方式存在,可以实现本机任意两个进程通信。

**信号(Signal)**:信号是一种比较复杂的通信方式,用于通知接收进程某个事件已经发生;

**消息队列(Message Queuing)**:消息队列是消息的链表,具有特定的格式,存放在内存中并由消息队列标识符标识。管道和消息队列的通信数据都是先进先出的原则。与管道(无名管道:只存在于内存中的文件;命名管道:存在于实际的磁盘介质或者文件系统)不同的是消息队列存放在内核中,只有在内核重启(即,操作系统重启)或者显式地删除一个消息队列时,该消息队列才会被真正的删除。消息队列可以实现消息的随机查询,消息不一定要以先进先出的次序读取,也可以按消息的类型读取.比 FIFO 更有优势。**消息队列克服了信号承载信息量少,管道只能承载无格式字 节流以及缓冲区大小受限等缺点。**

**信号量(Semaphores)**:信号量是一个计数器,用于多进程对共享数据的访问,信号量的意图在于进程间同步。这种通信方式主要用于解决与同步相关的问题并避免竞争条件。

**共享内存(Shared memory)**:使得多个进程可以访问同一块内存空间,不同进程可以及时看到对方进程中对共享内存中数据的更新。这种方式需要依靠某种同步操作,如互斥锁和信号量等。可以说这是最有用的进程间通信方式。

**套接字(Sockets)** : 此方法主要用于在客户端和服务器之间通过网络进行通信。套接字是支持 TCP/IP 的网络通信的基本操作单元,可以看做是不同主机之间的进程进行双向通信的端点,简单的说就是通信的两方的一种约定,用套接字中的相关函数来完成通信过程。

### 5.4 JAVA中线程同步方式

线程同步主要包括四种方式:

- 互斥量`pthread_mutex_`

- 读写锁`pthread_rwlock_`

- 条件变量`pthread_cond_`

- 信号量`sem_`

> 1、synchronized 关键字

>

> 2、Lock 接口

>

> 3、volatile

>

> 4、使用重入锁实现线程同步ReenreantLock类

>

> 5、使用局部变量实现线程同步 如果使用ThreadLocal管理变量,则每一个使用该变量的线程都获得该变量的副本,

>

> 6、使用阻塞队列实现线程同步LinkedBlockingQueue 类

>

> 7、使用原子变量实现线程同步AtomicInteger类

## 六、HTTP和HTTPS的区别

**1、加密**

加密是 HTTP 和 HTTPS 之间的主要区别之一。HTTPS 使用 SSL 或 TLS 来加密数据,使其比 HTTP 安全得多。当通过 HTTPS 传输时,数据在通过 Internet 发送之前被加密。这种加密有助于防止未经授权访问敏感数据,例如信用卡号和密码。

**2、证书认证**

证书认证是 HTTP 和 HTTPS 的另一个区别。当 Web 浏览器通过 HTTPS 连接到 Web 服务器时,服务器会向浏览器发送数字证书。该证书包含特定于服务器的信息,包括服务器的公钥。浏览器随后使用此证书与服务器建立安全连接。

**3、端口号**

HTTP 使用端口 80,而 HTTPS 使用端口 443。这意味着当您通过 HTTP 访问网站时,URL 以 开头http://,而通过 HTTPS 的 URL 以 开头https://。

**4、表现**

由于加密和解密数据的额外开销,HTTPS 通常比 HTTP 慢。然而,SSL 和 TLS 协议的进步显着降低了这种开销,使 HTTPS 比以前快得多。

## 七、HTTP 1.0/1.1/2.0/3.0

==**HTTP/1.0** 默认是短连接,可以强制开启,HTTP/1.1 默认长连接,HTTP/2.0 采用**多路复用**,HTTP/3.0基于UDP==

**HTTP/1.0**

- 默认使用**短连接**,每次请求都需要建立一个 TCP 连接。它可以设置`Connection: keep-alive` 这个字段,强制开启长连接。

**HTTP/1.1**

- 引入了持久连接,即 TCP 连接默认不关闭,可以被多个请求复用。

- 分块传输编码,即服务端每产生一块数据,就发送一块,用” 流模式” 取代” 缓存模式”。

- 管道机制,即在同一个 TCP 连接里面,客户端可以同时发送多个请求。

**HTTP/2.0**

- 二进制协议,1.1 版本的头信息是文本(ASCII 编码),数据体可以是文本或者二进制;2.0 中,头信息和数据体都是二进制。

- 完全多路复用,在一个连接里,客户端和浏览器都可以同时发送多个请求或回应,而且不用按照顺序一一对应。

- 报头压缩,HTTP 协议不带有状态,每次请求都必须附上所有信息。Http/2.0 引入了头信息压缩机制,使用 gzip 或 compress 压缩后再发送。

- 服务端推送,允许服务器未经请求,主动向客户端发送资源。

### [#](https://tobebetterjavaer.com/sidebar/sanfene/network.html#_16-http-3-了解吗)16.HTTP/3 了解吗?

HTTP/3 主要有两大变化,**传输层基于 UDP**、使用**QUIC 保证 UDP 可靠性**。

HTTP/2 存在的一些问题,比如重传等等,都是由于 TCP 本身的特性导致的,所以 HTTP/3 在 QUIC 的基础上进行发展而来,QUIC(Quick UDP Connections)直译为快速 UDP 网络连接,底层使用 UDP 进行数据传输。

HTTP/3 主要有这些特点:

- 使用 UDP 作为传输层进行通信

- 在 UDP 的基础上 QUIC 协议保证了 HTTP/3 的安全性,在传输的过程中就完成了 TLS 加密握手

- HTTPS 要建⽴⼀个连接,要花费 6 次交互,先是建⽴三次握⼿,然后是 TLS/1.3 的三次握⼿。QUIC 直接把以往的 TCP 和 TLS/1.3 的 6 次交互合并成了 **3** 次,减少了交互次数。

- QUIC 有⾃⼰的⼀套机制可以保证传输的可靠性的。当某个流发⽣丢包时,只会阻塞这个流,其他流不会受到影响。

# ==数据库相关==

## **一、数据库基本操作**

- 创建数据库MySQL命令:

```sql

create database 数据库名称;

```

- 删除数据库MySQL命令:

```sql

drop database 数据库名称;

```

- 查询出MySQL中所有的数据库MySQL命令:

```sql

show databases;

```

- 将数据库的字符集修改为gbk MySQL命令:

```sql

alter database db1 character set gbk;

```

- 查看当前使用的数据库 MySQL命令:

```sql

select database();

```

- 创建表

```sql

create table 表名(

字段1 字段类型,

字段2 字段类型,

…

字段n 字段类型

);

```

- 查看当前数据库中所有表 MySQL命令:

```sql

show tables;

```

- 查看表的字段信息 MySQL命令:

```sql

desc 数据库名称;

```

- 修改表名 MySQL命令:

```sql

alter table student rename to stu;

```

- 修改字段数据类型 MySQL命令:

```sql

alter table stu modify sname int;

```

- 增加字段 MySQL命令:

```sql

alter table stu add address varchar(50);

```

- 删除字段 MySQL命令:

```sql

alter table stu drop address;

```

- 删除数据表 MySQL命令:

```sql

drop table 表名;

```

- 外键约束即FOREIGN KEY常用于多张表之间的约束。基本语法如下:

```sql

-- 在创建数据表时语法如下:

CONSTRAINT 外键名 FOREIGN KEY (从表外键字段) REFERENCES 主表 (主键字段)

-- 将创建数据表创号后语法如下:

ALTER TABLE 从表名 ADD CONSTRAINT 外键名 FOREIGN KEY (从表外键字段) REFERENCES 主表 (主键字段);

```

- 删除外键 MySQL命令:

```sql

alter table 从表名 drop foreign key 外键名;

```

## 二、数据库疑难

mybitis中foreach使用需要让服务器允许执行多条sql。

## 三、**数据库连接、重启相关**

**==一、启动、停止、重启==**

一、启动

1、使用 service 启动:service mysqld start

2、使用 mysqld 脚本启动:/etc/inint.d/mysqld start

3、使用 safe_mysqld 启动:safe_mysqld&

二、停止

1、使用 service 启动:service mysqld stop

2、使用 mysqld 脚本启动:/etc/inint.d/mysqld stop

3、mysqladmin shutdown

三、重启

1、使用 service 启动:service mysqld restart

2、使用 mysqld 脚本启动:/etc/inint.d/mysqld restart 展开

## **四、数据库原理**

### 1、索引

#### 1.1 索引结构

#### 1.2 ==B+tree的好处:==

#### 1.3 索引查询过程

二级索引可以多个,自己设置,聚集索引默认为主键,若无通过自动创建。

过程:

- 先按照索引在B+树中查询到对应的聚集索引。

- 再通过聚集索引查询到该行的数据。

#### 1.4 索引创建&删除

- 创建

```sql

//创建唯一(聚集)索引,unique关键字

create unique index idx_xxx on user(xxx);(表名+字段名)

//创建二级索引,无unique关键字即可

create index idx_xxx on user(xxx);(表名+字段名)

```

- 删除

```sql

drop index xxx on xxx;

```

#### 1.5 查询某一张表的索引

```sql

show index from xxx;

```

## 五、数据库杂语句

```sql

-- 查看服务器语句使用量

show GLOBAL STATUS LIKE 'Com_______';

```

- 结果大致样子

## 六、数据库八股

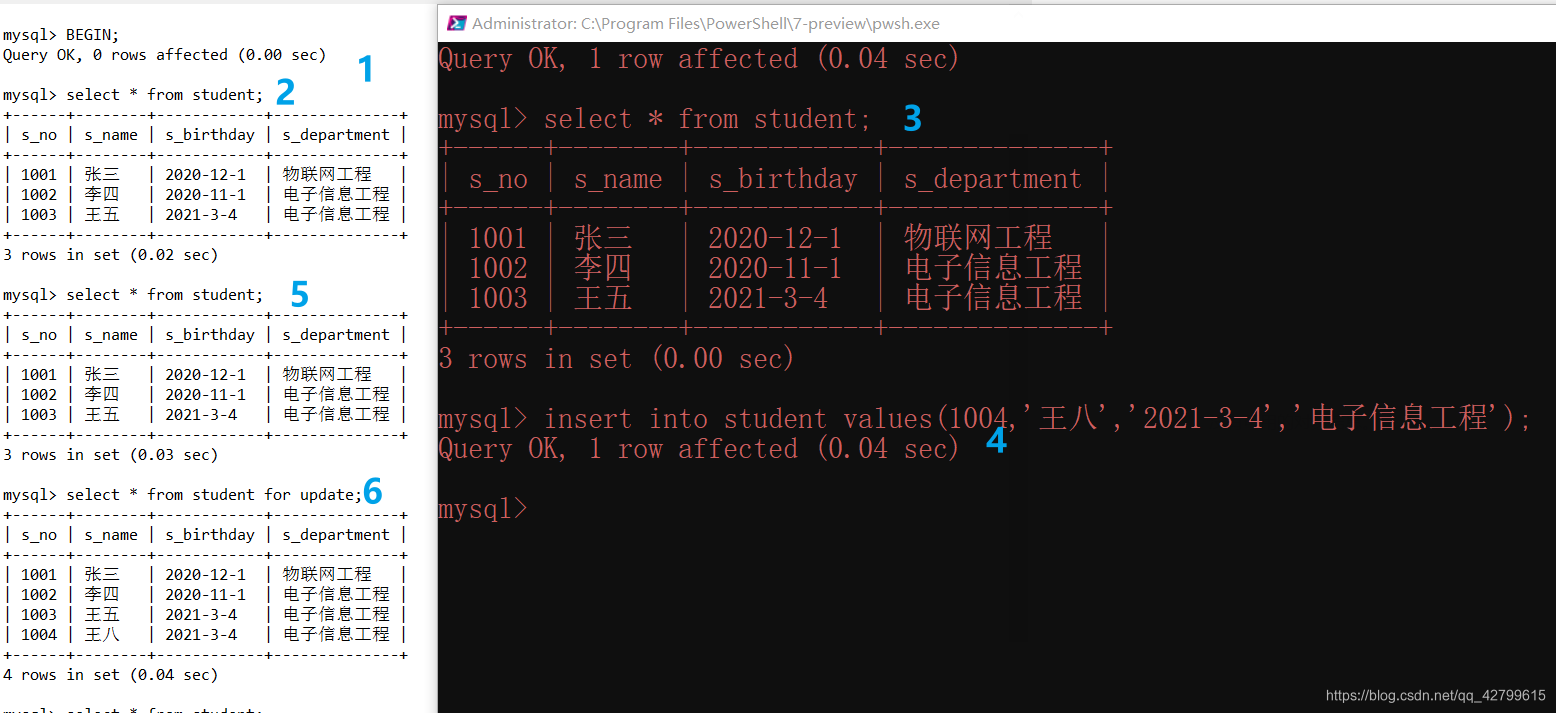

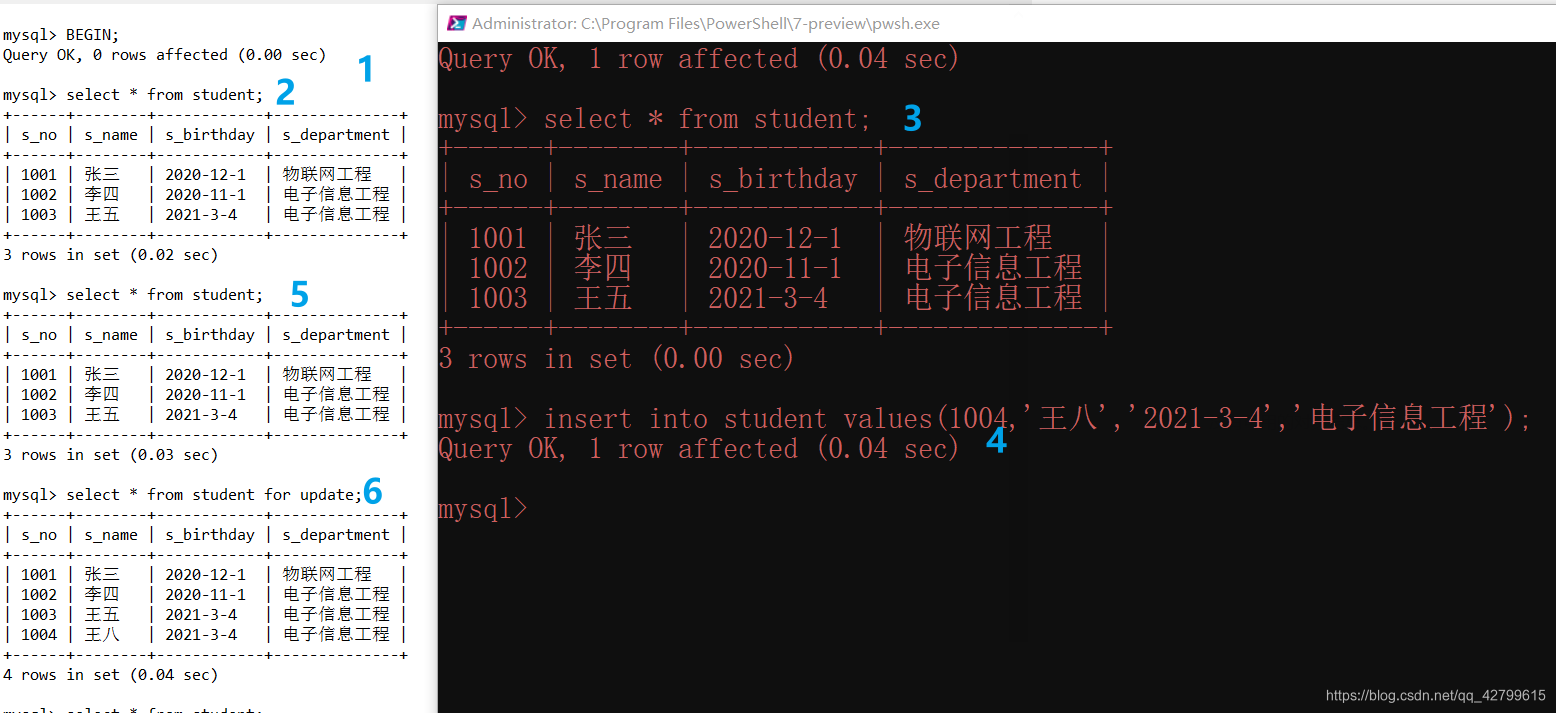

### 1、快照读和当前读

快照读就是普通的读操作,而当前读包括了 **加锁的读取** 和 **DML**(DML只是对表内部的数据操作,不涉及表的定义,结构的修改。主要包括insert、update、deletet) 操作。

当B事务修改了内容时,快照读不能获取修改的内容,相当于还是读取CPU中而不是内存中,而当前读则是直接读取内存中的最新的值,能够获取到B事务修改的内容。

当前读就是读取最新数据,而不是历史版本的数据。加锁的 SELECT,或者对数据进行增删改都会进行当前读。这有点像是 Java 中的 volatile 关键字,被 volatile 修饰的变量,进行修改时,JVM 会强制将其写回内存,而不是放在 CPU 缓存中,进行读取时,JVM 会强制从内存读取,而不是放在 CPU 缓存中。这样就能保证其可见行,保证每次读取到的都是最新的值。如果没有用 volatile 关键字修饰,变量的值可能会被放在 CPU 缓存中,这就导致读取到的值可能是某次修改的值,不能保证是最新的值。

### 2、幻读和不可重复读

**幻读 VS 不可重复读**

- 幻读重点在于数据是否存在。原本不存在的数据却真实的存在了,这便是幻读。在同一个事务中,第一次读取到结果集和第二次读取到的结果集不同。(对比上面的例子,当B事务INSERT以后,A事务中再进行插入,此次插入相当于一次隐式查询)。引起幻读的原因在于另一个事务进行了INSERT操作。

幻读是增加或删除了一些东西

- 不可重复读重点在于数据是否被改变了。在一个事务中对同一条记录进行查询,第一次读取到的数据和第二次读取到的数据不一致,这便是不可重复读。引起不可重复读的原因在于另一个事务进行了UPDATE或者是DELETE操作。

不可重复读是修改了已有的东西被读到了

**简单来说:幻读是说数据的条数发生了变化,原本不存在的数据存在了。不可重复读是说数据的内容发生了变化,原本存在的数据的内容发生了改变。**

==幻读的解决方法之一是加上间隙锁==

在一行行扫描的过程中,不仅将给行加上了行锁,还给行两边的空隙,也加上了间隙锁。MySQL将行锁 + 间隙锁组合统称为 next-key lock,通过 next-key lock 解决了幻读问题。

### 3、事务的隔离级别

1、READ UNCOMMITTED:读未提交,也叫未提交读,该隔离级别的事务可以看到其他事务中未提交的数据。该隔离级别因为可以读取到其他事务中未提交的数据,⽽未提交的数据可能会发⽣回滚, 因此我们把该级别读取到的数据称之为脏数据,把这个问题称之为脏读。

2、READ COMMITTED:读已提交,也叫提交读,该隔离级别的事务能读取到已经提交事务的数据, 因此它不会有脏读问题。但由于在事务的执⾏中可以读取到其他事务提交的结果,所以在不同时间 的相同 SQL 查询中,可能会得到不同的结果,这种现象叫做不可重复读。

3、REPEATABLE READ:可重复读,是 MySQL 的默认事务隔离级别,它能确保同⼀事务多次查询的结果⼀致。但也会有新的问题,⽐如此级别的事务正在执⾏时,另⼀个事务成功的插⼊了某条数据,但因为它每次查询的结果都是⼀样的,所以会导致查询不到这条数据,⾃⼰重复插⼊时⼜失败(因为唯⼀约束的原因)。明明在事务中查询不到这条信息,但⾃⼰就是插⼊不进去,这就叫幻读(Phantom Read)。

4、SERIALIZABLE:串行化(序列化),事务最⾼隔离级别,它会强制事务排序,使之不会发⽣冲突,从⽽解决 了脏读、不可重复读和幻读问题,但因为执⾏效率低,所以真正使⽤的场景并不多。

### 4、MVCC

==定义:==

MVCC是多版本并发控制 Multi-Version Concurrent Contrl。

它是MySQL中的提高性能的一种方式,配合Undo log 和版本链,替代锁,让不同事物的读-写、写-读操作可以并发的执行,从而提升系统的性能。

MVCC 在 MySQL InnoDB 中的实现主要是为了提高数据库并发性能。一般是在使用读已提交(PEAD COMMITTED)和可重复读(REPEATABLE READ)隔离级别的事务中实现。

用自己的话说就是:

多版本意思是指数据库中一条数据有多个版本同时存在,在某个事务对其进行具体操作的时候,是需要查看这一条记录的隐藏列事务版本的id,比对事务id并根据事物的隔离级别从而去判断是哪个版本的数据。

==准确的说,MVCC多版本并发控制指的是 “维持一个数据的多个版本,使得读写操作没有冲突” 这么一个概念。==

==MVCC的优点==

- MVCC在MySQL InnoDB中的实现主要是为了提高数据库的并发性能,用更好的方式去处理读-写或写-读之间的冲突,也能做到不加锁,非阻塞并发读,提高了数据库并发读写的性能。

- MVCC还可以解决脏读,幻读,不可重复读等事务隔离问题。但它还不能解决更新丢失的问题。

所以MVCC能够解决读-写之间的并发控制,但它不能解决写-写之间的的并发控制

==**基本原理**==

因为MVCC的目的就是控制并发控制的,在数据库中的实现,为了解决读写的冲突问题。

*它的实现原理主要依赖3个模块:隐藏字段、undo日志、Read View来实现的。*

==隐藏字段==

对于使用 InnoDB 存储引擎的表来说,它的聚簇索引记录中都包含两个必要的隐藏列。

● trx_id:每次对某条聚簇索引记录进行改动的时候,都会把对应的事务id赋值给trx_id进行记录的隐藏列。

● roll_pointer:在每次对某条聚簇索引记录进行改动的时候,都会把旧版本写入undo日志当中,然后这个隐藏列就相当于一个指针的作用,我们可以通过roll_pointer来找到该记录修改之前的信息。

==undo日志==

undo log主要分为两种:

insert undo log:

代表事务在insert新记录时产生的undo log,只在事务回滚时需要,并且在事务提交后就立即删除。

update undo log:

事务在进行update或delete时产生的undo log;不仅在事务回滚的时需要,在快照时也需要;所以不能随便删除,只有在快速读或事务回滚不涉及该日志时,对应的日志才会被purge线程统一清除。

==Read View(读视图)==

对于使用READ UNCOMMITTED(读未提交)隔离级别的事务来说,直接读取记录的最新版本就好了,对于使用SERIALIZABLE(串行化)隔离级别的事务来说,使用加锁的方式来访问记录。

所以在InnoDB引擎中设计了一个ReadView的概念。

Read View就是事务进行快照读操作的时候产生的读视图(Read View),在该事务执行的快照读的那一刻,会生成数据库系统当前的一个快照,记录并维护系统当前活跃事务的ID(当每个事务开启时,都会分配一个ID,这个ID是自增的,所以最新的事务,ID越大)。

在MySQL当中,READ COMMITTED和REPEATABLE READ 隔离级别的一个非常大的区别就是它们生成的Read View 的时机不同。

● READ COMMITTED:每次读取数据前都生成一个ReadView;

● REPEATABLE READ:在第一个读取数据时生成一个ReadView;

### 5、为什么MySQL使用B+树

==简洁版==

`先看原因:`

1.B+树减少了IO次数,效率更高

(这里这么理解:-----就是减少了磁盘的访问次数,毕竟内存速度要比磁盘快的多)

2.B+树查询跟稳定,因为所有数据放在叶子节点

3.B+树范围查询更好,因为叶子节点指向下一个叶子结点

==详细:==

```java

1、在B树的基础上每个节点存储的关键字数更多,树的层级更少所以查询数据更快。

2、所有关键字指针都存在叶⼦节点,所以每次查找的次数都相同所以查询速度更稳定。

3、除此之外,B+树的叶⼦节点是跟后序节点相连接的,这对范围查找是⾮常有⽤的。

看到没B+树的⾮叶⼦节点是主键,主键占⽤的空间越⼩,每个节点能放的主键就能更多,这就是为什么我们的主键 ⼀般不设置太⼤的原因。主键占⽤的空间⼩,能降低树⾼,减少IO次数

```

1、B+树非叶子节点上是不存储数据的,仅存储键值,而B树节点中不仅存储键值,也会存储数据。之所以这么做是因为在数据库中页的大小是固定的,innodb中页的默认大小是16KB。如果不存储数据,那么就会存储更多的键值,相应的树的阶数(节点的子节点树)就会更大,树就会更矮更胖,如此一来我们查找数据进行磁盘的IO次数有会再次减少,数据查询的效率也会更快。另外,B+树的阶数是等于键值的数量的,如果我们的B+树一个节点可以存储1000个键值,那么3层B+树可以存储1000×1000×1000=10亿个数据。一般根节点是常驻内存的,所以一般我们查找10亿数据,只需要2次磁盘IO。

2、因为B+树索引的所有数据均存储在叶子节点,而且数据是按照顺序排列的。那么B+树使得范围查找,排序查找,分组查找以及去重查找变得异常简单。而B树因为数据分散在各个节点,要实现这一点是很不容易的。

#### 5.1、为什么不用平衡二叉树?

> **为什么不用普通二叉树?**

普通二叉树存在退化的情况,如果它退化成链表,相当于全表扫描。平衡二叉树相比于二叉查找树来说,查找效率更稳定,总体的查找速度也更快。

> **为什么不用平衡二叉树呢?**

读取数据的时候,是从磁盘读到内存。如果树这种数据结构作为索引,那每查找一次数据就需要从磁盘中读取一个节点,也就是一个磁盘块,但是平衡二叉树可是每个节点只存储一个键值和数据的,如果是 B+ 树,可以存储更多的节点数据,树的高度也会降低,因此读取磁盘的次数就降下来啦,查询效率就快。

### 6、索引

MySQL的索引包括普通索引、唯一性索引、全文索引、单列索引和空间索引等。

从功能逻辑上说,索引主要有4类,分别是普通索引、唯一索引、主键索引、全文索引。

按照物理实现方式,索引可以分为2种:聚簇索引和非聚簇索引。

按照作用字段个数进行划分,分成单列索引和联合索引。

1. 普通索引(还有前缀索引)

在创建普通索引时,不附加任何限制条件,只是用于提高查询效率。这类索引可以创建在任何数据类型中,其值是否唯一和非空,要由字段本身的完整性约束条件决定。建立索引以后,可以通过索引进行查询。例如,在表 student 的字段 name 上建立一个普通索引,查询记录时就可以根据该索引进行查询。

2. 唯一性索引

使用 UNIQUE 参数可以设置索引为唯一性索引,在创建唯一性索引时,限制该索引的值必须是唯一的,但允许有空值。在一张数据表里可以有多个唯一索引。

例如,在表 student 的字段 email 中创建唯一性索引,那么字段 email 的值就必须是唯一的。通过唯一性索引,可以更快速地确定某条记录。

3. 主键索引

主键索引就是一种特殊的唯一性索引,在唯一索引的基础上增加了不为空的约束,也就是 NOT NULL + UNIQUE,一张表里最多只有一个主键索引。

Why?这是由主键索引的物理实现方式决定的,因为数据存储在文件中只能按照一种顺序进行存储。

4. 单列索引

在表的单个字段上创建索引。单列索引只根据该字段进行索引。单列索引可以是普通索引,也可以是唯一性索引,还可以是全文索引。只要保证该索引只对应一个字段即可。一个表可以有多个单列索引。

5. 多列(组合、联合)索引

多列索引是在表的多个字段组合上创建一个索引。该索引指向创建时对应的多个字段,可以通过这几个字段进行查询,但是只有查询条件中使用了这些字段的第一个字段时才会被使用。例如,在表的字段 id、name 和 gender 上建立一个多列索引 idx_id_name_gender ,只有在查询条件中使用了字段 id 时该索引才会被使用。使用组合索引时遵循最左前缀集合。

6. 全文索引

全文索引(也称全文检索)是目前搜索引擎使用的一种关键技术。它能够利用【分词技术】等多种算法智能分析出文本文字中关键词的频率和重要性,然后按照一定的算法规则智能地筛选出我们想要的搜索结果。全文索引非常适合大型数据集,对于小的数据集,它的用处比较小。

使用参数 FULLTEXT 可以设置索引为全文索引。在定义索引的列上支持值的全文查找,允许在这些索引列中插入重复值和空值。全文索引只能创建在 CHAR、VARCHAR 或 TEXT 类型及其系列类型的字段上,查询数据量较大的字符串类型的字段时,使用全文索引可以提高查询速度。例如,表 student 的字段 infomation 是 TEXT 类型,该字段包含了很多文字信息。在字段 information 上建立全文索引后,可以提高查询字段 information 的速度。

全文索引典型的有两种类型:自然语言的全文索引和布尔全文索引。

自然语言搜索引擎将计算每一个文档对象和查询的相关度。这里,相关度是基于匹配的关键词的个数,以及关键词在文档中出现的次数。在整个索引中出现次数越少的词语,匹配时的相关度就越高。相反,非常常见的单词将不会被搜索,如果一个词语在超过50%的记录中都出现了,那么自然语言的搜索将不会搜索这类词语。

随着大数据时代的到来,关系型数据库应对全文索引的需求已力不从心,逐渐被 solr、ElasticSearch 等专门的搜索引擎所替代。

7、空间索引

#### 6.1、什么时候需要 / 不需要创建索引?

索引最大的好处是提高查询速度,但是索引也是有缺点的,比如:

- 需要占用物理空间,数量越大,占用空间越大;

- 创建索引和维护索引要耗费时间,这种时间随着数据量的增加而增大;

- 会降低表的增删改的效率,因为每次增删改索引,B+ 树为了维护索引有序性,都需要进行动态维护。

所以,索引不是万能钥匙,它也是根据场景来使用的。

[#](https://www.xiaolincoding.com/mysql/index/index_interview.html#什么时候适用索引)什么时候适用索引?

- 字段有唯一性限制的,比如商品编码;

- 经常用于 `WHERE` 查询条件的字段,这样能够提高整个表的查询速度,如果查询条件不是一个字段,可以建立联合索引。

- 经常用于 `GROUP BY` 和 `ORDER BY` 的字段,这样在查询的时候就不需要再去做一次排序了,因为我们都已经知道了建立索引之后在 B+Tree 中的记录都是排序好的。

[#](https://www.xiaolincoding.com/mysql/index/index_interview.html#什么时候不需要创建索引)什么时候不需要创建索引?

- `WHERE` 条件,`GROUP BY`,`ORDER BY` 里用不到的字段,索引的价值是快速定位,如果起不到定位的字段通常是不需要创建索引的,因为索引是会占用物理空间的。

- 字段中存在大量重复数据,不需要创建索引,比如性别字段,只有男女,如果数据库表中,男女的记录分布均匀,那么无论搜索哪个值都可能得到一半的数据。在这些情况下,还不如不要索引,因为 MySQL 还有一个查询优化器,查询优化器发现某个值出现在表的数据行中的百分比很高的时候,它一般会忽略索引,进行全表扫描。

- 表数据太少的时候,不需要创建索引;

- 经常更新的字段不用创建索引,比如不要对电商项目的用户余额建立索引,因为索引字段频繁修改,由于要维护 B+Tree的有序性,那么就需要频繁的重建索引,这个过程是会影响数据库性能的。

#### 6.2、索引失效的情况

- 查询条件包含 or,可能导致索引失效

- 如果字段类型是字符串,where 时一定用引号括起来,否则会因为隐式类型转换,索引失效

- like 通配符可能导致索引失效。

- 联合索引,查询时的条件列不是联合索引中的第一个列,索引失效。

- 在索引列上使用 mysql 的内置函数,索引失效。

- 对索引列运算(如,+、-、*、/),索引失效。

- 索引字段上使用(!= 或者 < >,not in)时,可能会导致索引失效。

- 索引字段上使用 is null, is not null,可能导致索引失效。

- 左连接查询或者右连接查询查询关联的字段编码格式不一样,可能导致索引失效。

- MySQL 优化器估计使用全表扫描要比使用索引快,则不使用索引。

### 7、AUTO-INC锁

==**在插入数据时,会加一个表级别的 AUTO-INC 锁**==

- 当 innodb_autoinc_lock_mode = 0,就采用 AUTO-INC 锁,语句执行结束后才释放锁;

- 当 innodb_autoinc_lock_mode = 2,就采用轻量级锁,申请自增主键后就释放锁,并不需要等语句执行后才释放。

- 当 innodb_autoinc_lock_mode = 1:

- 普通 insert 语句,自增锁在申请之后就马上释放;

- 类似 insert … select 这样的批量插入数据的语句,自增锁还是要等语句结束后才被释放;

当 innodb_autoinc_lock_mode = 2 是性能最高的方式,但是当搭配 binlog 的日志格式是 statement 一起使用的时候,在「主从复制的场景」中会发生**数据不一致的问题**。

如果 innodb_autoinc_lock_mode = 2,意味着「==申请自增主键后就释放锁,不必等插入语句执行完==」。那么就可能出现这样的情况:

- session B 先插入了两个记录,(1,1,1)、(2,2,2);

- 然后,session A 来申请自增 id 得到 id=3,插入了(3,5,5);

- 之后,session B 继续执行,插入两条记录 (4,3,3)、 (5,4,4)。

可以看到,**session B 的 insert 语句,生成的 id 不连续**。

当「主库」发生了这种情况,binlog 面对 t2 表的更新只会记录这两个 session 的 insert 语句,如果 binlog_format=statement,记录的语句就是原始语句。记录的顺序要么先记 session A 的 insert 语句,要么先记 session B 的 insert 语句。

但不论是哪一种,这个 binlog 拿去「从库」执行,这时从库是按「顺序」执行语句的,只有当执行完一条 SQL 语句后,才会执行下一条 SQL。因此,在**从库上「不会」发生像主库那样两个 session 「同时」执行向表 t2 中插入数据的场景。所以,在备库上执行了 session B 的 insert 语句,生成的结果里面,id 都是连续的。这时,主从库就发生了数据不一致**。

要解决这问题,binlog 日志格式要设置为 row,这样在 binlog 里面记录的是主库分配的自增值,到备库执行的时候,主库的自增值是什么,从库的自增值就是什么。

==所以,**当 innodb_autoinc_lock_mode = 2 时,并且 binlog_format = row,既能提升并发性,又不会出现数据一致性问题**。==

### 8、锁相关

#### 8.1 幻读解决以及死锁问题

**Innodb 引擎为了解决「可重复读」隔离级别下的幻读问题,就引出了 next-key 锁**,它是记录锁和间隙锁的组合。

- Record Lock,记录锁,锁的是记录本身;

- Gap Lock,间隙锁,锁的就是两个值之间的空隙,以防止其他事务在这个空隙间插入新的数据,从而避免幻读现象。

普通的 select 语句是不会对记录加锁的,因为它是通过 MVCC 的机制实现的快照读,如果要在查询时对记录加行锁,可以使用下面这两个方式:

```sql

begin;

//对读取的记录加共享锁

select ... lock in share mode;

commit; //锁释放

begin;

//对读取的记录加排他锁

select ... for update;

commit; //锁释放

```

死锁原因:两个事务都持有相同的间隙锁,**而插入意向锁与间隙锁是冲突的,所以当其它事务持有该间隙的间隙锁时,需要等待其它事务释放间隙锁之后,才能获取到插入意向锁**,而只有等待对方的间隙锁释放后才能执行接下来的步骤,导致互等,死锁。

临键锁就是记录锁(Record Locks)和间隙锁(Gap Locks)的结合,即除了锁住记录本身,还要再锁住索引之间的间隙。当我们使用范围查询,并且命中了部分`record`记录,此时锁住的就是临键区间。注意,临键锁锁住的区间会包含最后一个 record 的右边的临键区间。例如`select * from t where id > 5 and id <= 7 for update;`会锁住(4,7]、(7,+∞)。mysql 默认行锁类型就是`临键锁(Next-Key Locks)`。当使用唯一性索引,等值查询匹配到一条记录的时候,临键锁(Next-Key Locks)会退化成记录锁;没有匹配到任何记录的时候,退化成间隙锁。

> `间隙锁(Gap Locks)`和`临键锁(Next-Key Locks)`都是用来解决幻读问题的,在`已提交读(READ COMMITTED)`隔离级别下,`间隙锁(Gap Locks)`和`临键锁(Next-Key Locks)`都会失效!

#### 8.2、什么时候使用表锁和行锁

1. 对于表级锁而言,当执行 DDL 语句去修改表结构时,会使用表级锁。

> 其他:主键自增的情况下插入数据会使用**AUTO-INC 锁**(表锁),AUTO-INC 锁是特殊的表锁机制,锁**不是再一个事务提交后才释放,而是再执行完插入语句后就会立即释放**。

2. 对于行级锁而言,一般情况下都会默认使用行级锁,貌似是需要有索引匹配到才行。

#### 8.3、意向锁的作用

意向锁是表级锁,某一行加锁时需要先加意向锁,假如没有意向锁,那么我们就得遍历表中所有数据行来判断有没有行锁;有了意向锁这个表级锁之后,则我们直接判断一次就知道表中是否有数据行被锁定了。

### 9、索引下推

**图一:不使用ICP技术(过程使用数字符号标示,如①②③等)**

**图二:使用ICP技术(过程使用数字符号标示,如①②③等)**

理解:相当于原本是回表查出所有的数据后再进行筛选,使用索引下推后变为回表前就先使用where对联合索引中的其他字段进行筛选,回表后再进行第二次筛选,这样减少了回表的次数。

### 10、分库分表

==分库==

**垂直分库** 就是把单一数据库按照业务进行划分,不同的业务使用不同的数据库,进而将一个数据库的压力分担到多个数据库。

**水平分库** 是把同一个表按一定规则拆分到不同的数据库中,每个库可以位于不同的服务器上,这样就实现了水平扩展,解决了单表的存储和性能瓶颈的问题。

垂直分库分担数据库压力,水平分库增加存储空间

==分表==

**分表** 就是对单表的数据进行拆分,可以是垂直拆分,也可以是水平拆分。

**垂直分表** 是对数据表列的拆分,把一张列比较多的表拆分为多张表。

举个例子:我们可以将用户信息表中的一些列单独抽出来作为一个表。

**水平分表** 是对数据表行的拆分,把一张行比较多的表拆分为多张表,可以解决单一表数据量过大的问题。

举个例子:我们可以将用户信息表拆分成多个用户信息表,这样就可以避免单一表数据量过大对性能造成影响。

水平拆分只能解决单表数据量大的问题,为了提升性能,我们通常会选择将拆分后的多张表放在不同的数据库中。也就是说,水平分表通常和水平分库同时出现。

#### 10.1、什么情况下需要分库分表?

遇到下面几种场景可以考虑分库分表:

- 单表的数据达到千万级别以上,数据库读写速度比较缓慢。

- 数据库中的数据占用的空间越来越大,备份时间越来越长。

- 应用的并发量太大。

#### 10.2、常见的分片算法有哪些?

分片算法主要解决了数据被水平分片之后,数据究竟该存放在哪个表的问题。

- **哈希分片**:求指定 key(比如 id) 的哈希,然后根据哈希值确定数据应被放置在哪个表中。哈希分片比较适合随机读写的场景,不太适合经常需要范围查询的场景。

- **范围分片**:按照特性的范围区间(比如时间区间、ID 区间)来分配数据,比如 将 `id` 为 `1~299999` 的记录分到第一个库, `300000~599999` 的分到第二个库。范围分片适合需要经常进行范围查找的场景,不太适合随机读写的场景(数据未被分散,容易出现热点数据的问题)。

- **地理位置分片**:很多 NewSQL 数据库都支持地理位置分片算法,也就是根据地理位置(如城市、地域)来分配数据。

- **融合算法**:灵活组合多种分片算法,比如将哈希分片和范围分片组合。

#### 10.3 、分库分表存在的问题

1、原本的事务不能保证原子性,需要使用分布式事务(2PC两阶段提交、3PC、TCC、可靠消息最终一致性)

2、跨库无法使用JOIN,只能通过`业务代码关联`、`增添冗余字段`、`数据异构通过ES查询`的方式解决

3、聚合函数等只能通过业务逻辑或者中间件实现而不能使用order by

4、主键ID问题,需要使用分布式ID(UUID、雪花算法、redisID、zookeeper生成唯一ID)

5、需要考虑数据库容量、迁移、扩容的问题

#### 10.4、总结

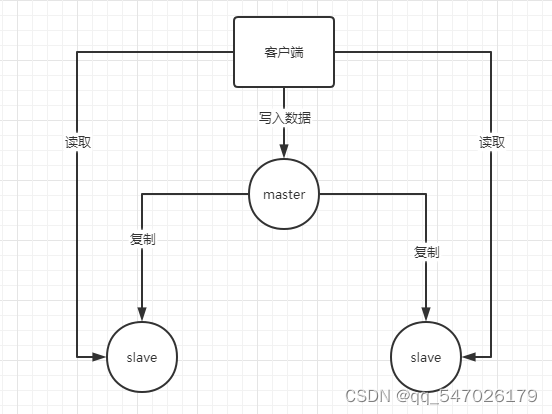

- 读写分离主要是为了将对数据库的读写操作分散到不同的数据库节点上。 这样的话,就能够小幅提升写性能,大幅提升读性能。

- 读写分离基于主从复制,MySQL 主从复制是依赖于 binlog 。

- **分库** 就是将数据库中的数据分散到不同的数据库上。**分表** 就是对单表的数据进行拆分,可以是垂直拆分,也可以是水平拆分。

- 引入分库分表之后,需要系统解决事务、分布式 id、无法 join 操作问题。

- ShardingSphere 绝对可以说是当前分库分表的首选!ShardingSphere 的功能完善,除了支持读写分离和分库分表,还提供分布式事务、数据库治理等功能。另外,ShardingSphere 的生态体系完善,社区活跃,文档完善,更新和发布比较频繁。

### 11、并发操作数据库需要注意什么

在并发操作数据库时,有一些重要的注意事项需要考虑,以确保数据的一致性、完整性和可靠性。以下是一些需要注意的方面:

1. **事务处理**:使用数据库事务来维护数据的一致性和完整性。事务是一组操作,要么全部成功执行,要么全部回滚。这可以防止在并发情况下数据损坏或不一致。

2. **锁机制**:数据库通常提供了锁机制来管理并发访问。锁可以分为共享锁(读取操作)和排他锁(写入操作)。合理地使用锁可以避免多个并发事务同时修改同一数据造成的问题,如死锁、锁竞争等。

3. **并发控制**:数据库管理系统通常具有并发控制机制,如多版本并发控制(MVCC),用于处理同时读取和写入操作。这可以防止读取脏数据(未提交的数据)和写入丢失等问题。

4. **隔离级别**:数据库提供了不同的隔离级别,用于控制并发事务之间的可见性和影响范围。常见的隔离级别包括读未提交、读提交、可重复读和串行化。选择适当的隔离级别可以平衡一致性和性能。

5. **死锁处理**:死锁是多个事务相互等待对方释放资源而无法继续执行的情况。数据库管理系统应该具备死锁检测和解除机制,以避免持续的死锁问题。

6. **并发测试**:在开发和测试阶段,需要进行并发测试,模拟多个用户同时访问数据库并执行操作。这有助于发现潜在的并发问题和性能瓶颈。

7. **连接池管理**:使用连接池来管理数据库连接,以避免频繁地打开和关闭连接,从而提高性能并减少资源消耗。

8. **优化查询**:并发操作时,数据库查询可能会成为性能瓶颈。确保你的查询经过优化,使用合适的索引和查询语句,以减少查询时间和资源消耗。

9. **错误处理和回滚**:在并发操作中,可能会发生错误。正确处理错误,并在必要时回滚事务,可以保护数据的完整性和一致性。

10. **监控和调优**:定期监控数据库的性能指标,如响应时间、并发连接数等。根据监控结果进行调优,以保持数据库的高性能和稳定性。

总之,处理并发操作数据库需要综合考虑事务管理、锁机制、并发控制、隔离级别、死锁处理等多个方面,以确保数据的可靠性和一致性。

### 12、日志相关

- **undo log(回滚日志)**:是 Innodb 存储引擎层生成的日志,实现了事务中的**原子性**,主要**用于事务回滚和 MVCC**。

- **redo log(重做日志)**:是 Innodb 存储引擎层生成的日志,实现了事务中的**持久性**,主要**用于掉电等故障恢复**;

- **binlog (归档日志)**:是 Server 层生成的日志,主要**用于数据备份和主从复制**;

### 13、为什么Redis Zset使用跳表?

1、**简单实现**

2、**更好的内存效率**,每个节点只需要记录下一层节点的指针,跳表在内存中的存储布局相对紧凑,不需要像平衡树那样维护大量的指针和额外的数据结构,因此可以在相对较少的内存中存储大量元素。

3、**高效的插入和删除操作**,跳表允许在平均情况下以O(log n)的时间复杂度执行插入、删除和查找操作。这对于有序集合来说是非常重要的,因为有序集合需要保持元素的有序性,并且需要高效地进行元素的插入和删除。

4、**可读性和维护性:** 跳表的实现相对直观,容易理解和调试。这对于Redis的开发团队和其他开发人员来说都是有益的。

缺点:

1、分层结构,当层数过高时相对于红黑树,空间消耗增加。

2、跳表并没有一个现成的实现,所以在开发中,如果你想使用跳表,必须要自己实现。

原因:**分层结构:** 跳表的核心思想是分层结构,每个层级都有一定数量的节点。这些层级在内存中占用了一定的空间。==红黑树虽然也有层级结构,但是它的高度相对较低==,而且不需要为每个节点都维护多个层级,因此在某些情况下可以在整体高度上占用更少的空间。

### 14、SQL优化

尽量避免使用子查询

用IN来替换OR

读取适当的记录LIMIT M,N,而不要读多余的记录

禁止不必要的Order By排序

总和查询可以禁止排重用union all

避免随机取记录

将多次插入换成批量Insert插入

只返回必要的列,用具体的字段列表代替 select * 语句

区分in和exists

优化Group By语句

尽量使用数字型字段

优化Join语句

#### 14.1、分页查询优化

分页优化

在数据量比较大,分页比较深的情况下,需要考虑分页的优化。

例如:

```text

select * from table where type = 2 and level = 9 order by id asc limit 190289,10;

```

优化方案:

- **延迟关联**

**操作:**查询条件放到子查询中,子查询只查主键ID,然后使用子查询中确定的主键关联查询其他的属性字段;

例如:

```text

select a.* from table a,

(select id from table where type = 2 and level = 9 order by id asc limit 190289,10 ) b

where a.id = b.id

```

说明: MySQL并不是挑过offeset行,而是取offset+N行,然后返回放弃前offset行,返回N行,那当offset特别大的时候,效率就非常的底下,要么控制返回的总页数,要么对超过特定阈值的页数进行SQL改写。

==理解:原本的SQL需要走一次二级索引通过最左前缀找到id后回表,回表后需要对所有行进行排序以及筛选(2次),而延迟关联优化先通过子查询获取主键id,再进行内连接(2次),第二种只需要在子查询中对id进行排序,这样可以减少查询的数据量,不需要对行进行排序,因此快很多==

一句话:第一种需要检索行,第二种只要检索id

**方案二:**

select * from user limit 10000,100;

select * from user where id>= (select id from user limit 10000,1) limit 100;

先定位筛选出起始点,再读取后面的100条信息

详细解释:

1、https://zhuanlan.zhihu.com/p/626142956?utm_id=0

2、https://blog.csdn.net/HongZeng_CSDN/article/details/130045243

### 15、事务ACID

**原子性**(`Atomicity`):事务是最小的执行单位,不允许分割。事务的原子性确保动作要么全部完成,要么完全不起作用;

**一致性**(`Consistency`):执行事务前后,数据保持一致,例如转账业务中,无论事务是否成功,转账者和收款人的总额应该是不变的;

**隔离性**(`Isolation`):并发访问数据库时,一个用户的事务不被其他事务所干扰,各并发事务之间数据库是独立的;

**持久性**(`Durability`):一个事务被提交之后。它对数据库中数据的改变是持久的,即使数据库发生故障也不应该对其有任何影响。

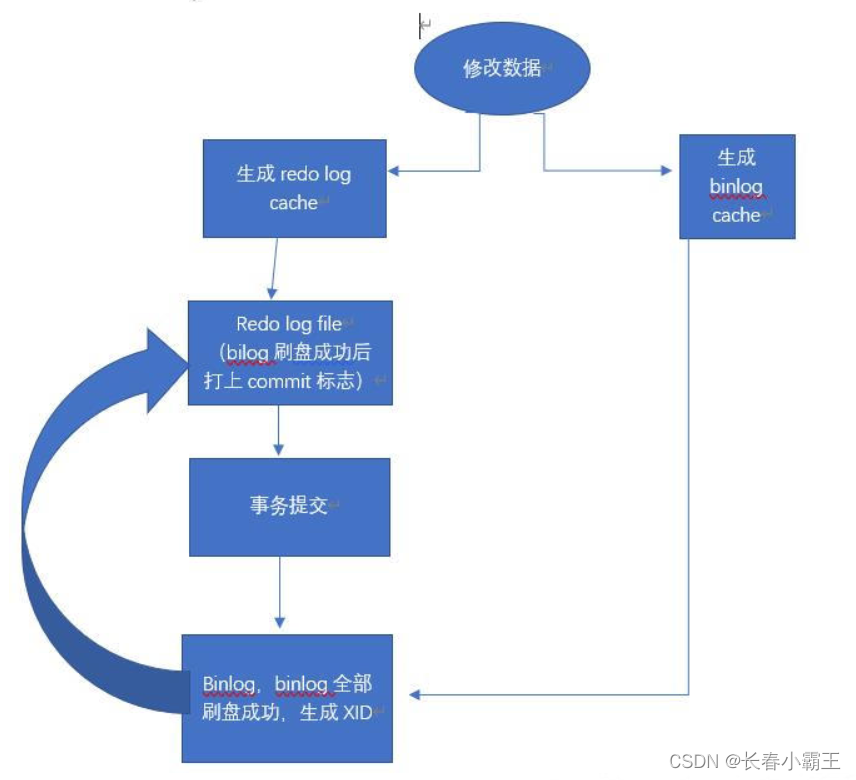

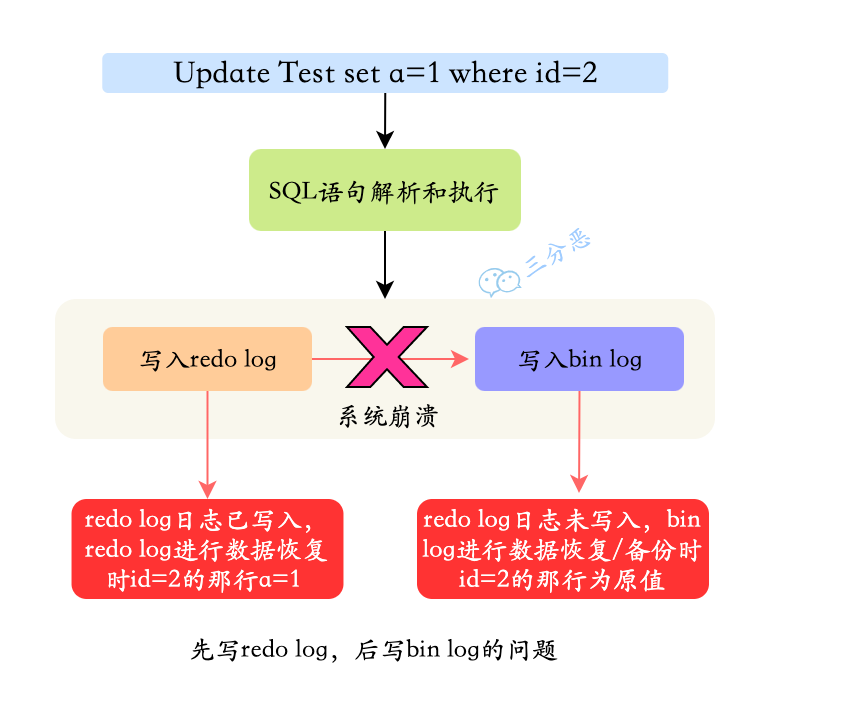

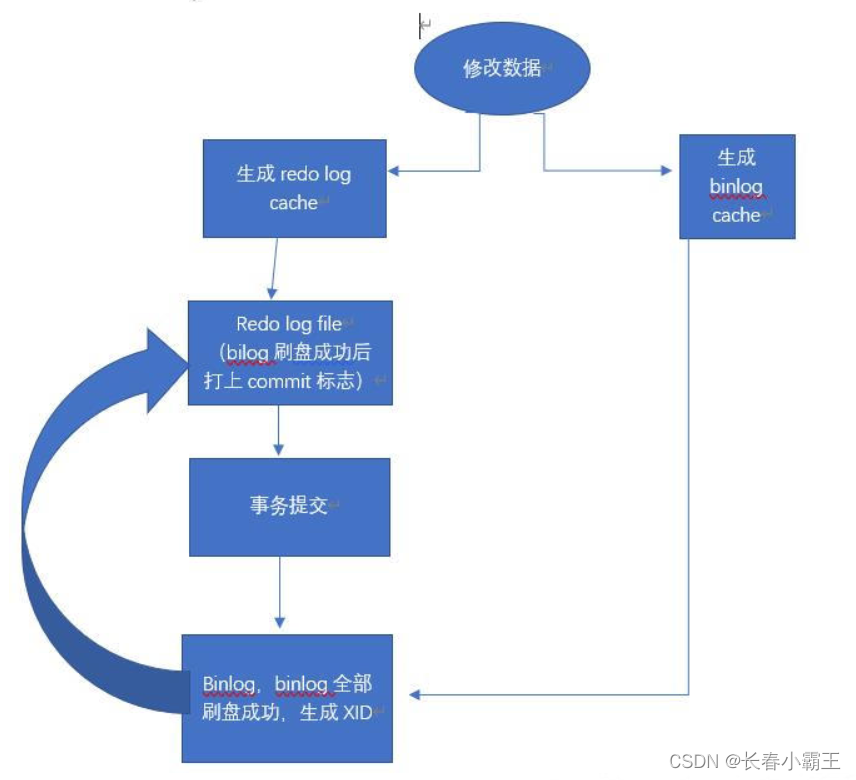

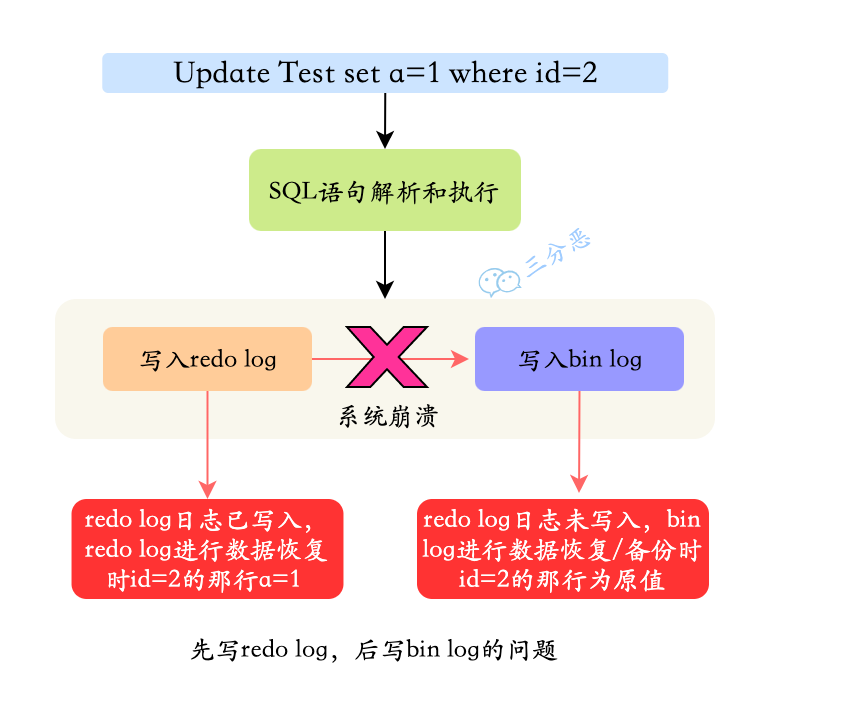

### 16、两阶段提交

**什么是两阶段提交**

当有数据修改时,会先将修改redo log cache和binlog cache然后在刷入到磁盘形成redo log file,当redo log file全都刷入到磁盘时(prepare 状态)和提交成功后才能将binlog cache刷入磁盘,当binlog全部刷新到磁盘后会记录一个xid,然后在relo log file上打上commit标志(commit阶段)。

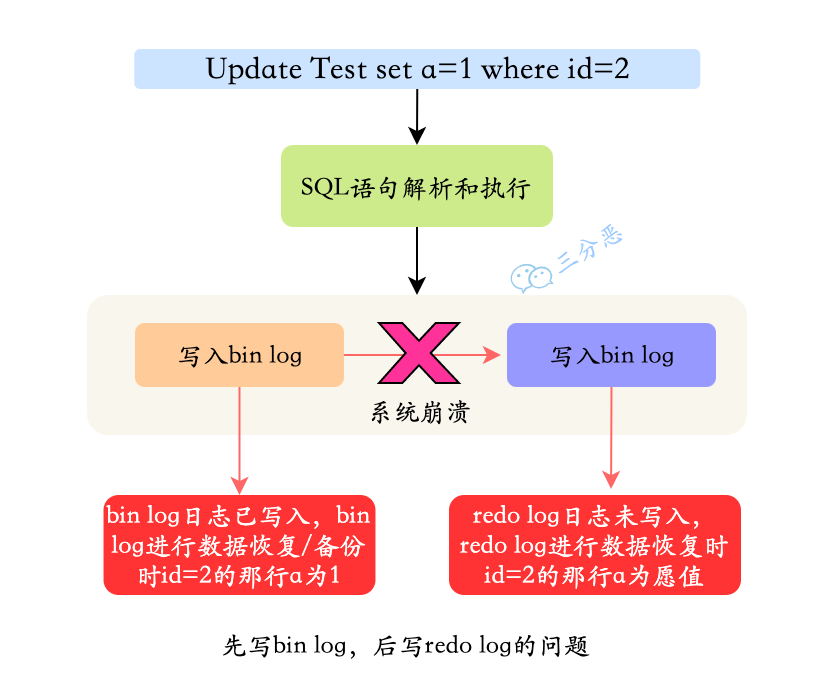

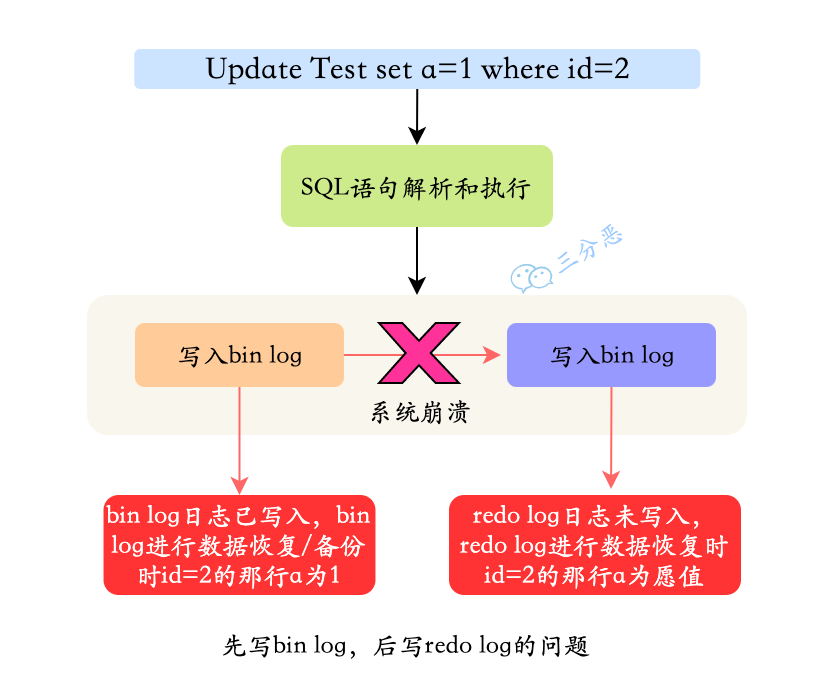

为什么要两阶段提交呢?直接提交不行吗?

我们可以假设不采用两阶段提交的方式,而是采用“单阶段”进行提交,即要么先写入 redo log,后写入 binlog;要么先写入 binlog,后写入 redo log。这两种方式的提交都会导致原先数据库的状态和被恢复后的数据库的状态不一致

**先写入 redo log,后写入 binlog:**

在写完 redo log 之后,数据此时具有`crash-safe`能力,因此系统崩溃,数据会恢复成事务开始之前的状态。但是,若在 redo log 写完时候,binlog 写入之前,系统发生了宕机。此时 binlog 没有对上面的更新语句进行保存,导致当使用 binlog 进行数据库的备份或者恢复时,就少了上述的更新语句。从而使得`id=2`这一行的数据没有被更新。

**先写入 binlog,后写入 redo log:**

写完 binlog 之后,所有的语句都被保存,所以通过 binlog 复制或恢复出来的数据库中 id=2 这一行的数据会被更新为 a=1。但是如果在 redo log 写入之前,系统崩溃,那么 redo log 中记录的这个事务会无效,导致实际数据库中`id=2`这一行的数据并没有更新。

## 七、数据库sql题目

### 1、查找每个班级分数最高的前三名

答案:

```sql

select class, name,score

FROM test_score a

WHERE (

SELECT COUNT(score) from test_score b WHERE b.class=a.class AND a.score60)

```

### 3、查询学过课程ID为‘301’和‘302’的学生的学号、姓名

```sql

select student.student_id,student.student_name

from student

where student.student_id IN(

select a.student_id

from (select student_id from score where course_id=301) as a