Showing preview only (5,375K chars total). Download the full file or copy to clipboard to get everything.

Repository: kakao/recoteam

Branch: master

Commit: 65fc78e25cd1

Files: 119

Total size: 5.0 MB

Directory structure:

gitextract_mz78veiu/

├── README.md

├── docs/

│ └── arena/

│ ├── brunch.html

│ ├── common.css

│ ├── index.html

│ ├── melon-en.html

│ └── melon.html

├── onboarding/

│ └── README.md

├── paper_review/

│ ├── README.md

│ ├── recsys/

│ │ └── recsys2021/

│ │ ├── "Serving Each User"- Supporting Different Eating Goals Through a Multi-List Recommender Interface.md

│ │ ├── Accordion- a Trainable Simulator for Long-Term Interactive Systems.md

│ │ ├── Burst-induced Multi-Armed Bandit for Learning Recommendation.md

│ │ ├── Cold Start Similar Artists Ranking with Gravity-Inspired Graph Autoencoders.md

│ │ ├── Debiased Explainable Pairwise Ranking from Implicit Feedback.md

│ │ ├── Evaluating Off-Policy Evaluation- Sensitivity and Robustness.md

│ │ ├── Follow the guides- disentangling human and algorithmic curation in online music consumption.md

│ │ ├── I want to break free! Recommending friends from outside the echo chamber.md

│ │ ├── Local Factor Models for Large-Scale Inductive Recommendation.md

│ │ ├── Matrix Factorization for Collaborative Filtering Is Just Solving an Adjoint Latent Dirichlet Allocation Model After All.md

│ │ ├── Mitigating Confounding Bias in Recommendation via Information Bottleneck.md

│ │ ├── Negative Interactions for Improved Collaborative Filtering- Don’t go Deeper, go Higher.md

│ │ ├── Next-item Recommendations in Short Sessions.md

│ │ ├── ProtoCF- Prototypical Collaborative Filtering for Few-shot Item Recommendation.md

│ │ ├── RecSys2021.md

│ │ ├── Reverse Maximum Inner Product Search- How to efficiently find users who would like to buy my item?.md

│ │ ├── Semi-Supervised Visual Representation Learning for Fashion Compatibility.md

│ │ ├── Shared Neural Item Representation for Completely Cold Start Problem.md

│ │ ├── Sparse Feature Factorization for Recommender Systems with Knowledge Graphs.md

│ │ ├── The role of preference consistency, defaults and musical expertise in users’ exploration behavior in a genre exploration recommender.md

│ │ ├── Together is Better- Hybrid Recommendations Combining Graph Embeddings and Contextualized Word Representations.md

│ │ ├── Top-K Contextual Bandits with Equity of Exposure.md

│ │ ├── Toward Unified Metrics for Accuracy and Diversity for Recommender Systems.md

│ │ ├── Towards Source-Aligned Variational Models for Cross-Domain Recommendation.md

│ │ ├── Transformers4Rec- Bridging the Gap between NLP and Sequential & Session-Based Recommendation.md

│ │ └── Values of Exploration in Recommender Systems.md

│ └── topics/

│ ├── Algorithmic Advances.md

│ ├── Applications-Driven Advances.md

│ ├── Bandits and Reinforcement Learning.md

│ ├── Echo Chambers and Filter Bubbles.md

│ ├── Interactive Recommendation.md

│ ├── Language and Knowledge.md

│ ├── Metrics and Evaluation.md

│ ├── Practical Issues.md

│ ├── Privacy, Fairness, Bias.md

│ ├── Real-World Concerns.md

│ ├── Scalable Performance.md

│ ├── Theory and Practice.md

│ └── Users in Focus.md

├── presentations/

│ └── README.md

├── programming_assignments/

│ ├── beale_ciphers/

│ │ ├── README.md

│ │ ├── interview.md

│ │ ├── solution/

│ │ │ ├── solve.cpp

│ │ │ ├── solve.java

│ │ │ └── solve.py

│ │ └── testcase/

│ │ ├── README.md

│ │ ├── large/

│ │ │ ├── test1.in

│ │ │ ├── test1.out

│ │ │ ├── test3.in

│ │ │ ├── test3.out

│ │ │ ├── test5.in

│ │ │ ├── test5.out

│ │ │ ├── test7.in

│ │ │ ├── test7.out

│ │ │ ├── test9.in

│ │ │ └── test9.out

│ │ └── small/

│ │ ├── sample.in

│ │ ├── sample.out

│ │ ├── test0.in

│ │ ├── test0.out

│ │ ├── test10.in

│ │ ├── test10.out

│ │ ├── test11.in

│ │ ├── test11.out

│ │ ├── test12.in

│ │ ├── test12.out

│ │ ├── test13.in

│ │ ├── test13.out

│ │ ├── test14.in

│ │ ├── test14.out

│ │ ├── test2.in

│ │ ├── test2.out

│ │ ├── test4.in

│ │ ├── test4.out

│ │ ├── test6.in

│ │ ├── test6.out

│ │ ├── test8.in

│ │ └── test8.out

│ ├── jukebox/

│ │ ├── .gitignore

│ │ ├── README.md

│ │ ├── listen_count.txt

│ │ └── solution/

│ │ ├── 1. 데이터 전처리.ipynb

│ │ ├── 2-1. Shallow AutoEncoder.ipynb

│ │ ├── 2-2. EASE^R.ipynb

│ │ ├── 3. (optional) Implicit을 이용한 Jukebox 풀이.ipynb

│ │ ├── README.md

│ │ └── code_using_ease/

│ │ ├── evaluate.py

│ │ ├── evaluation/

│ │ │ ├── Evaluate.py

│ │ │ ├── user_id.txt

│ │ │ └── validation_data.txt

│ │ ├── recommend_with_ease.py

│ │ └── recommend_with_sgd.py

│ └── mini_reco/

│ ├── README.md

│ ├── evaluation.py

│ ├── interview.md

│ ├── solution/

│ │ └── solution.py

│ └── testcase/

│ ├── input/

│ │ ├── input000.txt

│ │ ├── input001.txt

│ │ ├── input002.txt

│ │ ├── input003.txt

│ │ ├── input004.txt

│ │ ├── input005.txt

│ │ └── input006.txt

│ └── output/

│ ├── output000.txt

│ ├── output001.txt

│ ├── output002.txt

│ ├── output003.txt

│ ├── output004.txt

│ ├── output005.txt

│ └── output006.txt

└── publications/

└── sigir2023-update-period/

└── README.md

================================================

FILE CONTENTS

================================================

================================================

FILE: README.md

================================================

# 카카오 추천팀

## 소개

카카오 추천팀은 카카오의 다양한 서비스에 추천 기술을 제공하고 있습니다.

추천팀에서는 아래와 같은 업무를 하고 있습니다.

- 추천 기술 고도화 (방향: 사용자의 장기적인 서비스 만족도 증가)

- 추천/ML SaaS 플랫폼 개발 (방향: 높은 품질의 추천 기술을 쉽게 가져다 사용할 수 있는 플랫폼)

- 대규모 추천 서비스를 지탱할 수 있는 안정적이고 효율적인 플랫폼 구축

저희에게 궁금한 점이나 하고 싶은 이야기가 있다면 [Discussions](https://github.com/kakao/recoteam/discussions)를 이용해주세요.

## 영입 지원 링크

(현재는 진행 중인 영입 공고가 없습니다.)

## 영입 기출 문제

추천팀 영입 과정에서 실제로 사용했던 기출 문제입니다.

- [Mini Reco](programming_assignments/mini_reco)

- [Jukebox](programming_assignments/jukebox)

- [Beale Ciphers](programming_assignments/beale_ciphers)

## 오픈소스

추천팀에서 공개한 오픈소스 소프트웨어입니다.

- [TOROS Buffalo](https://github.com/kakao/buffalo) - A fast and scalable production-ready open source project for recommender systems

- [TOROS N2](https://github.com/kakao/n2) - lightweight approximate Nearest Neighbor library which runs fast even with large datasets

- [python-ssdb](https://github.com/kakao/python-ssdb) - Python client for [SSDB](https://github.com/ideawu/ssdb)

## 지식 저장소 (논문 리뷰)

추천 관련 학회의 논문들을 읽고 정리한 것을 공개/공유하는 저장소입니다.

- [카카오 추천팀 지식 저장소](paper_review/README.md)

## 발행 문서, 발표 영상 자료 모음

공개적으로 발행한 문서나, 발표 영상을 아래에 모아놓았습니다.

### 테크 블로그 / AI 리포트

#### 추천팀 소개

- `2022-06-17` [‘AI 추천 기술’을 선도하는 카카오 추천팀을 소개합니다.](https://tech.kakao.com/2022/06/16/data-recommendation-system/)

- `2021-11-02` [charlie의 추천팀 인턴 생활기](https://tech.kakao.com/2021/11/02/charlie-internship/)

- `2021-03-11` [카카오 AI 추천을 소개합니다.](https://tech.kakao.com/2021/03/11/kakao-ai/)

- `2020-06-23` [데이터를 기반으로 새로운 경험을 선사하는 추천팀 이야기](https://tech.kakao.com/2020/06/23/recruit-algorithm-ml/)

#### 추천 시스템

- `2023-03-02` [파이썬과 러스트](https://tech.kakao.com/2023/03/02/python-and-rust/)

- `2022-12-12` [추천팀의 DDD 도입기](https://tech.kakao.com/2022/12/12/ddd-of-recommender-team/)

- `2021-12-27` [카카오 AI추천 : 카카오의 콘텐츠 기반 필터링 (Content-based Filtering in Kakao)](https://tech.kakao.com/2021/12/27/content-based-filtering-in-kakao/)

- `2021-10-18` [카카오 AI추천 : 협업 필터링 모델 선택 시의 기준에 대하여](https://tech.kakao.com/2021/10/18/collaborative-filtering/)

- `2021-06-25` [카카오 AI추천 : 토픽 모델링과 MAB를 이용한 카카오 개인화 추천](https://tech.kakao.com/2021/06/25/kakao-ai-recommendation-01/)

- `2021-05-20` [카카오 AI추천 : 카카오페이지와 멜론으로 살펴보는 카카오 연관 추천](https://tech.kakao.com/2021/05/20/kakao-ai-recommendation/)

- `2018-01-31` [카카오내비 예측의 정확성 그리고 AI](https://brunch.co.kr/@kakao-it/193)

- `2017-10-31` [카카오I 추천 엔진의 진화](https://brunch.co.kr/@kakao-it/136)

- `2017-06-23` [내 손안의 AI 비서, 추천 알고리듬 - 카카오의 AI 추천 플랫폼, ‘토로스(TOROS)’](https://brunch.co.kr/@kakao-it/72)

### 논문

- [How Important is Periodic Model Update in Recommender Systems?](https://doi.org/10.1145/3539618.3591934) (SIGIR '23)

- [Predicting Query-Item Relationship using Adversarial Training and Robust Modeling Techniques](https://amazonkddcup.github.io/papers/0620.pdf) (KDD Cup '22)

- [Simple and Efficient Recommendation Strategy for Warm/Cold Sessions for RecSys Challenge 2022](https://dl.acm.org/doi/10.1145/3556702.3556851) (Recsys'22 Challenge)

- [An Efficient Combinatorial Optimization Model Using Learning-to-Rank Distillation](https://www.aaai.org/AAAI22Papers/AAAI-4140.WooH.pdf) (AAAI '22)

- [A Global DAG Task Scheduler Using Deep Reinforcement Learning and Graph Convolution Network](https://ieeexplore.ieee.org/abstract/document/9626004) (IEEE Access)

- [Melon Playlist Dataset: a public dataset for audio-based playlist generation and music tagging](https://arxiv.org/abs/2102.00201) (ICASSP '21)

- [How Low Can You Go? Reducing Frequency and Time Resolution in Current CNN Architectures for Music Auto-tagging](https://arxiv.org/abs/1911.04824) (EUSIPCO '20)

- [FlexGraph: Flexible partitioning and storage for scalable graph mining](https://journals.plos.org/plosone/article/metrics?id=10.1371/journal.pone.0227032) (PLoS ONE)

- [Artist and style exposure bias in collaborative filtering based music recommendations](https://arxiv.org/abs/1911.04827) (ISMIR '19 Workshop)

- [Enhancing VAEs for Collaborative Filtering: Flexible Priors & Gating Mechanisms](https://arxiv.org/abs/1911.00936) (RecSys '19)

- [Sequential and Diverse Recommendation with Long Tail](https://www.ijcai.org/proceedings/2019/380) (IJCAI '19)

- [Automatic playlist continuation using a hybrid recommender system combining features from text and audio](https://arxiv.org/abs/1901.00450) (RecSys '18 Challenge)

- [A study on intelligent personalized push notification with user history](https://ieeexplore.ieee.org/document/8258081) (BigData '17)

### if(kakao)

#### if(kakao)25

> <https://if.kakao.com/2025>

- `2025-09-23` [커뮤니티로 진화한 오픈채팅, AI로 슬기롭게 연결하다 (추천시스템 파트)](https://if.kakao.com/2025/session?sessionId=11)

#### if(kakao)dev2022

> <https://if.kakao.com/2022>

- `2022-12-08` [실험을 잘한다는 것은 무엇일까?](https://if.kakao.com/2022/session/4)

- `2022-12-08` [Sequential Recommendation System 카카오 서비스 적용기](https://if.kakao.com/2022/session/8)

- `2022-12-08` [Explainable Recommender System in 카카오웹툰](https://if.kakao.com/2022/session/9)

#### if(kakao)2021

> <https://if.kakao.com/2021>

- `2021-11-17` [ML로 기프트권 받을 유저 정하기](https://if.kakao.com/2021/session/26)

- `2021-11-17` [BERT보다 10배 빠른 BERT 모델 구축](https://if.kakao.com/2021/session/27)

- `2021-11-17` [TensorFlow Serving보다 10배 빠르게 서빙하기](https://if.kakao.com/2021/session/28)

- `2021-11-17` [추천 시스템 airflow 2.0 도입기](https://if.kakao.com/2021/session/29)

#### if(kakao)2020

> <https://if.kakao.com/2020>

- `2020-11-18` [개인화 콘텐츠 푸시 고도화 후기](https://if.kakao.com/2020/session/93)

- `2020-11-18` [추천 시스템, 써보지 않겠는가? 맥락과 취향 사이 줄타기](https://if.kakao.com/2020/session/125)

#### if(kakao)dev2019

> <https://if.kakao.com/2019>

- `2019-08-30` [둥꿍둥꿍 느낌 아는 음악 바텐더](https://if.kakao.com/2019/program?sessionId=1bfc0d56-3946-4e40-9ab1-523f16d8594a) - [발표 자료](https://mk.kakaocdn.net/dn/if-kakao/conf2019/%EB%B0%9C%ED%91%9C%EC%9E%90%EB%A3%8C_2019/T08-S01.pdf) / [발표 영상](https://mk-v1.kakaocdn.net/dn/if-kakao/conf2019/conf_video_2019/2_103_01_m1.mp4)

- `2019-08-30` [Buffalo: Open Source Project for Recommender System](https://if.kakao.com/2019/program?sessionId=c59d4061-6914-4a65-8fb5-f0a0c6c65b93) - [발표 자료](https://mk.kakaocdn.net/dn/if-kakao/conf2019/%EB%B0%9C%ED%91%9C%EC%9E%90%EB%A3%8C_2019/T08-S02-Buffalo.pdf) / [발표 영상](https://mk-v1.kakaocdn.net/dn/if-kakao/conf2019/conf_video_2019/2_103_02_m1.mp4)

- `2019-08-30` [상품 카탈로그 자동 생성 ML 모델 소개](https://if.kakao.com/2019/program?sessionId=dce0dd84-d054-4b80-8013-b3d58f61bbe8) - [발표 자료](https://mk.kakaocdn.net/dn/if-kakao/conf2019/%EB%B0%9C%ED%91%9C%EC%9E%90%EB%A3%8C_2019/T08-S04.pdf) / [발표 영상](https://mk-v1.kakaocdn.net/dn/if-kakao/conf2019/conf_video_2019/2_103_04_m1.mp4)

#### if(kakao)dev2018

> <https://if.kakao.com/2018>

- `2018-09-04` [눈으로 듣는 음악 추천 시스템](https://if.kakao.com/2018/program?sessionId=959a3047-0a08-4a42-99ce-35a9210ab49a) - [발표 자료](https://mk.kakaocdn.net/dn/if-kakao/conf2018/%E1%84%82%E1%85%AE%E1%86%AB%E1%84%8B%E1%85%B3%E1%84%85%E1%85%A9%20%E1%84%83%E1%85%B3%E1%86%AE%E1%84%82%E1%85%B3%E1%86%AB%20%E1%84%8B%E1%85%B3%E1%86%B7%E1%84%8B%E1%85%A1%E1%86%A8%20%E1%84%8E%E1%85%AE%E1%84%8E%E1%85%A5%E1%86%AB%20%E1%84%89%E1%85%B5%E1%84%89%E1%85%B3%E1%84%90%E1%85%A6%E1%86%B7.pdf) / [발표 영상](http://tv.kakao.com/v/391418802)

- `2018-10-01` [눈으로 듣는 음악 추천 시스템](https://brunch.co.kr/@kakao-it/282)

- `2018-09-04` [TOROS N2 - lightweight approximate Nearest Neighbor library](https://if.kakao.com/2018/program?sessionId=ad6ea793-70e6-495c-b154-c765e6339793) - [발표 자료](https://mk.kakaocdn.net/dn/if-kakao/conf2018/TOROS%20N2%20-%20lightweight%20approximate%20Nearest%20Neighbor%20library.pdf) / [발표 영상](http://tv.kakao.com/v/391419278)

- `2018-11-21` [TOROS N2](https://brunch.co.kr/@kakao-it/300)

### 카카오 아레나

> [카카오 아레나 서비스 종료 및 데이터셋 다운로드 안내](https://github.com/kakao/recoteam/discussions/9)

- `2018-12-31` [문제 해결을 위한 머신러닝 오픈 플랫폼, 카카오 아레나](https://brunch.co.kr/@kakao-it/321)

#### 3회 대회 (Melon Playlist Continuation)

- `2022-05-27` [카카오 AI추천 : 카카오 음악 추천을 경험해보고 싶다면? Melon Playlist Dataset (feats. Kakao Arena)](https://tech.kakao.com/2022/05/27/melon-playlist-dataset/)

- `2020-04-28` [멜론 플레이리스트 데이터 탐색 - _카카오 아레나 3회 대회 (Part.2)_](https://brunch.co.kr/@kakao-it/343)

- `2020-04-22` [멜론에서 음악 추천을 어떻게 할까? - _카카오 아레나 3회 대회 (Part.1)_](https://brunch.co.kr/@kakao-it/342)

#### 2회 대회 (브런치 사용자를 위한 글 추천 대회)

- `2019-07-04` [브런치 추천의 힘에 대한 6가지 기술(記述) - _카카오 아레나 2회 대회 (Part. 2)_](https://brunch.co.kr/@kakao-it/333)

- `2019-06-24` [브런치 데이터의 탐색과 시각화 - _카카오 아레나 2회 대회 (Part.1)_](https://brunch.co.kr/@kakao-it/332)

### 외부 발표

- `2022-12-22` [Machine Learning Engineer 여행 가이드](/presentations/ksc2022/KSC2022_ML_Engineer_%EC%97%AC%ED%96%89%EA%B0%80%EC%9D%B4%EB%93%9C_%EC%B9%B4%EC%B9%B4%EC%98%A4_%EC%B6%94%EC%B2%9C%ED%8C%80_%EA%B9%80%EC%84%B1%EC%A7%84.pdf) @ KSC 2022

- `2021-12-15` [우리 생활 속 추천 시스템, 어떻게 발전해왔고 어떻게 발전해나가고 있는가?](https://www.youtube.com/watch?v=jJfXHo7nNe8) @ 데이터 그랜드 컨퍼런스 2021

- `2021-05-21` [추천 기술이 마주하고 있는 현실적인 문제들](https://www.youtube.com/watch?v=UUY8YEesIVY) - [발표 자료](/presentations/ai_frontier2021/AIFrontier2021_Recommender_system_in_real_world_nick.pdf) @ AI Frontiers Summit 2021

- `2020-11-25` [유저가 좋은 작품(웹툰)를 만났을 때 (유저의 탐색, 발견 그리고 만족도에 대하여 탐색적 분석하기)](https://deview.kr/2020/sessions/332) @ DEVIEW 2020

- `2019-08-18` [추천시스템, 이제는 돈이 되어야 한다.](https://archive.pycon.kr/2019/program/talk-detail/?id=136) @ PyCon Korea 2019

- `2018-08-19` [추천 시스템을 위한 어플리케이션 서버 개발 후기](https://archive.pycon.kr/2018/program/33) @ PyCon Korea 2018

- `2016-08-13` [TOROS: Python Framework for Recommender](https://archive.pycon.kr/2016apac/program/50) @ PyCon Korea 2016

================================================

FILE: docs/arena/brunch.html

================================================

<!DOCTYPE html>

<html lang="ko">

<head>

<meta charset="utf-8" />

<title>kakao dataset</title>

<meta name="viewport" content="width=device-width, initial-scale=1" />

<link rel="preconnect" href="https://fonts.googleapis.com" /

<link rel="preconnect" href="https://fonts.gstatic.com" crossorigin />

<link

href="https://fonts.googleapis.com/css2?family=Noto+Sans+KR:wght@100;300;400;500;700;900&display=swap"

rel="stylesheet"

/>

<link href="./app.min.css" rel="stylesheet" />

</head>

<body>

<header>

<p>브런치 데이터셋</p>

</header>

<main>

<p class="title">브런치 데이터셋 다운로드 동의서</p>

<section>

<p style="font-weight: 500; color: black">

브런치 데이터셋 다운로드 및 이용에 따른 주의사항

</p>

<br />

<hr />

<br />

<p>

본 데이터셋 다운로드 및 이용을 위해서는 반드시 아래 주의사항을

확인하여야 합니다.

</p>

<div class="border-box">

<ul>

<li>

카카오는 데이터셋에 대한 소유자로 정당한 권리를 가지고 있습니다.

본 데이터셋은 비영리 연구 목적으로 공증된 관행에 합치되는

방법으로만 이용할 수 있습니다. 연구, 논문에 데이터를 이용/인용할

경우 ' Kakao (https://www.kakaocorp.com) ’와 같이 반드시 출처를

포함하여 표기하여야 하며 제공되는 데이터셋의 무단전재 및 재배포를

금지합니다.

</li>

<li>

카카오는 데이터셋을 다른 목적으로 사용함에 따른 정확성, 적합성,

유효성을 보증하지 않습니다. 데이터셋 사용에 따른 책임은 전적으로

이용자에게 있으며, 카카오는 그 사용에 따른 책임으로 면책됩니다. 본

데이터셋 다운로드 및 이용에 따른 주의사항을 위반하거나 데이터셋의

다운로드 및 이용 과정에서 카카오에게 손해가 발생할 경우,

카카오에게 해당 손해를 배상할 책임이 있습니다.

</li>

<li>

본 주의사항을 읽고 이에 동의를 한 경우에만 데이터셋 다운로드 및

이용이 가능합니다.

</li>

</ul>

</div>

<div class="checkbox">

<label for="agree">

<input

type="checkbox"

id="agree"

onchange="document.getElementsByName('download').forEach((el) => el.disabled = !this.checked);"

/>

위 주의사항을 확인하였으며, 모든 내용에 동의합니다.

</label>

</div>

<br />

<hr />

<br />

<p>데이터셋 설명</p>

<div class="border-box">

<p>

이 데이터셋이 제공하는 정보는 2018년 10월 1일부터 2019년 3월

14일까지 브런치 서비스에서 수집된 정보의 일부분입니다.

</p>

<ul>

<li>

read 디렉토리: 본 글 정보

<ul>

<li>

read.tar은 <b>2018년 10월 1일부터 2019년 3월 1일까지</b> 일부

브런치 독자들이 본 글의 정보가 총 3,625개의 파일로 구성되어

있습니다.

</li>

<li>

파일의 이름은 <code>시작일_종료일</code> 형태입니다. 예를 들어

<code>2018110708_2018110709</code> 파일은 2018년 11월 7일 오전

8시부터 2018년 11월 7일 오전 9시 전까지 본 글입니다.

</li>

<li>

파일은 여러 줄로 이뤄져 있으며 하나의 줄은 브런치의 독자가

파일의 시간 동안 본 글을 시간 순으로 기록한 것입니다. 한 줄의

정보는 공백으로 구분되어 있으며 첫번 째가 독자의 암호화된

식별자이고 그 뒤로는 해당 독자가 본 글의 정보입니다.

</li>

<li>

예를 들어 <code>read/2019022823_2019030100</code> 파일에

기록된 아래 정보는

<code>#8a706ac921a11004bab941d22323efab</code> 라는 독자가

2019년 2월 28일 23시에서 2019년 3월 1일 0시 사이에

<code

>@bakchacruz_34 @wo-motivator_133 @wo-motivator_133</code

>

를 순서대로 보았다는 뜻입니다.

<code>@wo-motivator_133</code> 글이 두 번 나타난 것은 이 글을

보기 위해 두 번 방문했다는 뜻입니다.

</li>

<ul>

<li>

<code>

#8a706ac921a11004bab941d22323efab @bakchacruz_34

@wo-motivator_133 @wo-motivator_133</code

>

</li>

</ul>

<li>

글을 보았다는 의미는 특정 글에 모바일, PC, 앱을 통해

접근했다는 뜻입니다. 머문 시간에 대한 정보가 제공되지 않기

때문에 실제로 글을 읽지 않고 이탈하는 등의 가능성도 있습니다.

</li>

</ul>

</li>

<li>

metadata.json: 글의 메타데이터

<ul>

<li>643,104 줄로 구성된 글의 메타데이터입니다.</li>

<li>

이 메타데이터에는

<b>2018년 10월 1일부터 2019년 3월 14일까지</b>

독자들이 본 글에 대한 정보입니다.

</li>

<li>

작가가 비공개로 전환하였거나 삭제 등의 이유로 학습 데이터로

제공된 2018년 10월 1일부터 2019년 3월 1일 전까지의 본 글

정보에는 이 메타데이터에 없는 글이 있을 수 있습니다.

<ul>

<li>

<b

>개발 데이터와 평가 데이터에 포함된 글의 메타데이터도

포함되어 있습니다. 즉, 평가 대상자들이 2019년 3월

1일부터 2019년 3월 14일 사이에 본 모든 글에 대한 정보가

포함되어 있습니다.</b

>

</li>

</ul>

</li>

<li>

필드 설명

<ul>

<li>

magazine_id: 이 글의 브런치 매거진 아이디 (없을 시는 0)

</li>

<li>

reg_ts: 이 글이 등록된 시간(<a

href="https://ko.wikipedia.org/wiki/유닉스_시간"

>유닉스 시간</a

>, 밀리초)

</li>

<li>user_id: 작가 아이디</li>

<li>article_id: 글 번호</li>

<li>id: 글 식별자</li>

<li>title: 제목</li>

<li>sub_title: 부제목</li>

<li>display_url: 웹 주소</li>

<li>keyword_list: 작가가 부여한 글의 태그 정보</li>

</ul>

</li>

<li>

메타데이터의 모든 정보는 작가의 비공개 여부 전환, 글 삭제,

수정 등으로 유효하지 않거나 변동될 수 있습니다.

</li>

</ul>

</li>

<li>contents 디렉토리: 글 본문 정보</li>

<ul>

<li>

저작권을 보호하고자 본문에서 형태소 분석을 통해 추출된 정보를

암호화하여 제공합니다. 총 7개의 파일로 나뉘어있습니다.

</li>

<li>

형태소 분석기는 카카오에서 공개한

<a href="https://github.com/kakao/khaiii">khaiii</a> 의 기본

옵션을 사용했습니다. 형태소 분석 결과의 어휘 정보는 임의의

숫자로 1:1 변환되었습니다. 동일 어휘의 경우, 품사와 관계없이

같은 숫자로 변환됩니다.

</li>

<li>

형태소 분석에 대한 설명과 품사의 의미에 대해서는 별도 제공하지

않습니다.

</li>

<li>

형태소 추출 전에 텍스트를 제외한 HTML과 같은 내용과 관계없는

정보는 제거 했으나 일부 정보가 남았을 수 있습니다.

</li>

<li>

필드 설명

<ul>

<li>id: 글 식별자</li>

<li>

morphs: 형태소 분석 결과

<ul>

<li>

리스트의 리스트로 구성되며, 리스트의 첫 번째 요소는 첫

어절의 분석 결과입니다.

</li>

<li>어휘와 품사는 / 구분자로 구분됩니다.</li>

<li>

예를 들어 "안녕하세요 브런치입니다"라는 문장은 khaiii

형태소분석기에서 "안녕/NNG + 하/XSA + 시/EP + 어요/EF",

"브런치/NNP + 이/VCP + ㅂ니다/EC" 라고 분석되는데, 이

결과는 morphs에서 다음처럼 나타날 수 있습니다.

[["8/NNG", "13/XSA", "81/EP", "888/EF"], ["0/NNP",

"12913/VCP", "29/EC"]]

</li>

<li>

여러 줄에 걸친 결과는 개행 구분 없이 리스트에 연속적으로

등장합니다. 예를 들어 "안녕하세요

브런치입니다\n안녕하세요"의 결과는 다음과 같습니다.

[["8/NNG", "13/XSA", "81/EP", "888/EF"], ["0/NNP",

"12913/VCP", "29/EC"], ["8/NNG", "13/XSA", "81/EP",

"888/EF"]]

</li>

</ul>

</li>

<li>

chars: 형태소 분석 결과

<ul>

<li>

형태소 분석 결과에서 어휘 부분을 문자 단위로 암호화환

결과입니다.

</li>

<li>

한 어휘의 문자는 + 구분자로 결합합니다. 예를 들어 위

예의 "브런치입니다"는 chars 필드에서 다음처럼 나타날 수

있습니다. "0+1+2/NNP", "4/VCP", "9+29+33/EC"

</li>

</ul>

</li>

</ul>

</li>

<li>

<strong

>metadata.json과 마찬가지로 개발 데이터와 평가 데이터의 글

본문도 포함되어 있습니다.</strong

>

</li>

<li>

contents 정보는 본문이 없는 글의 경우 제공되지 않을 수 있습니다.

</li>

</ul>

<li>

users.json: 사용자 정보

<ul>

<li>가입한 사용자(작가 혹은 독자)의 정보입니다.</li>

<li>

필드 설명

<ul>

<li>

keyword_list: 최근 며칠간 작가 글로 유입되었던 검색 키워드

</li>

<li>following_list: 구독 중인 작가 리스트</li>

<li>id: 사용자 식별자</li>

</ul>

</li>

<li>

총 310,758명의 정보가 있습니다. 탈퇴 등의 이유로 사용자 정보가

없을 수 있습니다.

</li>

</ul>

</li>

<li>

magazine.json: 매거진 정보

<ul>

<li>총 27,967개의 브런치 매거진 정보입니다.</li>

<li>

필드 설명

<ul>

<li>id: 매거진 식별자</li>

<li>

<code>magazine_tag_list</code>: 작가가 부여한 매거진의

태그 정보

</li>

</ul>

</li>

</ul>

</li>

<li>

predict 디렉토리: 예측할 사용자 정보

<ul>

<li>

dev.users: 개발 데이터입니다. 대회 기간에 예측한 성능을

평가하기 위해 제공한 사용자 3,000명 리스트입니다.

</li>

<li>

test.users: 평가 데이터입니다. 대회 종료 후 최종 순위를

결정하기 위해 제공한 사용자 5,000명의 리스트입니다.

</li>

<li>

일부 사용자는 2018년 10월 1일부터 2019년 3월 1일까지 본 글이

없을 수도 있습니다.

</li>

</ul>

</li>

<li>

식별자에 대해서

<ul>

<li>

사용자 식별자와 콘텐츠 식별자는 식별자 값에 '_' 존재 여부로

나뉩니다.

</li>

</ul>

</li>

</ul>

</div>

<div style="display: flex; place-content: center">

<a

href="https://drive.google.com/drive/folders/10BTayTV3mFwzAokyTt-20-g79rpUlFVz?usp=sharing"

>

<button name="download" id="download" disabled>Download</button>

</a>

</div>

</section>

</main>

</body>

</html>

================================================

FILE: docs/arena/common.css

================================================

@charset "utf-8";

/* 웹폰트 */

@import url('https://fonts.googleapis.com/css?family=Noto+Sans+KR:400,500&subset=korean');

@font-face {

font-family: 'Noto Sans';

src:url(../font/NotoSansCJKkr-Regular.eot?#iefix) format('embedded-opentype');

font-weight: normal;

font-style: normal;

}

@font-face {

font-family: 'Noto Sans';

src:url(../font/NotoSansCJKkr-Medium.eot?#iefix) format('embedded-opentype');

font-weight: 500;

font-style: normal;

}

@font-face {

font-family: 'Noto Sans';

src:url(../font/NotoSansCJKkr-Bold.eot?#iefix) format('embedded-opentype');

font-weight: bold;

font-style: normal;

}

/* reset */

body,div,dl,dt,dd,ul,ol,li,h1,h2,h3,h4,h5,h6,pre,code,form,fieldset,legend,textarea,p,blockquote,th,td,input,select,button{margin:0;padding:0}

fieldset,img{border:0 none}

dl,ul,ol,menu,li{list-style:none}

blockquote, q{quotes:none}

blockquote:before, blockquote:after,q:before, q:after{content:'';content:none}

input,select,textarea,button{vertical-align:middle;font-size:100%}

button{border:0 none;background-color:transparent;cursor:pointer}

table{border-collapse:collapse;border-spacing:0}

body{-webkit-text-size-adjust:none}

input:checked[type='checkbox']{background-color:#666; -webkit-appearance:checkbox}

input[type='text'],input[type='password'],input[type='submit'],input[type='search'],input[type='tel'],input[type='email'],html input[type='button'],input[type='reset']{-webkit-appearance:none;border-radius:0}

input[type='search']::-webkit-search-cancel-button{-webkit-appearance:none}

body{background:#fff}

body,th,td,input,select,textarea,button{font-size:13px;line-height:1.5;font-family: 'Noto Sans CJK Kr', 'Noto Sans KR', 'Noto Sans', sans-serif;color:#222}

a{color:#222;text-decoration:none}

a:active, a:hover{text-decoration:none}

address,caption,cite,code,dfn,em,var{font-style:normal;font-weight:normal}

/* global */

#kakaoIndex{overflow:hidden;position:absolute;left:-9999px;width:0;height:1px;margin:0;padding:0}

.ir_pm{display:block;overflow:hidden;font-size:1px;line-height:0;color:transparent}

.ir_wa{display:block;overflow:hidden;position:relative;z-index:-1;width:100%;height:100%}

.ir_caption{overflow:hidden;width:1px;font-size:1px;line-height:0;text-indent:-9999px}

.screen_out{overflow:hidden;position:absolute;width:0;height:0;line-height:0;text-indent:-9999px}

.show{display:block}

.hide{display:none}

.comm_layer{display:none;flex-direction:column;overflow:auto;position:fixed;top:0%;left:0%;z-index:1000;width:100%;height:100%;background:rgba(0,0,0,0.4);}

.comm_layer .inner_layer{position:absolute;top:50%;left:50%;background-color:var(--color-white);border:1px solid #cecece;text-align:center;transform:translate(-50%,-50%);}

.info_layer .inner_layer{top:139px;transform:translate(-50%, 0);width:498px;height:396px;box-sizing:border-box;}

.info_layer .layer_head{display:flex;justify-content:center;align-items:center;height:80px;background-color:#fee500;}

.info_layer .layer_head .tit_info{display: inline-block;font-size:21px;line-height:31px;letter-spacing:-1.05px;color:#1E1E1E;}

.info_layer .layer_head .tit_info .logo_kakaoarena{display:inline-block;width:129px;}

.info_layer .layer_body{padding:40px 60px 35px;background-color:#fff;}

.info_layer .layer_body .txt_info{font-size:15px;line-height: 22px;color:#000000;}

.info_layer .layer_body .txt_info .tit_item{display:block;margin-bottom:22px;font-size:16px;font-weight:bold;line-height:22px;}

.info_layer .layer_body .link_detail{display:block;margin:30px auto 0;width:175px;height:50px;background-color:#fee500;font-size:15px;font-weight:500;line-height:50px;text-align:center;color:#1E1E1E;}

.info_layer .layer_foot{display:flex;justify-content:space-between;}

.info_layer .layer_foot .btn_alert{flex:1;width:50%;height:50px;background-color:#f5f5f5;border-top:1px solid #cecece;font-size:14px;font-weight:500;line-height:50px;text-align:center;color:#1E1E1E;}

.info_layer .layer_foot .btn_alert ~ .btn_alert {border-left:1px solid #cecece;}

.comm_layer.show{display:flex;}

.notice_type{padding: 11px 0 80px;}

.notice_type .doc-header .inner-header{max-width:1058px;margin:0 auto;}

.notice_type .logo_kakaoarena{display:inline-block;width:148px;vertical-align:middle;}

.notice_type .inner_main{max-width:1058px;margin:69px auto 0;}

.notice_type .tit_notice{font-size:56px;font-weight:bold;line-height:83px;letter-spacing:-2.33px;color:#1E1E1E;}

.notice_type .txt_notice{margin:28px 0 60px;font-size:18px;font-weight:500;line-height:32px;letter-spacing:-1px;color:#000000;}

.notice_type .tbl_notice{margin-bottom:33px;border-top:1px solid #979797;border-bottom:1px solid #979797;}

.notice_type .tbl_notice th,td{padding:0 42px 0;background-color:#fafafa;border-bottom:1px solid #dadbdc;font-size:14px;font-weight:normal;line-height:70px;color:#000000;text-align:left;vertical-align: middle;}

.notice_type .tbl_notice .tit_item{font-size:15px;font-weight:500;}

.notice_type .list_notice{margin-left:14px;}

.notice_type .list_notice > li{position:relative;padding-left:10px;font-size:13px;line-height:25px;letter-spacing:-0.41px;color:#3C3C3C;}

.notice_type .list_notice > li:before{content:'';position:absolute;top:50%;left:0;width:3px;height:3px;transform: translateY(-50%);background-color:#3C3C3C;border-radius: 100%;}

.notice_type .link_notice{display:block;width:391px;height:70px;margin:60px auto 0;background-color: #FEE500;line-height:70px;font-size:18px;font-weight:500;color:#1E1E1E;text-align: center;}

.tbl_comm{width:100%;border:0;border-spacing:0;table-layout:fixed;border-collapse:collapse;}

================================================

FILE: docs/arena/index.html

================================================

<!DOCTYPE html>

<html lang="ko">

<head>

<meta charset="utf-8">

<meta http-equiv="X-UA-Compatible" content="IE=edge,chrome=1">

<title>kakao arena</title>

<meta name="viewport" content="width=device-width,initial-scale=1,minimum-scale=1,maximum-scale=1,user-scalable=no">

<link rel="icon" type="image/x-icon" href="./favicon.ico">

<link rel="stylesheet" type="text/css" href="./common.css">

</head>

<body>

<div class="container-doc notice_type">

<header class="doc-header">

<div class="inner-header">

<h1 class="doc-title"> <a href="#none"> <img src="./kakao-arena.svg" width="148" height="23" class="logo_kakaoarena" alt="kakao arena"> </a> </h1>

</div>

</header>

<main class="doc-main">

<div class="inner_main">

<article class="content-article">

<h2 class="tit_notice">카카오 아레나가 종료되었습니다.</h2>

<p class="txt_notice">그동안 카카오 아레나 서비스를 이용해 주셔서 진심으로 감사드립니다. 아쉽게도 카카오 아레나 서비스가 2023년 7월 3일 종료되었음을 알려드립니다.<br> 작성하신 게시글과 제출하신 자료에 대해 백업을 원하신다면 고객센터로 요청 바랍니다.<br> 데이터 백업 기간이 종료되면 게시글과 자료는 모두 안전하게 파기될 예정입니다.</p>

<table class="tbl_comm tbl_notice">

<caption class="ir_caption">백업 기간, 백업 대상, 백업 방법으로 구성된 백업 정보</caption>

<colgroup>

<col style="width:18%;">

<col>

</colgroup>

<tbody>

<tr>

<th> <strong class="tit_item">백업 기간</strong> </th>

<td> <strong class="tit_item">2023년 7월 3일(월) ~ 2023년 10월 4일(수)</strong> </td>

</tr>

<tr>

<th>백업 대상</th>

<td>본인이 작성한 글(글에 첨부된 이미지/파일), 대회 제출 소스 코드와 결과 파일</td>

</tr>

<tr>

<th>백업 방법</th>

<td>고객센터로 신청 시 이메일로 전달 (고객센터 로그인 필요)</td>

</tr>

</tbody>

</table> <strong class="screen_out">유의사항</strong>

<ul class="list_notice">

<li>백업 기간 이후에는 백업 신청 및 백업이 불가능합니다. 꼭 기간 내에 백업 신청을 완료해 주세요.</li>

<li>고객센터 백업 신청은 로그인 후 신청이 가능합니다. </li>

</ul> <a href="https://cs.kakao.com/requests?service=220&locale=ko" target="_blank" class="link_notice">백업 신청 고객센터 바로가기</a>

</article>

</div>

</main>

</div>

</body>

</html>

================================================

FILE: docs/arena/melon-en.html

================================================

<!DOCTYPE html>

<html lang="ko">

<head>

<meta charset="utf-8" />

<title>kakao dataset</title>

<meta name="viewport" content="width=device-width, initial-scale=1" />

<link rel="preconnect" href="https://fonts.googleapis.com" />

<link rel="preconnect" href="https://fonts.gstatic.com" crossorigin />

<link

href="https://fonts.googleapis.com/css2?family=Noto+Sans+KR:wght@100;300;400;500;700;900&display=swap"

rel="stylesheet"

/>

<link

rel="stylesheet"

href="node_modules/modern-normalize/modern-normalize.css"

/>

<link href="./app.min.css" rel="stylesheet" />

</head>

<body>

<header>

<p>Melon Dataset</p>

</header>

<main>

<p class="title">Melon Dataset Download Consent Form</p>

<section>

<p style="font-weight: 500; color: black">

Precautions Regarding the Download and Use of the Melon Dataset

</p>

<br />

<hr />

<br />

<p>

Before proceeding with the download and utilization of this dataset,

it is crucial to review and comply with the following precautions

carefully

</p>

<div class="border-box">

<ul>

<li>

Kakao Entertainment is the lawful owner of the dataset and

possesses all the necessary rights. The dataset is intended solely

for non-profit research purposes and should be utilized in

accordance with established industry practices. When utilizing or

referencing the data for research or scholarly papers, it is

mandatory to include the appropriate attribution as follows:

"Kakao Entertainment, melon (www.melon.com)." Unauthorized

reproduction or redistribution of the dataset is strictly

prohibited.

</li>

<li>

Please be aware that Kakao Entertainment does not guarantee the

accuracy, suitability, or validity of the dataset for purposes

other than those specified. The user assumes full responsibility

for the usage of the dataset, and Kakao Entertainment shall not be

held accountable for any consequences or liabilities arising from

its use. In case of any violation of the precautions regarding the

download and use of this dataset, or if any damages occur to Kakao

Entertainment during the process, the user shall be held

responsible for compensating Kakao Entertainment for such damages.

</li>

<li>

By confirming your understanding and agreement to the above

precautions, you may proceed with downloading and utilizing the

dataset.

</li>

</ul>

</div>

<div class="checkbox">

<label for="agree">

<input

type="checkbox"

id="agree"

onchange="document.getElementsByName('download').forEach((el) => el.disabled = !this.checked);"

/>

I have carefully read and fully agree to all the above terms and

conditions.

</label>

</div>

<br />

<hr />

<br />

<p>Dataset Description</p>

<div class="border-box">

<div class="border-content">

<h5>Melon Playlist Dataset</h5>

<p>

This dataset contains 148,826 playlists composed of 649,091 unique

songs and mel-spectrogram data for each song. The included

playlists are the listed item in the Melon DJ Playlist service

provided by Melon. In addition, Melon DJ Playlist consists of

playlists both made by experts contracting with us in advance for

quality assurance and filtered by the company’s quality standard

among those submitted by Melon users who want to put on the Melon

DJ Playlist. Each playlist contains songs and multiple sets of

tags (included in the 30,652 unique tags) assigned by the playlist

creator, along with its title.

</p>

</div>

<div class="border-content">

<h5>Playlist Included</h5>

<p>

For setting contest questions, we will provide the entire playlist

data separately as <code>train.json</code> composed of 115,071

playlists, <code>val.json</code> composed of 23,015 playlists, and

<code>test.json</code> composed of 10,740 playlists. Unlike

<code>train.json</code>, <code>test.json</code> and

<code>train.json</code> have some of the songs and tags in their

playlists masked for the submission of answers.

</p>

<h6 class="mt-2">Field Description</h6>

<ul>

<li>id: Playlist ID</li>

<li>plylst_title: Playlist title</li>

<li>tags: tag list</li>

<li>songs: song list</li>

<li>like_cnt: like count</li>

<li>updt_date: update date</li>

</ul>

</div>

<div class="border-content">

<h5>Mel-Spectrogram Included</h5>

<p>

Mel-spectrogram data are saved as a ‘<code>{songID}.npy</code>’

file name with the file extension npy. A number from 0 to 707988

is assigned as song ID, and each file is allocated to and stored

in the <code>{floor(ID / 1000)}/</code> directory. For example,

the song with ID 415263 is saved as 415/415263.npy. The

2.1b.dev677 version of Essentia library was used to extract each

mel-spectrogram. mel-spectrogram was calculated in the use of

segments of a song’s 20~50 second-interval to reduce the 16Khz

sample size rate, 512 frame size, 256 hop size, Hann window

function, and data size and employed 48 mel-bands resolution so

that Melon Playlist Dataset can contain about 240GB data.

</p>

</div>

<div class="border-content">

<h5>Meta-Data Included</h5>

<p>

Melon Playlist Dataset provides <code>song_meta.json</code>, the

song metadata saved in a separate json file format, and

<code>genre_gn_all.json</code>, the mapping table for genre

included in the song metadata. <code>song_meta.json</code> has

metadata for a total of 707,989 songs, including all songs in

<code>train.json</code>, <code>val.json</code>, and

<code>test.json</code>. The field description included is as

follows.

</p>

<h6 style="margin-top: 0.5rem">Field Description</h6>

<ul>

<li>_id: song ID</li>

<li>album_id: album ID</li>

<li>artist_id_basket: artist ID list</li>

<li>artist_name_basket: artist list</li>

<li>song_name: song title</li>

<li>song_gn_gnr_basket: song genre list</li>

<li>song_gn_dtl_gnr_basket: song detailed genre list</li>

<li>issue_date: issue date</li>

</ul>

</div>

<div class="border-content">

<small>

* All information in the metadata may be invalid or subject to

change due to the copyright holder’s privacy conversion, song

deletion, metadata modification, and the like.

</small>

</div>

<div class="border-content">

<p>

<code>genre_gn_all.json</code> contains a total of 254 genre

codes, including genre information for 30 major category genre

codes (included in <code>song_gn_gnr_basket</code>) and 224

detailed category genre codes (included in

<code>song_gn_gnr_basket</code>).

</p>

</div>

</div>

<div style="display: flex; place-content: center">

<a

href="https://drive.google.com/drive/folders/1h3allMBZAG20wYlt1bLFvZrsTQYB_1VU?usp=sharing"

>

<button name="download" id="download" disabled>Download</button>

</a>

</div>

</section>

</main>

</body>

</html>

================================================

FILE: docs/arena/melon.html

================================================

<!DOCTYPE html>

<html lang="ko">

<head>

<meta charset="utf-8" />

<title>kakao dataset</title>

<meta name="viewport" content="width=device-width, initial-scale=1" />

<link rel="preconnect" href="https://fonts.googleapis.com" />

<link rel="preconnect" href="https://fonts.gstatic.com" crossorigin />

<link

href="https://fonts.googleapis.com/css2?family=Noto+Sans+KR:wght@100;300;400;500;700;900&display=swap"

rel="stylesheet"

/>

<link

rel="stylesheet"

href="node_modules/modern-normalize/modern-normalize.css"

/>

<link href="./app.min.css" rel="stylesheet" />

</head>

<body>

<header>

<p>멜론 데이터셋</p>

</header>

<main>

<p class="title">멜론 데이터셋 다운로드 동의서</p>

<section>

<p style="font-weight: 500; color: black">

멜론 데이터셋 다운로드 및 이용에 따른 주의사항

</p>

<br />

<hr />

<br />

<p>

본 데이터셋 다운로드 및 이용을 위해서는 반드시 아래 주의사항을

확인하여야 합니다.

</p>

<div class="border-box">

<ul>

<li>

카카오 엔터테인먼트는 데이터셋에 대한 소유자로 정당한 권리를

가지고 있습니다. 본 데이터셋은 비영리 연구 목적으로 공증된 관행에

합치되는 방법으로만 이용할 수 있습니다. 연구, 논문에 데이터를

이용/인용할 경우 'Kakao Entertainment, melon (www.melon.com) ’와

같이 반드시 출처를 포함하여 표기하여야 하며 제공되는 데이터셋의

무단전재 및 재배포를 금지합니다.

</li>

<li>

카카오 엔터테인먼트는 데이터셋을 다른 목적으로 사용함에 따른

정확성, 적합성, 유효성을 보증하지 않습니다. 데이터셋 사용에 따른

책임은 전적으로 이용자에게 있으며, 카카오 엔터테인먼트는 그 사용에

따른 책임으로 면책됩니다. 본 데이터셋 다운로드 및 이용에 따른

주의사항을 위반하거나 데이터셋의 다운로드 및 이용 과정에서 카카오

엔터테인먼트에게 손해가 발생할 경우, 카카오 엔터테인먼트에게 해당

손해를 배상할 책임이 있습니다.

</li>

<li>

본 주의사항을 읽고 이에 동의를 한 경우에만 데이터셋 다운로드 및

이용이 가능합니다.

</li>

</ul>

</div>

<div class="checkbox">

<label for="agree">

<input

type="checkbox"

id="agree"

onchange="document.getElementsByName('download').forEach((el) => el.disabled = !this.checked);"

/>

위 주의사항을 확인하였으며, 모든 내용에 동의합니다.

</label>

</div>

<br />

<hr />

<br />

<p>데이터셋 설명</p>

<div class="border-box">

<div class="border-content">

<p>

이 데이터셋에는 649,091개의 고유 곡으로 구성된 148,826개의

플레이리스트와 각 곡에 대한 멜 스펙트로그램 데이터가 포함되어

있습니다. 포함된 플레이리스트는 멜론에서 제공하는 멜론 DJ

플레이리스트 서비스에 등재된 항목입니다. 또한, 멜론 DJ

플레이리스트는 당사와 사전 계약을 맺은 전문가가 품질 보증을 위해

만든 플레이리스트와 멜론 이용자가 멜론 DJ 플레이리스트에 올리고

싶은 플레이리스트 중 당사의 품질 기준에 의해 필터링된

플레이리스트로 구성됩니다. 각 재생목록에는 제목과 함께 재생목록

제작자가 지정한 노래와 여러 개의 태그(30,652개의 고유 태그에

포함)가 포함되어 있습니다.

</p>

<ul>

<li>

song_meta.json: 곡 메타데이터

<ul>

<li>

총 707,989개의 곡에 대한 메타데이터가 수록되어 있습니다.

</li>

<li>

<b

>개발 데이터와 평가 데이터에 수록된 모든 곡에 대한

메타데이터가 포함되어 있습니다.</b

>

</li>

<li>

필드 설명

<ul>

<li>_id: 곡 ID</li>

<li>album_id: 앨범 ID</li>

<li>artist_id_basket: 아티스트 ID 리스트</li>

<li>artist_name_basket: 아티스트 리스트</li>

<li>song_name: 곡 제목</li>

<li>song_gn_gnr_basket: 곡 장르 리스트</li>

<li>song_gn_dtl_gnr_basket: 곡 세부 장르 리스트</li>

<li>issue_date: 발매일</li>

</ul>

</li>

<li>

메타데이터의 모든 정보는 저작권자의 비공개 여부 전환, 곡

삭제, 메타데이터 수정 등으로 유효하지 않거나 변동될 수

있습니다.

</li>

</ul>

</li>

<li>

genre_gn_all.json:

<ul>

<li>

곡 메타데이터에 수록된 장르에 대한 정보입니다. 위

song_meta.json 에서 song_gn_gnr_basket 과

song_gn_dtl_gnr_basket 에 들어가는 정보들에 대한

메타데이터입니다.

</li>

</ul>

</li>

<li>

train.json:

<ul>

<li>

모델 학습용 파일로, 115,071개 플레이리스트의 원본 데이터가

수록되어 있습니다.

</li>

<li>

필드 설명

<ul>

<li>id: 플레이리스트 ID</li>

<li>plylst_title: 플레이리스트 제목</li>

<li>tags: 태그 리스트</li>

<li>songs: 곡 리스트</li>

<li>like_cnt: 좋아요 개수</li>

<li>updt_date: 수정 날짜</li>

</ul>

</li>

</ul>

</li>

<li>

val.json:

<ul>

<li>

공개 리더보드용 문제 파일로, 23,015개 플레이리스트에 대한

문제가 수록되어 있습니다. 모든 데이터가 수록되어있는 train

파일과는 다르게, 곡과 태그의 일부가 수록되어 있습니다.

</li>

<li>

필드 설명

<ul>

<li>id: 플레이리스트 ID</li>

<li>plylst_title: 플레이리스트 제목</li>

<li>tags: 태그 리스트</li>

<li>songs: 곡 리스트</li>

<li>like_cnt: 좋아요 개수</li>

<li>updt_date: 수정 날짜</li>

</ul>

</li>

</ul>

</li>

<li>

test.json:

<ul>

<li>

파이널 리더보드용 문제 파일로, 10,740개 플레이리스트에 대한

문제가 수록되어 있습니다. 모든 데이터가 수록되어있는 train

파일과는 다르게, 곡과 태그의 일부가 수록되어 있습니다.

</li>

<li>

필드 설명

<ul>

<li>id: 플레이리스트 ID</li>

<li>plylst_title: 플레이리스트 제목</li>

<li>tags: 태그 리스트</li>

<li>songs: 곡 리스트</li>

<li>like_cnt: 좋아요 개수</li>

<li>updt_date: 수정 날짜</li>

</ul>

</li>

</ul>

</li>

<li>

arena_mel_{0~39}.tar

<ul>

<li>

곡에 대한 mel-spectrogram 데이터를 담고있는 파일입니다. 위에

있는 파일들에서 등장하는 각 곡 ID마다 npy 파일 1개가

배정되어있습니다. numpy로 다음과 같이 로드할 수 있습니다.

<pre><code>import numpy as np

mel = np.load("0.npy")</code></pre>

</li>

<li>

곡 ID는 0~707988 까지 배정되어 있으며,

<code>곡ID.npy</code> 의 파일 이름을 가지고 있습니다. 파일의

갯수가 많기 때문에, 각 npy 파일은 각각

<code>{floor(ID / 1000)}/</code> 폴더 아래에 들어가있습니다.

예를 들어 곡 ID가 415263인 파일의 경우

<code>415/415263.npy</code> 로, 곡 ID가 53712인 경우

<code>53/53712.npy</code> 에 존재합니다.

</li>

</ul>

</li>

</ul>

</div>

</div>

<div style="display: flex; place-content: center">

<a

href="https://drive.google.com/drive/folders/1h3allMBZAG20wYlt1bLFvZrsTQYB_1VU?usp=sharing"

>

<button name="download" id="download" disabled>Download</button>

</a>

</div>

</section>

</main>

</body>

</html>

================================================

FILE: onboarding/README.md

================================================

# 추천팀 온보딩

카카오 추천팀에 입사하기 전에 미리 보시면 좋을 내용들을 정리해놓은 문서입니다.

## 추천 기술 관련 자료

해당 내용에 링크된 자료는 방대하므로(특히 수학/ML 기초) 필요한 부분들 위주로 보시기 바랍니다.

### 수학/ML 기초

추천 시스템은 머신러닝의 응용 분야로서 머신러닝에 대한 기초지식을 탄탄히 다지는 것은 큰 도움이 됩니다. 기본적인 Linear Algebra, Statistical Inference, Convex Optimization에 대해 익숙하지 않다면 이에 대한 학습이 필요할 수 있습니다.

대표적인 ML 교재 최소 1개 이상을 정독해본 경험을 가지는 것을 추천해 드립니다.

- [Introduction to Statistical Learning (ISLR)](https://www.statlearning.com/)

- [Elements of Statistical Learning (ESL)](https://hastie.su.domains/Papers/ESLII.pdf)

- [Machine Learning: A Probabilistic Perspective (Murphey 책)](https://probml.github.io/pml-book/)

- [Pattern Recognition an Machine Learning (Bishop 책)](https://www.microsoft.com/en-us/research/uploads/prod/2006/01/Bishop-Pattern-Recognition-and-Machine-Learning-2006.pdf)

- ... etc.

딥러닝 교재, 최신 추천시스템은 뉴럴넷을 활용하는 경우도 많고 자연어, 이미지 등의 데이터를 활용하는 경우도 있습니다.

- [Deep Learning Book](https://www.deeplearningbook.org/)

- ... etc.

### 추천 알고리즘

대표적인 올드 스쿨 알고리즘입니다. 해당 알고리즘들은 논문이 발표된지 오래되었지만, 아직도 대중적으로 많이 활용되고 있습니다.

- iALS ([Collaborative Filtering for Implicit Feedback Datasets](http://yifanhu.net/PUB/cf.pdf))

- BPR ([BPR: Bayesian Personalized Ranking from Implicit Feedback](https://arxiv.org/pdf/1205.2618.pdf))

- LinUCB ([A Contextual-Bandit Approach to Personalized News Article Recommendation](https://arxiv.org/pdf/1003.0146.pdf))

그 외, 벤치마크로 자주 등장하는 전통 알고리즘은 다음과 같습니다.

- WARP ([Improving Pairwise Learning for Item Recommendation from Implicit Feedback](http://webia.lip6.fr/~gallinar/gallinari/uploads/Teaching/WSDM2014-rendle.pdf))

- SLIM ([SLIM: Sparse Linear Methods for Top-N Recommender Systems](https://ieeexplore.ieee.org/abstract/document/6137254))

카카오 테크 블로그에 카카오 추천시스템에 대하여 주제별로 설명한 글들입니다.

- [테크 블로그: 추천 시스템](/README.md/#%EC%B6%94%EC%B2%9C-%EC%8B%9C%EC%8A%A4%ED%85%9C)

추천 관련 최신 논문들을 서칭해보고 abstract와 related works를 읽어보면 최신 연구 방향과 그 기반이 되는 주요 논문들을 알 수 있습니다

- 추천 관련 대표 학회들: RecSys, WWW, SIGIR, KDD, WSDM, CIKM, AAAI, IJCAI, ICML, NeurIPS, ... etc.

(좋은 논문인지와 별개로) 대표적으로 유명한 추천 알고리즘 논문들은 아래와 같습니다.

- [BERT4Rec: Sequential Recommendation with Bidirectional Encoder Representations from Transformer, CIKM'19](https://arxiv.org/abs/1904.06690)

- [Variational Autoencoders for Collaborative Filtering, WWW'18](https://dl.acm.org/doi/10.1145/3178876.3186150)

- [Neural Collaborative Filtering, WWW'17](https://dl.acm.org/doi/10.1145/3038912.3052569)

- [Recommending What Video to Watch Next: A Multitask Ranking System, RecSys'19](https://daiwk.github.io/assets/youtube-multitask.pdf)

- [Collaborative Metric Learning, WWW'17](https://vision.cornell.edu/se3/wp-content/uploads/2017/03/WWW-fp0554-hsiehA.pdf)

- [Convolutional Matrix Factorization for Document Context-Aware Recommendation, RecSys'16](http://uclab.khu.ac.kr/resources/publication/C_351.pdf)

- ... etc.

### 그 외

#### 강화학습

실시간 추천시스템은 사용자와 상호작용하며 사용자들의 취향을 파악하고 추천해주는 시스템으로서 강화학습 framework이 잘 어울린다는 평가가 많습니다, 특히 Multi-Armed Bandit, Contextual-Bandit 등은 팀 내에서도 매우 많이 사용되고 있습니다

- [강화학습 대표 교재 (Reinforcement Learning: An Introduction)](http://incompleteideas.net/book/the-book.html)

- [David Silver 강의](https://www.davidsilver.uk/teaching/)

## 머신러닝플랫폼 관련 자료

아래의 키워드는 모두 머신러닝플랫폼에서 중요한 것들이지만 업무에 필수는 아닙니다.

학습 비용이 만만치 않기 때문에 천천히 기반 다지는 것을 추천합니다.

### 방법론, 가이드

- [Domain Driven Design (DDD)](https://martinfowler.com/bliki/DomainDrivenDesign.html)

- [Microservices (MSA)](https://learn.microsoft.com/en-us/azure/architecture/guide/architecture-styles/microservices)

- [Event Driven Architecture (EDA)](https://learn.microsoft.com/en-us/azure/architecture/guide/architecture-styles/event-driven)

- [Cloud Native](https://learn.microsoft.com/en-us/dotnet/architecture/cloud-native/definition)

- [CI/CD](https://en.wikipedia.org/wiki/CI/CD)

- [Test Driven Development (TDD)](https://martinfowler.com/bliki/TestDrivenDevelopment.html)

### 개발 자원

머신러닝플랫폼은 대부분 파이썬 3.10을 사용하고 있습니다.

아래는 개발할 때 많이 사용하는 라이브러리를 간추렸습니다.

- [poetry](https://python-poetry.org/)

- [pydantic](https://pydantic-docs.helpmanual.io/)

- [pytest](https://pytest.org)

- [mypy](https://mypy.readthedocs.io/)

## 팀 개발환경 및 플랫폼

### 기본 개발환경

팀의 메인 개발언어는 Python, C++입니다.

코드 Editor로는 주로 Vim을 사용하고 있으나, 제약은 없으며 VSCode, PyCharm등 개발자 본인에게 가장 편한 editor를 사용할 수 있습니다. (단, 서버 내에서 작업하는 경우도 많기에, Vim에 대한 기본적인 사용법을 익혀두시면 유용합니다.)

- [Vim](https://www.vim.org/)

- [Vim adventures](https://vim-adventures.com/): Vim을 간단한 게임형태로 배워볼 수 있는 페이지입니다.

코드의 버전관리는 Git / GitHub를 사용하고 있습니다.

- [git](https://git-scm.com/)

- [Git/GitHub 안내서](https://subicura.com/git/guide/)

팀 내 대부분의 서비스는 docker 및 kubernetes를 기반으로 동작합니다.

- [docker](https://www.docker.com/)

- [초보를 위한 도커 안내서](https://subicura.com/2017/01/19/docker-guide-for-beginners-1.html)

- [kubernetes](https://kubernetes.io/)

- [쿠버네티스 안내서](https://subicura.com/k8s/guide/#%E1%84%80%E1%85%A1%E1%84%8B%E1%85%B5%E1%84%83%E1%85%B3)

### 플랫폼

#### Kafka

추천 시스템에서는 각 유저가 어떤 아이템을 소비했는지, 또 소비한 아이템에 대해 어떠한 반응을 보였는지에 대한 정보가 중요하게 사용됩니다. 이러한 정보는 서비스단에서 실시간으로 수집되어 [Kafka](https://kafka.apache.org/)를 통해 추천팀에서 받아볼 수 있는 형태로 전달되고 있습니다. 따라서 Kafka의 기본구조 및 동작 방식에 대해 미리 알아두시면 팀에서 실제 업무를 하실 때 많은 도움이 됩니다.

- [Youtube강의-아파치 카프카](https://www.youtube.com/playlist?list=PL3Re5Ri5rZmkY46j6WcJXQYRlDRZSUQ1j)

#### MongoDB

[MongoDB](https://www.mongodb.com/)는 팀에서 가장 많이 사용하는 key-value storage 중 하나이며, 주 사용처는 다음과 같습니다.

- 개별 유저에 대한 추천 결과 저장(캐시 용도)

- Feature storage

- 유저들의 아이템 소비 로그, 피드백 로그 저장

MongoDB 참고 자료 (팀 내에서 직접 관리를 하는 것은 아니기에 깊이 보실 필요는 없습니다. 아래에서는 3, 4, 5를 위주로 보셔도 괜찮습니다.)

- [1편: 소개, 설치 및 데이터 모델링](https://velopert.com/436)

- [2편: Database/Collection/Document 생성, 제거](https://velopert.com/457)

- [3편: Document Query(조회) - find() 메소드](https://velopert.com/479)

- [4편: find() 메소드 활용 - sort(), limit(), skip()](https://velopert.com/516)

- [5편: Document 수정 - update() 메소드](https://velopert.com/545)

- [pymongo docs](https://pymongo.readthedocs.io/en/stable/)

- pymongo는 MongoDB의 python client로써, 팀에서 MongoDB를 다룰 때 주로 사용하고 있습니다.

#### Hadoop

[Hadoop](https://hadoop.apache.org/)을 구성하는 여러 가지 요소가 있지만, 팀에서는 주로 HDFS, Hive(Presto, Spark)를 많이 사용합니다. Hadoop의 개별 요소를 세세히 설명하기엔 양이 너무 방대하기에, 간단한 개념 위주로 링크를 정리했습니다.

- HDFS: 유저 x 아이템 interaction 데이터 저장, 학습된 추천 모델 저장 등

- [hdfs 기본개념](https://kadensungbincho.tistory.com/30)

- [hdfs 명령어 모음](https://blog.voidmainvoid.net/175)

- Hive(Presto, Spark): 데이터 분석, 전처리 등에 사용

- [Hive, Presto, Spark 기본 설명](https://seoyoungh.github.io/data-science/distribute-system-1/)

================================================

FILE: paper_review/README.md

================================================

<p align="center">

<img height="150" src="https://user-images.githubusercontent.com/38134957/165143510-067f6b0f-4e0e-40c4-b224-729c57dc8afa.png"/><br>

<b>📝 카카오 추천팀 지식 저장소</b>

</p>

카카오 추천팀에서 추천 관련 학회의 논문들을 읽고 정리하는 저장소입니다. 정리는 크게 4가지 방식으로 구성되어 있습니다.

- Summary : 3줄 내외로 논문 내용을 요약합니다.

- Approach : 논문에서 쓰인 접근법들을 정리합니다.

- Results : 실험 결과에 대한 내용을 정리합니다.

- Conclusion : 논문에 대한 본인의 생각을 정리합니다.

발표 자료를 학회별, 주제별로 정리한 링크는 다음과 같습니다.

### Conferences

- [RecSys2021](recsys/recsys2021/RecSys2021.md)

### Topics

- [Algorithmic Advances](topics/Algorithmic%20Advances.md)

- [Applications-Driven Advances](topics/Applications-Driven%20Advances.md)

- [Bandits and Reinforcement Learning](topics/Bandits%20and%20Reinforcement%20Learning.md)

- [Echo Chambers and Filter Bubbles](topics/Echo%20Chambers%20and%20Filter%20Bubbles.md)

- [Interactive Recommendation](topics/Interactive%20Recommendation.md)

- [Language and Knowledge](topics/Language%20and%20Knowledge.md)

- [Metrics and Evaluation](topics/Metrics%20and%20Evaluation.md)

- [Practical Issues](topics/Practical%20Issues.md)

- [Privacy, Fairness, Bias](topics/Privacy,%20Fairness,%20Bias.md)

- [Real-World Concerns](topics/Real-World%20Concerns.md)

- [Scalable Performance](topics/Scalable%20Performance.md)

- [Theory and Practice](topics/Theory%20and%20Practice.md)

- [Users in Focus](topics/Users%20in%20Focus.md)

================================================

FILE: paper_review/recsys/recsys2021/"Serving Each User"- Supporting Different Eating Goals Through a Multi-List Recommender Interface.md

================================================

# "Serving Each User"- Supporting Different Eating Goals Through a Multi-List Recommender Interface

- Paper : <https://doi.org/10.1145/3460231.3474232>

- Authors : Alain Starke, Edis Asotic, Christoph Trattner

- Reviewer : bell.park, marv.20

- Topics

- [#Users_in_Focus](../../topics/Users%20in%20Focus.md)

- #Diversity

- [#RecSys2021](RecSys2021.md)

## Summary

- 음식 추천 시스템에서, 유저의 다양한 목적을 만족시키기 위해 어떻게 노출시키면 좋을지(인터페이스)에 대해서 연구한 논문입니다.

- 추천 결과를 single-list와 multi-list 각각의 방법으로 노출했을 때 어떠한 차이가 있는지 유저 스터디로 비교 분석하였습니다.

- 리스트 간의 순서를 정하는 모델이나 로직이 없다는 것은 아쉽지만, 현실적인 접근이라고 생각됩니다.

## Approach

- 기본적으로 현재 보고있는 레시피와 유사한 레시피를 추천하는 연관 추천 환경입니다.

- 저자들이 직접 레시피 데이터를 긁어와서 5가지 추천 리스트를 구성하였습니다.

- Similar recipies - 레시피 이름 TF-IDF indexing후 top-5 similarity

- Fewer Calories - top-40 similarity 후 칼로리 작은 순서대로 top-5

- Fewer Carbohydrates - top-40 similarity 후 탄수화물 작은 순서대로 top-5

- Less Fat - top-40 similarity 후 지방 작은 순서대로 top-5

- More Fiber - top-40 similarity 후 섬유질 큰 순서대로 top-5

- 366명의 실험 참가자를 모집해서 실험을 진행하였습니다.

- 실험 참가자 마다 5번의 실험을 진행

- 참가자가 레시피를 검색해서 들어가면 아래 2가지 중 하나의 화면이 노출

- 미리 준비된 5개의 리스트 중 하나를 골라 노출

- 5개의 리스트를 전부 노출

- 설명은 붙이는 경우도 있고 안붙이는 경우(Similar recipies)도 있음

- 참가자는 레시피를 하나 고르고 레시피와 추천에 대해 만족도를 리포트

## Results

- 참가자의 피드백을 Structural Equation Modeling (SEM) 기법으로 분석하였습니다.

- 주목할 만한 결론은 다음과 같습니다.

- Multi-list로 노출하면 설명 여부와 상관 없이 참가자들이 더 다양하게 추천된다고 느낍니다. (higher **perceived** diversity)

- 실제로 다양하게 노출하는 것과는 다르고, 참가자들이 그렇게 느꼈다는 부분이 중요하다고 합니다.

- 참가자들이 다양하게 추천된다고 느끼면, 아래 두 가지 현상이 나타납니다.

- 하나의 아이템을 고르는데는 어려움을 느낍니다. (higher level of diversity, higher level of choice difficulty)

- 추천의 만족도가 증가합니다. (perceived diversity was also positively related to choice satisfaction)

- 참가자들이 추천이 나온 이유를 이해하면, 추천이 더 다양하다고 느낍니다.

- Single-list 노출 시에는 추천에 대한 설명을 붙여주었을 때 참가자 만족도가 올라가지만, Multi-list 노출 시에는 설명이 있을 때 만족도가 소폭 하락하였습니다.

================================================

FILE: paper_review/recsys/recsys2021/Accordion- a Trainable Simulator for Long-Term Interactive Systems.md

================================================

# Accordion- a Trainable Simulator for Long-Term Interactive Systems

- Paper : <https://dl.acm.org/doi/10.1145/3460231.3474259>

- Authors : James McInerney, Ehtsham Elahi, Justin Basilico, Yves Raimond, Tony Jebara

- Reviewer : hee.yoon

- Topics

- [#Metrics_and_Evaluation](../../topics/Metrics%20and%20Evaluation.md)

- [#RecSys2021](RecSys2021.md)

## Summary

- 유저와 인터렉션이 있는 시스템 기반의 트레인 가능한 시뮬레이터를 개발하였습니다.

- 구성은 다음과 같습니다.

- 유저가 visit 할지 여부를 결정하는 visit model

- 유저에게 해당 시점에 어떤 아이템이 추천될지 결정하는 recommedation imitator

- 유저가 추천된 아이템을 클릭할지 결정하는 user selection model

- 컨트리뷰션

- 이 중에서 visit model 를 inhomogeneous Poisson process 로 구현한 부분이 중요한 컨트리뷰션이라고 볼 수 있습니다.

- (비교 시뮬레이터가 Norm IPS인데) 왜 Norm IPS 에 비해, sim2real gap 을 더 줄일 수 있는가?

- 추천 퀄리티에 따라 impression수 자체가 차이가 날 수 있는 부분을 시뮬레이션에 녹여 모델링함

- code: <https://github.com/jamesmcinerney/accordion>

## Approach

- Simulator Data Generation Algorithm:

<img width="425" src="https://user-images.githubusercontent.com/38134957/165451689-0a84e898-1dfa-4458-a6cc-ad480e4bf16e.png">

- 구조도

<img width="878" src="https://user-images.githubusercontent.com/38134957/165451706-633cdcef-7bb8-49e8-81bf-77ac802ec50b.png">

- Visit Model

- Global Intensity + State-based intensity + Recent Activity intensity using Hawkes

- user_state, time 이 주어졌을 때 유저의 intensity를 리턴

- Recommender Imitator (= Impression Model?)

- user_state 가 주어졌을 때, item 을 리턴

- 컨트롤 폴리시 목적으로는 imitator 를 학습하여 사용할 수도 있고,

- 타겟 폴리시 목적으로는 실험하고자 하는 모델로 대체하여 사용할 수 있는 것으로 추정. (Non negative Matrix Factorization 으로 Hyperparameter Fitting 시뮬레이션 Section 4.2 참고)

- User Selection Model

- user_state, item 이 주어졌을때 reward 를 리턴

### Visit Model

- <img width="415" src="https://user-images.githubusercontent.com/38134957/165452520-c166ff03-b5e7-48f1-a7e2-9dcaaa73d1e8.png">

- <img width="893" src="https://user-images.githubusercontent.com/38134957/165452527-ee2d5d8d-53aa-435f-9122-daa1a5e12142.png">

- Inhomogeneous Poisson Process:

<img width="458" src="https://user-images.githubusercontent.com/38134957/165452534-fa7bd82a-a3ed-43d7-bfae-6a3730794050.png">

- Hawkes Intensity:

- 과거 추천 아이템에 유저가 긍정적으로 반응했을 경우 더 커짐

- <img width="416" src="https://user-images.githubusercontent.com/38134957/165452540-4820adcc-83a3-4e22-ae11-139ce0c8a46d.png">

### Marking Distribution = Recommendation Imitator (Impression Model) * User Selection Model

<img width="414" src="https://user-images.githubusercontent.com/38134957/165452547-33921795-2807-418f-b456-03c339e401d3.png">

- Both the impression model and user selection model use as

- input: a bag of words representation of previous user interactions with items

- and map these though a dense network

- output: to a multinomial distribution over items.

## Results

AB 테스트 결과를 얼마나 재현 가능한가? 를 평가하였습니다.

<img width="883" src="https://user-images.githubusercontent.com/38134957/165452683-9f9c01cf-f11a-4480-9134-258f926a3651.png">

================================================

FILE: paper_review/recsys/recsys2021/Burst-induced Multi-Armed Bandit for Learning Recommendation.md

================================================

# Burst-induced Multi-Armed Bandit for Learning Recommendation

- Paper : <https://dl.acm.org/doi/10.1145/3460231.3474250>

- Authors : Rodrigo Alves, Antoine Ledent, Marius Kloft

- Reviewer : charlie.cs

- Topics

- [#Algorithmic_Advances](../../topics/Algorithmic%20Advances.md)

- [#Bandits_and_Reinforcement_Learning](../../topics/Bandits%20and%20Reinforcement%20Learning.md)

- [#RecSys2021](RecSys2021.md)

## Summary

- non-stationary & context-free MAB 상황에서 Cold-start recommendation (CSR) 을 위한 방법인 BMAB (Burst-induced MAB)을 제시하였습니다.

- 기존 non-stationary MAB(EXP3, Discounted-UCB etc.)의 방식과 비교되는 특징은 다음과 같습니다.

1. context-free: feature vector가 필요하지 않습니다.

2. reward 분포의 변화를 확인하는 대신, 시스템의 temporal dynamics를 활용합니다.

## Approach

### Intuition

- 추천 환경에는 크게 두가지 상태가 있다고 가정: loyal (stable) state 그리고 curious (unstable) state

- 전체 time horizon은 일정 구간으로 나뉘어져서, 두 state 중 하나가 발생한다고 가정함

- loyal state는 구간에 상관없이, curious state는 구간마다 stationary payoff distribution를 가진다고 주장

<img src="https://user-images.githubusercontent.com/38134957/165448255-7e73d749-683e-44a5-9b29-c66dd37ef158.png " width=65%>

- state 마다 MAB 모델을 세우고, 특정 state 상황에 해당하는 모델을 이용하여 추천을 진행

### Burst-induced MAB (BMAB)

- Algorithm

1. 두 state (loyal, curious)마다 각각 K개의 beta parameter를 두고, orcale이 timestamp마다 어떤 state인지 알려줌

2. state를 확인하면, 해당 state의 beta parameter를 통해 일반적인 Thompson Sampling 추천을 진행

3. 만약 curious (s = 1) 에서 loyal (s = 0) 상태로 넘어가는 경우, curious state에 해당하는 beta parameter를 decay

<img src="https://tva1.sinaimg.cn/large/008i3skNgy1gwg5vya71xj30ou0j6gno.jpg" width=75%>

### State Detector

- 매 timestamp 마다 어떤 state인지 파악하는 orcale을 구성하기 위해서는 homoheneous Poisson process에 대한 intensity (`lambda_L`)가 알려져 있다는 가정이 요구됨

- intensity (function)는 쉽게 말하면 특정 구간에서 발생한 이벤트의 rate

- 이 가정의 존재 이유는 문제 초기 정의 시, time series 가 두가지 stochastic point process의 mixture에 의해 생성된다는 가정이 있었기 때문

- loyal: a homogeneous Possion process (HPP) with intensity `lambda_L`

- curious: a piece-wise homogeneous Poisson process (PW-HPP) with intensity `lambda_C(t)`

- 해당 intensity를 몰라도 쉽게 유추할 수 있다고 주장

- 예시 (HPP with `lambda_L=3`, PW-HPP with `lambda_C in (0.15, 15)`)

- Algorithm

- state를 추정할 timestep 구간을 사이즈가 `Delta` 인 window로 나누고, 해당 구간이 intensity 가 `lambda_L` 인 Possion process에서 생성되었는지 검증

- 즉, window 내 분포는 shape가 `Delta-1` 이고 scale이 `lambda_L` 인 Gamma distribution을 따르는지 확인

- 해당 분포를 따른다면 loyal (`0`) 그렇지 않다면 curious (`1`)

<img src="https://tva1.sinaimg.cn/large/008i3skNgy1gwg60ntwk5j30p40go0u5.jpg" alt="image-20211115224032770" width="65%" />

- `q` 는 Gamma 분포의 quantile function

- quantile function의 shape값이 `lambda-1` 인 이유는 `t_{i-\Delta+1}` 부터 event counting이 진행되기 때문

- hypothesis testing의 목적은 burst period를 확인하기 위한 목적 (calm period는 loyal 에게 dominated)

- 만약 `delta=0.95`라면 test는 다음과 같이 해석될 수 있음

: scale이 `lambda_L`인 event가 `Delta-1`번 발생할때까지 걸리는 time interval 분포 중, interval `Delta_i`가 분포의 quntaile 5% 내에 존재하는가?

- 쉽게 말하면, 기존에 이벤트가 `N` 번 발생하는데 `X` 만큼 걸렸는데, `Y`는 그보다 더 짧은가?

- 해당 intensity를 몰라도 쉽게 유추할 수 있다고 주장

- solve with EM - Burstiness scale: A parsimonious model for characterizing random series of events. In Proceedings of the 22nd ACM SIGKDD

## Results

- 합성 데이터, 실제 데이터 모두를 사용해서 제안한 방법을 평가하였습니다.

- 제안한 방법들: BMAB-O (oracle), BMAB-R (detector)

- 실제 데이터의 경우, 전체 timeseries에서 일정 구간은 `lambda_L` 을 추정하는 구간으로 사용하고 나머지는 평가에 사용하였습니다.

- metric: average of the observed reward (`R(T)/N`), and its standard deviation

- the user liked (Behance, MovieLens), searched (Google trends) or clicked on (Outbrain)

- baseline은 크게 세가지로 나뉩니다.

- stationary: TS

- non-stationary: EXP3

- piece-wise stationary: EXP3DD, DUCB, MUCB, WMD

<img src="https://user-images.githubusercontent.com/38134957/165448414-504e4e05-29a3-4e7e-b473-32e85fc13f80.png" alt="image-20211115222133822" style="zoom:50%;" />

- `K` : the number of arms, `N`: the number of events, `T`: the observed time

- 제안한 BMAB-R이 모든 dataset에서 reward가 우세하였습니다.

- MovieLens의 경우 제안한 방법이 TS과 거의 차이가 없었는데 이는 가장 인기있는 다섯개의 아이템이 stationary 하기 때문이라고 주장하였습니다.

================================================

FILE: paper_review/recsys/recsys2021/Cold Start Similar Artists Ranking with Gravity-Inspired Graph Autoencoders.md

================================================

# Cold Start Similar Artists Ranking with Gravity-Inspired Graph Autoencoders

- Paper : <https://arxiv.org/abs/2108.01053>

- Authors : Guillaume Salha-Galvan, Romain Hennequin, Benjamin Chapus, Viet-Anh Tran, Michalis Vazirgiannis

- Reviewer : tony.yoo

- Topics

- [#Real-World_Concerns](../../topics/Real-World%20Concerns.md)

- #Cold_Start

- #Graph

- [#RecSys2021](RecSys2021.md)

## Summary

- Directed graph로 정의된 item network에 대해 link prediction task을 수행한 논문입니다.

- Directed 기반의 similarity를 구하기 위해 gravity 기반의 매커니즘을 도입하여 단 방향 선호도를 예측 가능하게 만들었습니다.

- Cold item (노드 피쳐는 있으나 adjacent 정보가 isolated 된 상황)에 대해 masking과 VAE기반의 구조로 접근하여 성능 향상을 내었습니다.

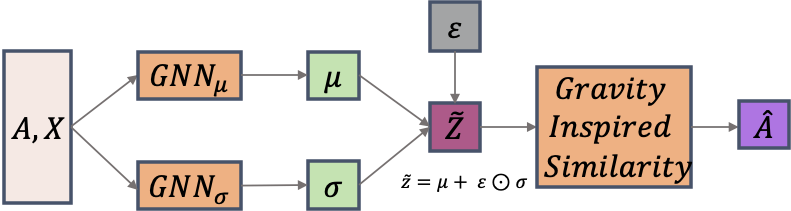

## Approach

### Gravity-Inspired similiarity

$$

\begin{aligned}

\hat{A}_{ij} &= \sigma \left( \log \frac{Gm_j}{\Vert z_i - z_j \Vert_2^2} \right)\\

&= \sigma \left( \underbrace{\log Gm_j}_{\text{denoted}~\tilde{m}_j} - \log\Vert z_i - z_j \Vert_2^2 \right)

\end{aligned}

$$

즉, VAE기반의 GNN를 태워 얻은 $\tilde{Z} = [Z; \tilde{M}], Z\in \mathbb{R}^{n \times d}, \tilde{M}\in \mathbb{R}^{n }$ 로 similiarity score $\hat{A}_{ij}$를 예측합니다.

### Loss

- VAE 기반의 encoding 모델로 GNN을 사용하였습니다.

$$

q(\tilde{Z} \vert A, X) = \Pi_{i=1}^n q(\tilde{z}_i\vert A, X)

$$

$$

q(\tilde{z}_i \vert A, X) = \mathcal{N}\left( \tilde{z}_i \vert \mu_i, \text{diag}(\sigma_{i}^2)\right)

$$

$$

\begin{cases}

\mu = GNN_{\mu}(A, X) \\

\sigma = GNN_{\sigma}(A, X)

\end{cases}

$$

- $P(A)$ 를 최대화하려면 다음의 ELBO를 최대화 하면 됩니다. (jensen's inequality로 증명 가능).

$$

\mathcal{L} = \underbrace{E_{q(Z |A,X)} \left[ \log p(A|Z) \right]}_{\text{Reconstruction Loss}} − \underbrace{D_{KL}(q(Z|A,X) \Vert p(Z))}_{\text{Regularization Loss}},

$$

- Reconstruction Loss

- $q$ 에 대한 평균을 구하기 어렵기 때문에 $A$ 가 bernoulli distribution을 따른다는 가정 하에 몬테카를로 근사를 이용해서 cross entropy 를 계산합니다.

$$

\mathcal{L}_{Reconstruction} = BCE(A, \hat{A})

$$

- Regularization Loss

- 둘 사이의 KL divergence를 구해야하는데 $p(z)$ 를 normal distribution이라 가정하면 다음과 같이 계산됩니다.

$$

\mathcal{L}_{Regularization} = \frac{1}{2} \sum_d\sum_i^k exp(\sigma_{ii, b}^2) + \mu_{i, b} - \sigma_{ii, b} - 1

$$

### Cold Start Similiar Items Ranking

warm item 수를 $n$, cold item 의 갯수를 $m$ 이라 하면, adjacent matrix $A \in \mathbb{R}^{(n + m) \times (n +m)}$ 에서 cold item의 row는 zero vector로 masking 됩니다.

$A$ 를 GNN 기반의 VAE 모델을 통해 다음과 같이 예측할 수 있습니다. 여기서 $\lambda$ 는 influence 와 proxmity사이의 trade off를 튜닝하는 데 사용되며 이는 popularity bias를 control하는 걸 의미합니다. 이렇게 예측된 similairity로 부터 top $k$ 개를 추천하게 됩니다.

$$

\hat{A}_{ij} = \sigma \left( \underbrace{\tilde{m}_j}_{\text{influence of j}} -\lambda \underbrace{\log \Vert z_i - z_j\Vert_2^2}_{\text{proximity of i and j}} \right)

$$

### Other Methods

- [VGAE](https://arxiv.org/abs/1611.07308):

- Undirected graph 에 대해 $\hat{A} = \sigma \left(z_i^{T}z_j\right)$ 를 통해 예측합니다. 다만, 이렇게 계산하면 symmetric 하다는 단점이 존재합니다.

- Sour-Targ GVAE:

- Directed graph 에 대해 $\hat{A} = \sigma\left( z_i^{(s)T}z_j^{(t)}\right)$, $z^{(s)} = z[:d/2]$, $z^{(t)}=z[d/2:]$. 단, $d$는 짝수이고, 이렇게 계산하면 non-symmetric이 됩니다.

## Results

### Dataset

- [Deezer](https://www.deezer.com/soon) 의 24,270 수의 artist 들로 구성 된 directed graph입니다.

- Node feature는 56 dimension을 가지며 다음 component들로 구성되어 있습니다.

- Genre vector (32-dim)

- Country vector (20-dim)

- Mood vector (4-dim)

- Train, valid, test 는 8:1:1 로 split. Valid와 test의 경우엔 cold 노드들로 구성되어 있기 때문에 neigbor edge는 masking 되어있습니다.

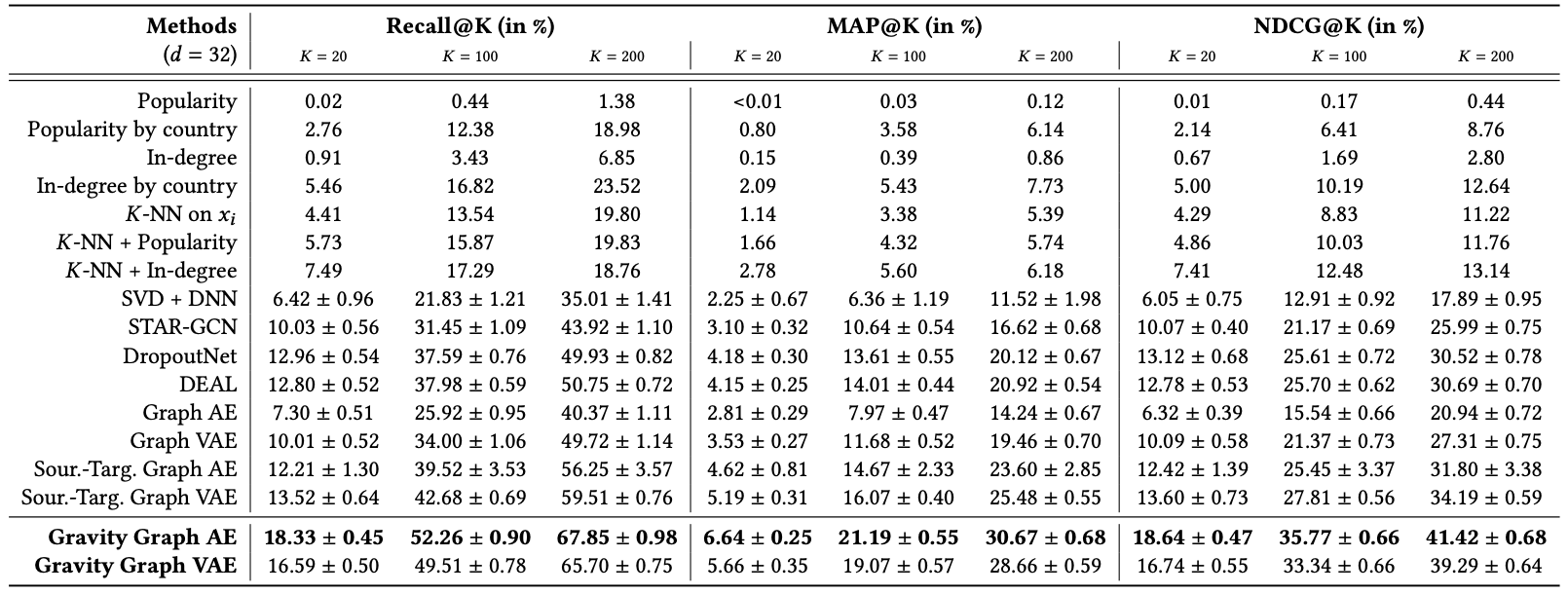

### Metric

- Recall, MAP, NDCG를 사용하였습니다.

### Performance

- Gravity 매커니즘이 큰 폭으로 outperform하였습니다.

- Source.-Targ. 버전이 최근 연구에 대해 약간 우위를 보입니다. Non-symmetric 성질을 띈다는 점에 주목할 수 있습니다. Symmetric인 GAE, GVAE는 더 낮은 걸 보았을때 Non-symmetric 방법이 우수함을 의미합니다.

- Source.-Targ. 에서 VAE 가 AE보다 좋은 결과를 보였지만, Gravity 버전에서는 반대의 결과를 보였습니다. 상황에 따라 VAE vs AE의 성능이 달라지게 됩니다.

#### Mass parameter

- 정성적 분석: 왼쪽은 artist별 mass의 크기와 링크 사이를 visualization 한 결과입니다. 빨간색 노드들이 레게 아티스트들 이고, mass가 큰 것 중에 하나를 예로 들은게 레게의 유명한 아티스트 Bob Marley입니다.

- 정량적 분석: 오른쪽은 mass (아티스트들) 사이의 여러 measure (popularity, in-degree, page rank) 로 상관관계 분석을 해보았습니다. 결과를 보았을 때, mass가 높다고 measure 값들이 꼭 높은 것은 아니지만 어느정도 상관관계가 있다는것을 보여주었습니다.

<figure style="text-align: center;">

<img src="https://user-images.githubusercontent.com/38134957/165449149-afb80cd5-74a6-4e5a-beb3-604a4f499811.png" style="zoom:50%;" />

</figure>

#### Impact of attributes

- Node feature를 많이 쓸수록 성능이 향상되었습니다.

<img src="https://user-images.githubusercontent.com/38134957/165449230-747517bf-faaa-49ab-aa64-0380478432e1.png" style="zoom:60%;" />

#### Popularity-diversity trade off

- $\lambda$ 를 높힐 수록 popular한 item의 rank 빈도가 많아지고, 줄이면 distance에 의한 계산만 하기 때문에 줄어들게 됩니다.

<img src="https://user-images.githubusercontent.com/38134957/165449251-63848fd0-1148-43b5-9d42-16472a022176.png" style="zoom:50%;" />

## Conclusion

- 그래프 방법론을 이용하여 similar item 추천을 non-symetric한 상황에서 다루어 성능을 향상시킨 논문입니다.

- Cold-start 상황에서 masking, VAE 방법론등의 이점을 적용하였습니다.

### Critical view of points

- Cold 아이템의 경우 adjacent 정보를 masking (0으로 패딩)하면 모두 동일한 피쳐로 간주되게 됩니다.

- Cold start 상황에 대해서만 평가를 진행해보았을 때의 우위 비교가 없어 아쉬웠습니다.

- 실험에 사용된 benchmark 모델들은 비교적 최근 논문이 적어서(STAR-GCN, DEAL 빼곤 옛날 논문이라) 아쉬웠습니다.

| Model 이름 | 학회 년도 | 인용수 |

| ------------------------------------------------------------ | ---------- | ------ |

| [DropoutNet](https://www.cs.toronto.edu/~mvolkovs/nips2017_deepcf.pdf) | NIPS 2017 | 104 |

| [Graph VAE](https://arxiv.org/abs/1609.02907) | ICLR 2017 | 1,267 |

| [STAR-GCN](https://arxiv.org/abs/1905.13129) | IJCAI 2019 | 72 |

| [DEAL](https://arxiv.org/abs/2007.08053) | IJCAI 2020 | 11 |

================================================

FILE: paper_review/recsys/recsys2021/Debiased Explainable Pairwise Ranking from Implicit Feedback.md

================================================

# Debiased Explainable Pairwise Ranking from Implicit Feedback

- Paper : <https://arxiv.org/pdf/2107.14768.pdf>

- Authors : Khalil Damak, Sami Khenissi, Olfa Nasraoui

- Reviewer : hee.yoon

- Topics

- [#Privacy_Fairness_Bias](../../topics/Privacy,%20Fairness,%20Bias.md)

- #Matrix_Factorization

- #Explainable_Recommendation

- [#RecSys2021](RecSys2021.md)

## Summary

- 기존 Bayesian Personalized Ranking(BPR) 대비하여 explainability를 늘리고 exposure bias를 잡은 논문입니다.

- 기존 BPR 모델은 설명 불가능한 블랙박스 모델이었습니다. -> a novel explainable loss function and a corresponding Matrix Factorization-based model called Explainable Bayesian Personalized Ranking (EBPR) that generates recommendations along with item-based explanations.

- 기존 BPR 모델은 Missing Not At Random (MNAR) 데이터 특성 때문에 exposure bias에 취약했었습니다. -> an unbiased estimator for the ideal EBPR loss.

## Approach

### BPR

- objective function:

<img width="403" src="https://user-images.githubusercontent.com/38134957/165450622-feaf8ae5-a197-4091-b3a9-e862857ca90d.png">

### Explainable BPR

- objective function:

<img width="412" src="https://user-images.githubusercontent.com/38134957/165450632-6b932ca6-71e3-4ca3-a561-b84e2253f4a3.png">

- E_ui+ (1 - E_ui-) 부분은 (u, i+, i-) 인스턴스의 컨트리뷰션의 비중을 정하는 역할을 합니다. Positive 아이템의 설명력이 높을수록, negative 아이템의 설명력이 낮을수록 학습 기여도가 높습니다. 결과적으로 생성된 추천결과의 상위 아이템들은 더 높은 설명력을 가질 것이라고 기대할 수 있습니다.

- For instance, in the extreme case where either the positive item is not explainable at all or the negative item is completely explainable, the update equation is zeroed out. Hence, no contribution will come from the corresponding instance to the learning. This is reasonable and desirable since the aforementioned case depicts a non explainable preference, where either the positive item is not explainable or the negative item is explainable. Either case undermines the explainability of the preference. (설명가능하지 않은 아이템을 소비한 것은 학습에 포함이 안됩니다. 아래 E_ui 정의를 참고하면, 유저가 소비한 아이템의 이웃 아이템을 유저가 소비한 이력이 없으면 학습에 포함이 안됩니다.)

- explainability matrix:

- E_ui = items the user interacted from the neighboring items / len(neighboring items)

- 이웃한 아이템 중에서 해당 유저와의 인터랙션이 발생한 아이템의 비중입니다.

- similarity의 계산: 별도의 데이터가 아닌, rating 메트릭스 기반으로 cosine similarity를 계산합니다.

- for a specific item, the more neighboring items a given user has interacted with, the higher the explainability of that item will be to this user.

- 학습 시작 전, 미리 계산하는 방식입니다.

- <img width="411" src="https://user-images.githubusercontent.com/38134957/165450706-8c030819-c642-48a2-95e8-a5750254812d.png">

- <img width="405" src="https://user-images.githubusercontent.com/38134957/165450714-805f92ba-7bad-4dc8-9b31-a7513126faca.png">

- neighborhood size

- <img width="820" src="https://user-images.githubusercontent.com/38134957/165450725-593fe1e4-88d2-421d-b8a4-6d674286b0a3.png">

- 추천 결과 서빙시 explainability 기반으로 해석된 결과를 제공 가능합니다. (참조 논문에서 언급한 방식)

- 참조 논문(Using Explainability for Constrained Matrix Factorization): <https://uknowledge.uky.edu/cgi/viewcontent.cgi?article=1017&context=ccs2>

- item 기반 explainability 사용시:

- <img width="335" src="https://user-images.githubusercontent.com/38134957/165450845-b2fdc4ab-3fc6-4aef-8d54-e2ff856df60a.png">

- user 기반 explainability 사용시:

- <img width="262" src="https://user-images.githubusercontent.com/38134957/165450849-6a219ded-aeb6-44a5-9748-c7d0951250c8.png">

### Unbiased Explainable BPR (UEBPR)

- objective function:

- <img width="403" src="https://user-images.githubusercontent.com/38134957/165450866-14ebe685-15c8-4b7d-a037-a82e9c3b447a.png">

- 가정

- <img width="80" src="https://user-images.githubusercontent.com/38134957/165450996-03f03a0a-dcbf-4cf8-a4f9-8d07f9c141a7.png">

- Y_u,i: user 가 item 과 인터렉션을 했는지 여부 (예: 클릭 여부) = 노출이 되고, 관련성도 있다

- O_u,i: user 에게 item 이 노출됐는지 여부

- <img width="237" src="https://user-images.githubusercontent.com/38134957/165451006-800761c4-3242-4313-9852-ada592cb3c61.png">

- R_u,i: user 에게 item 이 관련성이 있는지 여부

- <img width="96" src="https://user-images.githubusercontent.com/38134957/165451017-9b05f8d7-64c6-41d4-bda4-54ddbaf219f9.png">

- <img width="137" src="https://user-images.githubusercontent.com/38134957/165451021-f977c481-a9d7-4b7c-a321-c66e1f2409a8.png">

#### Unbiased BPR Loss (UBPR)

- objective function:

<img width="413" src="https://user-images.githubusercontent.com/38134957/165451226-1757c3d5-18f7-4f59-aa1e-fd3069474ade.png">

#### Ideal Explainable BPR

- objective function:

<img width="403" src="https://user-images.githubusercontent.com/38134957/165451231-7247f495-40f1-4227-aca3-4e2cf6ccf78b.png">

<img width="425" src="https://user-images.githubusercontent.com/38134957/165451234-6b09a4e0-09fd-4bda-a95c-a8e53b130320.png">

#### Partially Unbiased Explainable BPR (pUEBPR)

- objective function:

<img width="396" src="https://user-images.githubusercontent.com/38134957/165451247-65014171-77dc-46e2-8a9c-83919065f26e.png">

## Results

<img width="815" src="https://user-images.githubusercontent.com/38134957/165451256-5957ea77-ef9f-4b02-8e96-5045c50368ea.png">

<img width="816" src="https://user-images.githubusercontent.com/38134957/165451259-f01fdf91-f6d6-4460-9a6a-36ed018bad14.png">

================================================

FILE: paper_review/recsys/recsys2021/Evaluating Off-Policy Evaluation- Sensitivity and Robustness.md

================================================

# Evaluating Off-Policy Evaluation- Sensitivity and Robustness

- Paper : <https://arxiv.org/abs/2108.13703>

- Authors : Yuta Saito, Takuma Udagawa, Haruka Kiyohara, Kazuki Mogi, Yusuke Narita, Kei Tateno

- Reviewer : iggy.ll

- Topics

- [#Metrics_and_Evaluation](../../topics/Metrics%20and%20Evaluation.md)

- [#RecSys2021](RecSys2021.md)

## Summary

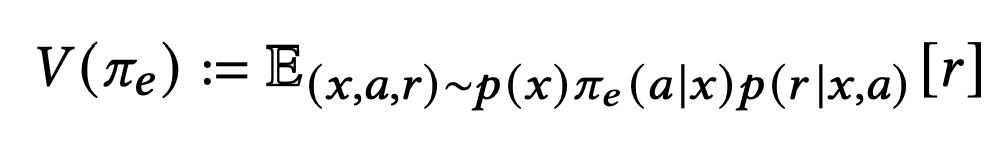

- 이 논문의 목표는 online에 올려보지 않고 모델을 평가하는 것입니다.

- 모델: 유저가 페이지에 접속했을 때, 유저의 정보, 시간 정보 등을 활용해 A안/B안/C안 중 어떤게 나을 지 확률적으로 결정합니다. e.g., [0.4, 0.3, 0,3]

- context x: 유저가 접속한 시간, 유저 정보 등.

- action: 보여준 페이지 레이아웃

- reward:유저가 클릭했거나 안 했거나, 우리가 보여준 레이아웃에 따른 유저의 행동 결과(숫자)

여기서 문제는 $p(r_i...)$를 알 수가 없다는 점과, 모델이 아이템을 선택해서 보여주어야 그에 대한 결과를 만들 수 있다는 점이 있습니다.

## Approach

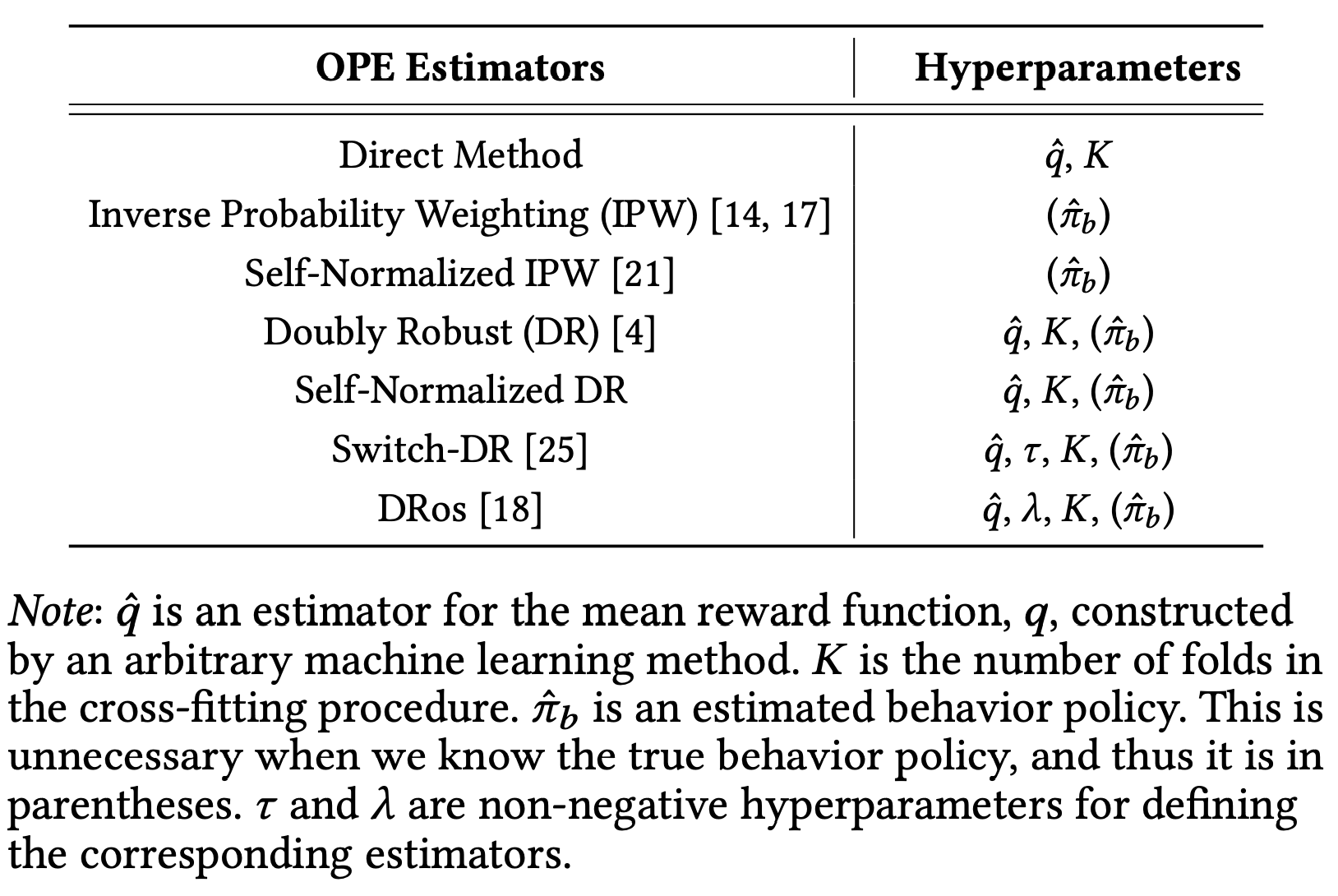

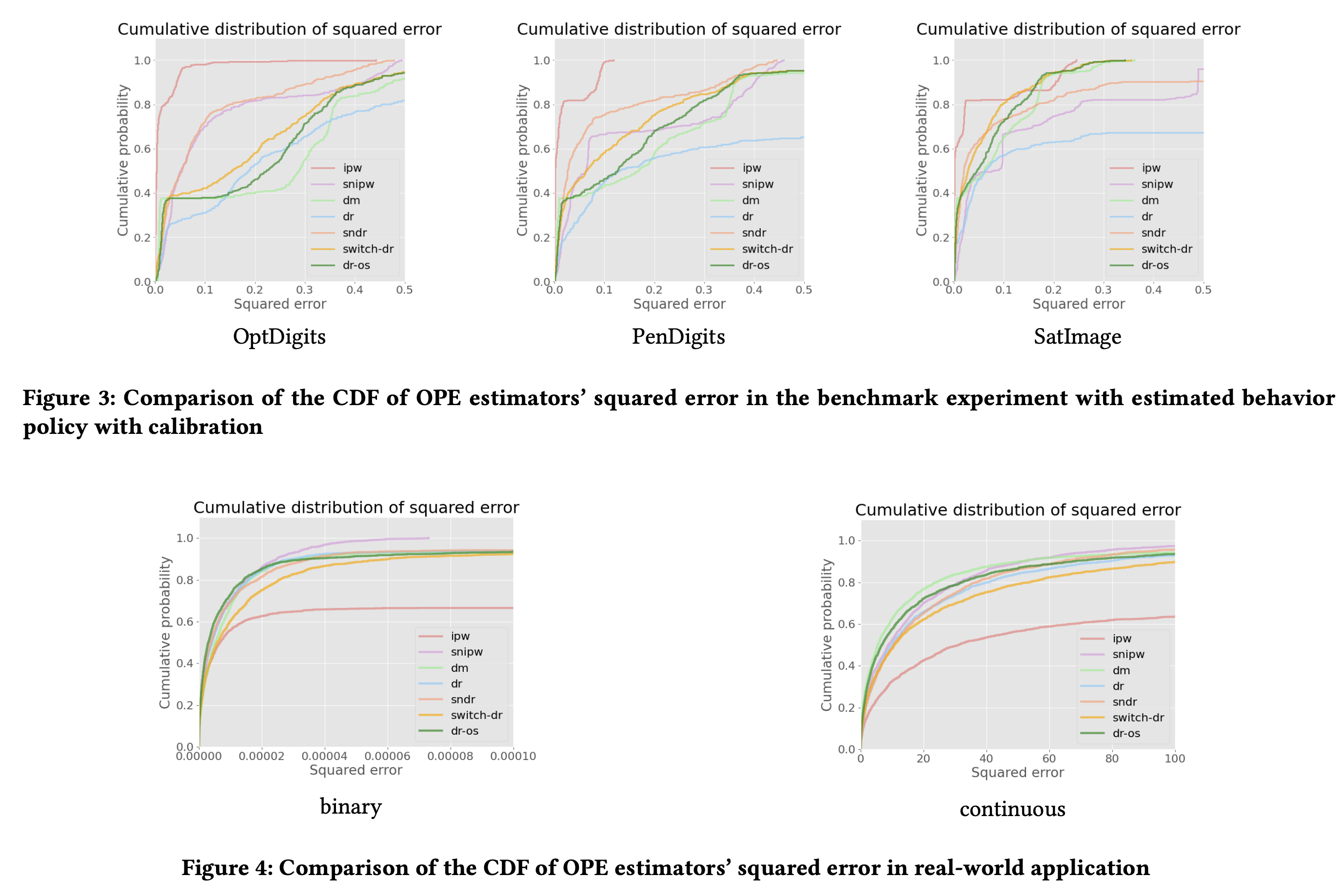

Off Policy Evaluation은 두 가지 분류로 나눌 수 있습니다.

1. Direct Method (DM): mean reward 자체를 estimate하는 방법

2. Inverse Propensity Weight (IPW), SNIPW: logging policy, or base policy의 log를 요구하는 방법

그리고 저 두 가지 방법을 함께 사용하는 방법들도 있습니다.: DR, SNDR, Switch-DR, DRos

DM은 모델을 하나 더 만들어야 하기 때문에, 이 모델에 관한 하이퍼패러미터를 또 신경써주어야 합니다.

## Conclusion

- mean reward를 estimate하기 어렵기 때문에 계열의 방법은 사용하지 않는게 좋을 것 같습니다.

- SNIPW가 일반적으로 가장 괜찮았습니다. (적절히 Calibration해줄 수 있다면 IPW를 써도 괜찮을 것 같습니다.)

- 적절히 Calibration해줄 수 있다면 logging policy를 estimate한 값으로 (logging policy를 따라하도록 다른 모델을 학습해서) 사용해도 나쁘지 않아 보입니다.

- 이건 조금 이상한게, logging policy를 이미 갖고 있으면 이를 사용하지 왜 다른 estimator를 더 만들어야 하는지는 잘 모르겠습니다.

================================================

FILE: paper_review/recsys/recsys2021/Follow the guides- disentangling human and algorithmic curation in online music consumption.md

================================================

# Follow the guides- disentangling human and algorithmic curation in online music consumption

- Paper : <https://arxiv.org/abs/2109.03915>

- Authors : Quentin Villermet, Jérémie Poiroux, Manuel Moussallam, Thomas Louail, Camille Roth

- Reviewer : jinny.kk

- Topics

- [#Applications-Driven_Advances](../../topics/Applications-Driven%20Advances.md)

- #Music_Recommendation

- [#RecSys2021](RecSys2021.md)

## Summary

- Contribution